全息通讯设备、系统、方法和存储介质与流程

- 国知局

- 2024-10-15 09:44:14

本公开属于计算机视觉,具体涉及一种全息通讯设备、系统、方法和存储介质。

背景技术:

1、全息通讯是一种利用光学和计算机图像处理技术,远程捕捉目标对象及其周围环境图像,并通过网络传输至终端侧实现实时立体显示的技术。相较于传统的二维图像通讯方式,全息通讯能够提供更加真实、逼真的交流体验,在远程视频、影音娱乐、在线教育、医疗卫生等领域都有广泛的应用前景。

技术实现思路

1、本公开旨在至少解决现有技术中存在的技术问题之一,提供一种全息通讯设备、系统、方法和存储介质。

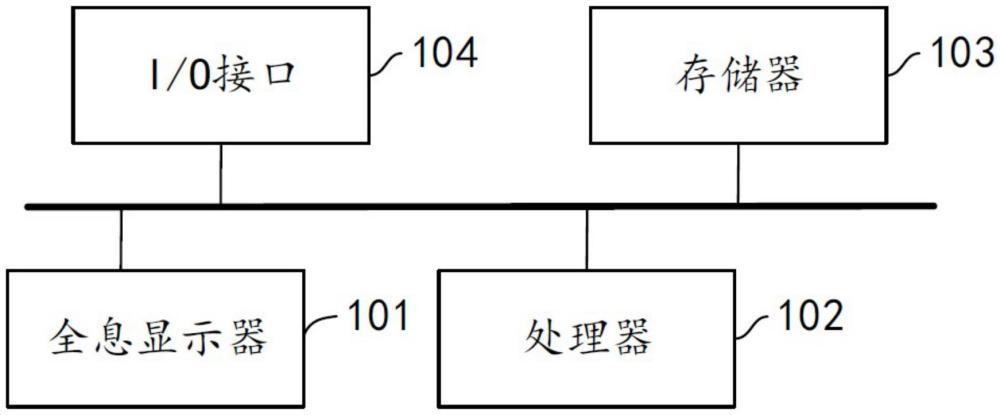

2、第一方面,解决本公开技术问题所采用的技术方案是一种全息通讯设备,其中,包括全息显示器、处理器和存储器;所述存储器存储有所述处理器可执行的机器可读指令,所述机器可读指令被所述处理器执行时使所述处理器执行操作,所述操作包括:

3、基于接收到的多张第一图像,实时确定使用者的人眼三维坐标;所述多张第一图像分别为多个第一相机分别从不同视角拍摄到的所述使用者的图像;

4、接收视频流,并将所述视频流解码为多张第二图像;所述多张第二图像分别为不同第二相机分别从不同视角拍摄到的、目标对象的图像;其中,所述目标对象为处于其他设备运行环境中的实体对象;所述其他设备为与所述全息通讯设备通信的通讯设备;所述第二相机与所述其他设备通信;

5、基于每张所述第二图像的序列信息,分别对相邻两张所述第二图像计算视角间视差,得到多张视差图,并将每张所述视差图转换为点云数据;

6、对于任一所述视差图,基于各个所述点云数据,将所述第二图像的图像特征转换至所述人眼三维坐标,得到视点特征图;

7、利用预先训练好的渲染神经网络模型对所述视点特征图进行渲染,得到所述使用者双目分别对应的新视点图;

8、所述全息显示器,被配置为基于各个所述新视点图进行全息显示。

9、在一些实施例中,所述操作中基于每张所述第二图像的序列信息,分别对相邻两张所述第二图像计算视角间视差,得到多张视差图,包括:

10、基于每张所述第二图像的序列信息,利用预先训练好的视差估计模型,分别对相邻两张所述第二图像计算视角间视差,得到多张视差图。

11、在一些实施例中,所述操作中将每张所述视差图转换为点云数据,包括:

12、对于任一所述视差图,基于所述视差图对应的所述第二相机的参数信息,将所述视差图转换为深度图;

13、基于所述第二相机的参数信息、以及所述深度图对应的第二图像中前景点的位置信息,将所述深度图从图像二维坐标系转换至人眼三维坐标系,得到点云集合;所述点云集合包括基于一张所述深度图转换得到的点云数据。

14、在一些实施例中,利用下述公式一,确定深度图;

15、公式一:其中,fx表示用于拍摄所选择的第二图像的第二相机,在所述图像二维坐标系下x轴方向上的第一相机焦距;b表示用于拍摄所选择的第二图像的第二相机的基线;d表示所述视差图中的某一像素点的灰阶值;d表示所述视差图中对应像素点的深度值。

16、在一些实施例中,利用下述表达式二,确定所述点云集合中的一个点云数据;

17、公式二:其中,p表示一个点云数据;x,y,z分别表示前景点的点云在所述人眼三维坐标系下的坐标;x′,y′分别表示前景点在所述图像二维坐标系下的坐标;fx,fy分别表示用于拍摄所选择的第二图像的第二相机,在所述图像二维坐标系下x轴方向上的第一相机焦距和y轴方向上的第二相机焦距。

18、在一些实施例中,所述操作中基于各个所述点云数据,将所述第二图像的图像特征转换至所述人眼三维坐标,得到视点特征图,包括:

19、对于每个所述点云数据,基于所述第二图像的图像特征,利用卷积神经网络,回归所述点云数据对应高斯分布的张量;

20、基于所述点云数据对应高斯分布的张量,得到所述点云数据对应的高斯点云数据;

21、利用高斯泼溅算法,将各个所述高斯点云数据光栅化至所述人眼三维坐标,得到视点特征图。

22、在一些实施例中,利用下述公式三,确定述点云数据对应的高斯点云数据;

23、公式三:其中,σ=rsstrt表示矩阵运算的中间结果,r表示张量中的旋转参量的四元数,s表示张量中的尺度,()t表示矩阵转置运算;g(p)表示点云数据对应的高斯点云数据;p表示该点云数据。

24、在一些实施例中,所述渲染神经网络模型包括带有残差网络结构的unet卷积神经网络。

25、在一些实施例中,所述操作还包括训练所述视差估计模型,具体包括:

26、基于训练数据集中每张样本图像的序列信息,以及每张所述样本图像所属的虚拟对象,从所述训练数据集中选取一个所述虚拟对象在一组相邻视角下的目标样本图像;所述训练数据集中包括虚拟相机在不同视角下所拍摄到的不同虚拟对象的样本图像;

27、将一组所述目标样本图像输入至所述视差估计模型中计算视角间视差,输出理论视差图;

28、基于所述理论视差图与预先设置的真实视差图构造损失函数,并利用所述损失函数进行反向传播以持续训练所述视差估计模型;继续从所述训练数据集中选取所述虚拟对象在另一组相邻视角下的目标样本图像或从所述训练数据集中选取其他所述虚拟对象在一组相邻视角下的目标样本图像,返回执行将一组所述目标样本图像输入至所述视差估计模型中计算视角间视差,输出理论视差图的过程,直至损失函数收敛,得到训练完成的视差估计模型。

29、在一些实施例中,所述操作还包括训练所述渲染神经网络模型,具体包括:

30、获取预先渲染得到的样本深度图;

31、基于所述虚拟相机的参数信息,将所述理论深度图从样本图像二维坐标系转换至虚拟三维坐标系,得到训练点云集合;所述训练点云集合包括基于所述理论深度图转换得到的理论点云数据;

32、对于每个所述理论点云数据,基于所述目标样本图像的图像特征,利用卷积神经网络,回归所述理论点云数据对应高斯分布的张量;

33、基于所述理论点云数据对应高斯分布的张量,得到所述理论点云数据对应的理论高斯点云数据;

34、利用高斯泼溅算法,将各个所述理论高斯点云数据光栅化至所述虚拟对象的目标视角,得到理论视点特征图;

35、利用待训练的渲染神经网络模型对所述理论视点特征图进行渲染,得到所述虚拟对象双目分别对应的理论视点图;

36、基于所述理论视点图与预先设置的真实视点图构造损失函数,并利用所述损失函数进行反向传播以持续训练所述渲染神经网络模型;以及,返回获取预先渲染得到的样本深度图的步骤并顺序执行,直至损失函数收敛,得到训练完成的渲染神经网络模型。

37、第二方面,本公开实施例还提供了一种全息通讯系统,包括多个第一相机和全息通讯设备;所述全息通讯设备包括全息显示器、处理器和存储器;

38、多个所述第一相机,被配置为分别从不同视角拍摄使用者的第一图像,并发送至所述处理器;

39、所述存储器存储有所述处理器可执行的机器可读指令,所述机器可读指令被所述处理器执行时使所述处理器执行操作,所述操作包括:

40、基于接收到的多张第一图像,实时确定使用者的人眼三维坐标;所述多张第一图像分别为多个第一相机分别从不同视角拍摄到的所述使用者的图像;

41、接收视频流,并将所述视频流解码为多张第二图像;所述多张第二图像分别为不同第二相机分别从不同视角拍摄到的、目标对象的图像;其中,所述目标对象为处于其他设备运行环境中的实体对象;所述其他设备为与所述全息通讯设备通信的通讯设备;所述第二相机与所述其他设备通信;

42、基于每张所述第二图像的序列信息,分别对相邻两张所述第二图像计算视角间视差,得到多张视差图,并将每张所述视差图转换为点云数据;

43、对于任一所述视差图,基于各个所述点云数据,将所述第二图像的图像特征转换至所述人眼三维坐标对应的所述使用者的视角,得到视点特征图;

44、利用预先训练好的渲染神经网络模型对所述视点特征图进行渲染,得到所述使用者双目分别对应的新视点图;

45、所述全息显示器,被配置为基于各个所述新视点图进行全息显示。

46、在一些实施例中,所述第一相机为彩色相机。

47、在一些实施例中,多个所述第一相机包括四个所述第一相机。

48、第三方面,本公开实施例还提供了一种全息通讯方法,其应用于如第一方面中所述的全息通讯设备;其中,所述全息通讯方法包括:

49、基于接收到的多张第一图像,实时确定所述使用者的人眼三维坐标;所述多张第一图像分别为多个第一相机分别从不同视角拍摄到的所述使用者的图像;

50、接收视频流,并将所述视频流解码为多张第二图像;所述多张第二图像分别为不同第二相机分别从不同视角拍摄到的、目标对象的图像;其中,所述目标对象为处于其他设备运行环境中的实体对象;所述其他设备为与所述全息通讯设备通信的通讯设备;所述第二相机与所述其他设备通信;

51、基于每张所述第二图像的序列信息,分别对相邻两张所述第二图像计算视角间视差,得到多张视差图,并将每张所述视差图转换为点云数据;

52、对于任一所述视差图,基于各个所述点云数据,将所述第二图像的图像特征转换至所述人眼三维坐标对应的所述使用者的视角,得到视点特征图;

53、利用预先训练好的渲染神经网络模型对所述视点特征图进行渲染,得到所述使用者双目分别对应的新视点图,并进行全息显示。

54、第四方面,本公开实施例还提供了一种计算机非瞬态可读存储介质,该计算机非瞬态可读存储介质上存储有计算机程序,该计算机程序被处理器运行时执行如第三方面所述的全息通讯方法的步骤。

本文地址:https://www.jishuxx.com/zhuanli/20241015/315147.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表