融合多重填充和注意力机制的对比不完全数据聚类方法

- 国知局

- 2024-10-21 14:39:58

本发明涉及数据分析,尤其涉及一种融合多重填充和注意力机制的对比不完全数据聚类方法。

背景技术:

1、随着云计算、人工智能的迅速崛起,海量数据已经成为重要资产,从庞大的数据量中挖掘有价值的信息成为各行业提升竞争力的关键。其中聚类作为一种有效的数据挖掘手段被广泛应用于特征选择、图像分割和内容检索等领域,其基本思想是在无标签的情况下将数据样本按照关联程度划分为不同类别。然而,在实际应用中,由于传感器失效、测量偏差和不稳定性特征等众多因素导致的数据缺失现象十分普遍。因此,近年来关于不完全数据聚类算法的探讨与研究呈现出显著的增长趋势。

2、发明人发现,现有的聚类方法普遍使用单一填充技术处理不完全数据,不能充分考虑缺失值的不确定性,填充效果差。而多重填充算法恰恰弥补了单次填充的不足,并将单视图数据巧妙地转化为提供了数据的不同方面或视角的多视图数据。此外,针对多视图数据的聚类方法普遍存在两个问题:首先,深度多视图聚类模型仅采用矩阵平均等简单方法对视图的潜在特征进行融合,无法获得最优的融合特征。其次,视图的私有信息在特征融合中可能占据主导地位从而导致聚类效果不佳。

技术实现思路

1、为了解决上述问题,本发明提出了一种融合多重填充和注意力机制的对比不完全数据聚类方法,通过融合多重填充算法与深度多视图聚类技术,提高了不完全数据填充的准确性。此外,对各个视图的潜在特征应用异构图注意力网络,能够更精细地整合每个视图所提供的独特信息,从而显著增强整体模型性能。此外,为了进一步降低视图私有信息对特征融合的影响,进一步提高聚类结果,采用多视图的对比学习算法,从而能够有效地提炼和发掘不同视图间的共享特征信息。

2、为了实现上述目的,本发明采用如下技术方案:

3、第一方面,本发明提供一种融合多重填充和注意力机制的对比不完全数据聚类方法,包括:

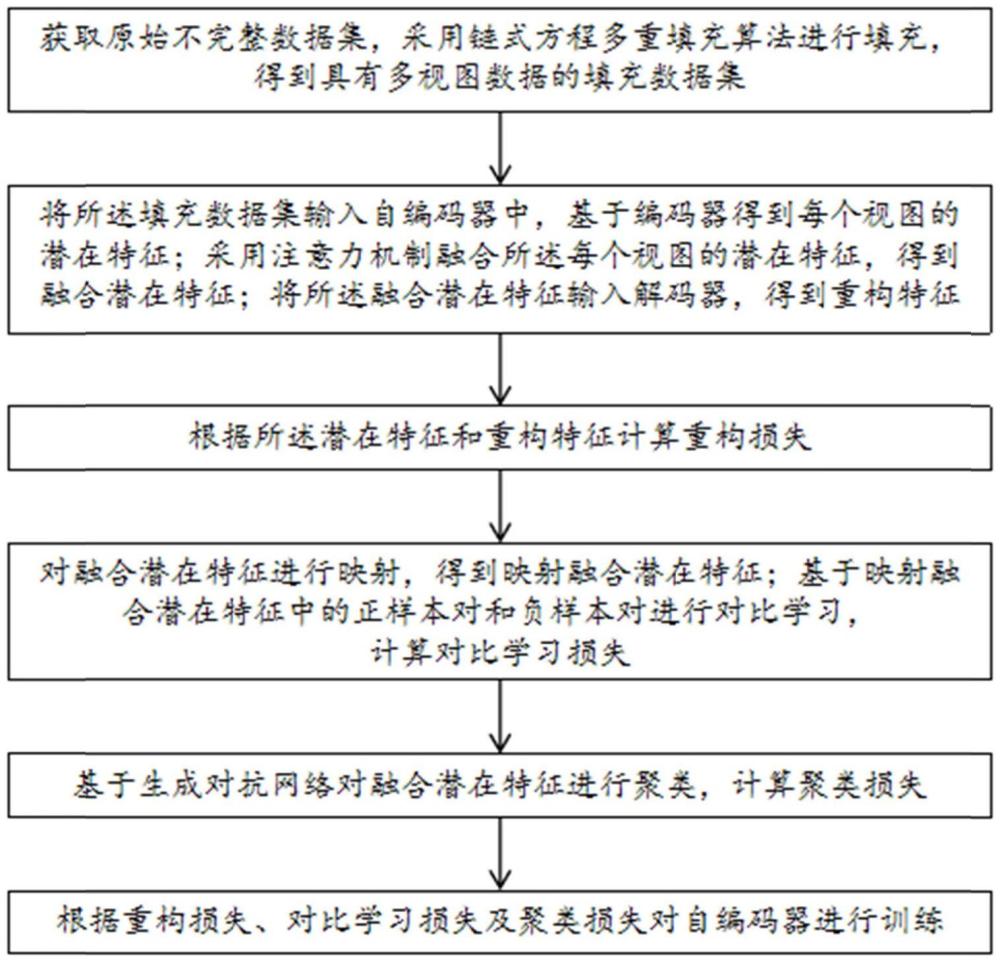

4、获取原始不完整数据集,采用链式方程多重填充算法进行填充,得到具有多视图数据的填充数据集;

5、将所述填充数据集输入自编码器中,基于编码器得到每个视图的潜在特征;采用注意力机制融合所述每个视图的潜在特征,得到融合潜在特征;将所述融合潜在特征输入解码器,得到重构特征;

6、根据所述潜在特征和重构特征计算重构损失;

7、对融合潜在特征进行映射,得到映射融合潜在特征;基于映射融合潜在特征中的正样本对和负样本对进行对比学习,计算对比学习损失;

8、基于生成对抗网络对融合潜在特征进行聚类,计算聚类损失;

9、根据重构损失、对比学习损失及聚类损失对自编码器进行训练。

10、优选地,所述采用链式方程多重填充算法进行填充,得到填充数据集,具体过程为:

11、所述原始不完整数据集中的单视图变量包含缺失值;

12、获取无缺失变量集;

13、抽取原始不完整数据集中的单视图变量,计算所述单视图变量与无缺失变量集之间的统计关系,基于所述统计关系对单视图变量进行插补,得到插补多视图变量,将插补多视图变量加入所述无缺失变量集;

14、按顺序依次抽取原始不完整数据集中的其他单视图变量,计算与更新的无缺失变量集之间的统计关系,进行缺失值插补,得到填充数据集。

15、优选地,所述采用注意力机制融合所述每个视图的潜在特征,得到融合潜在特征,具体过程为:

16、计算每个样本不同视图的潜在特征的均值;

17、利用自适应注意力机制计算每个样本不同视图的潜在特征相对于整体潜在特征的权重;

18、对每一个样本,基于权重对不同视图的潜在特征求和,得到融合潜在特征。

19、优选地,所述自适应注意力机制具体为:随机对权重进行多次变换,求平均后作为最终权重。

20、优选地,所述基于映射融合潜在特征中的正样本对和负样本对进行对比学习,计算对比学习损失,具体过程为,

21、采用余弦距离计算正样本对和负样本对之间的相似度:

22、

23、其中,<·,·>表示点积运算;任意两个视图hm与hn之间的特征对比损失表示为:

24、

25、其中τf为温度参数,所有视图上的累积多视图特征对比损失为:

26、

27、优选地,所述基于生成对抗网络对融合潜在特征进行聚类,具体为:对隶属度分布q施加一个先验分布。

28、优选地,所述根据重构损失、对比学习损失及聚类损失对自编码器进行训练,具体为:

29、

30、其中,lre表示重构损失,lad-g表示聚类损失,lco表示对比损失,α和β为平衡聚类损失和对比损失的正则化参数。

31、第二方面,本发明提供一种融合多重填充和注意力机制的对比不完全数据聚类系统,包括:

32、多重填充模块,用于获取原始不完整数据集,采用链式方程多重填充算法进行填充,得到具有多视图数据的填充数据集;

33、特征融合模块,用于将所述填充数据集输入自编码器中,基于编码器得到每个视图的潜在特征;采用注意力机制融合所述每个视图的潜在特征,得到融合潜在特征;将所述融合潜在特征输入解码器,得到重构特征;

34、损失计算模块,用于根据所述潜在特征和重构特征计算重构损失;对融合潜在特征进行映射,得到映射融合潜在特征;基于映射融合潜在特征中的正样本对和负样本对进行对比学习,计算对比学习损失;基于生成对抗网络对融合潜在特征进行聚类,计算聚类损失;根据重构损失、对比学习损失及聚类损失对自编码器进行训练。

35、第三方面,本发明提供一种计算机可读存储介质,其上存储有计算机程序,该程序被处理器执行时实现第一方面所述的一种融合多重填充和注意力机制的对比不完全数据聚类方法中的步骤。

36、第四方面,本发明提供一种计算机设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述程序时实现第一方面所述的一种融合多重填充和注意力机制的对比不完全数据聚类方法中的步骤。

37、与现有技术相比,本公开的有益效果为:

38、本发明引入链式方程多重填充算法(mice),改进了传统的单一填充方法未能充分考虑缺失数据不确定性的问题,并将多次填充的结果巧妙地与深度多视图聚类模型相结合。不仅克服了处理高维数据的挑战,而且显著增强了聚类性能。同时,为了避免采用简单的矩阵平均方法融合特征可能带来的局限性,我们进一步拓展了异构图注意力网络,并将其应用于整合多个视图的潜在特征中,以此增强模型的整体性能表现。此外,运用对比学习算法针对各个视图的潜在特征进行操作,旨在提炼出跨视图共享的公共特征信息,从而减轻过多特定于单个视图的私有信息对后续任务结果的影响。

39、本发明附加方面的优点将在下面的描述中部分给出,部分将从下面的描述中变得明显,或通过本发明的实践了解到。

技术特征:1.一种融合多重填充和注意力机制的对比不完全数据聚类方法,其特征在于,包括:

2.如权利要求1所述的一种融合多重填充和注意力机制的对比不完全数据聚类方法,其特征在于,所述采用链式方程多重填充算法进行填充,得到填充数据集,具体过程为:

3.如权利要求1所述的一种融合多重填充和注意力机制的对比不完全数据聚类方法,其特征在于,所述采用注意力机制融合所述每个视图的潜在特征,得到融合潜在特征,具体过程为:

4.如权利要求3所述的一种融合多重填充和注意力机制的对比不完全数据聚类方法,其特征在于,所述自适应注意力机制具体为:随机对权重进行多次变换,求平均后作为最终权重。

5.如权利要求1所述的一种融合多重填充和注意力机制的对比不完全数据聚类方法,其特征在于,所述基于映射融合潜在特征中的正样本对和负样本对进行对比学习,计算对比学习损失,具体过程为,采用余弦距离计算正样本对和负样本对之间的相似度:

6.如权利要求1所述的一种融合多重填充和注意力机制的对比不完全数据聚类方法,其特征在于,所述基于生成对抗网络对融合潜在特征进行聚类,具体为:对隶属度分布q施加一个先验分布。

7.如权利要求1所述的一种融合多重填充和注意力机制的对比不完全数据聚类方法,其特征在于,所述根据重构损失、对比学习损失及聚类损失对自编码器进行训练,具体为:

8.一种融合多重填充和注意力机制的对比不完全数据聚类系统,其特征在于,包括:

9.一种计算机可读存储介质,其上存储有计算机程序,其特征在于,所述程序被处理器执行时实现如权利要求1-7中任一项所述的一种融合多重填充和注意力机制的对比不完全数据聚类方法中的步骤。

10.一种计算机设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,其特征在于,所述处理器执行所述程序时实现如权利要求1-7中任一项所述的一种融合多重填充和注意力机制的对比不完全数据聚类方法中的步骤。

技术总结本公开提出一种融合多重填充和注意力机制的对比不完全数据聚类方法,包括:采用链式方程多重填充算法对原始不完整数据集进行填充,得到具有多视图数据的填充数据集;将填充数据集输入自编码器中,基于编码器得到每个视图的潜在特征;采用注意力机制融合每个视图的潜在特征,得到融合潜在特征;将融合潜在特征输入解码器,得到重构特征;根据潜在特征和重构特征计算重构损失;基于映射的融合潜在特征中的正样本对和负样本对进行对比学习,计算对比学习损失;基于生成对抗网络对融合潜在特征进行聚类,计算聚类损失;根据损失函数对自编码器进行训练。提高了不完全数据填充的准确性、有效挖掘不同视图间的共享特征信息,提高聚类准确性。技术研发人员:周劲,韩欣雨,陈月辉,王迎旭,王琳,杜韬,杨程,刘博文受保护的技术使用者:济南大学技术研发日:技术公布日:2024/10/17本文地址:https://www.jishuxx.com/zhuanli/20241021/318899.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表