一种改进外观特征处理的行人多目标跟踪方法及系统

- 国知局

- 2024-12-06 12:23:49

本发明涉及计算机视觉和图像处理,具体涉及一种改进外观特征处理的行人多目标跟踪方法及系统。

背景技术:

1、多目标跟踪(mot)是计算机视觉领域的一个重要的基础任务,并在众多领域中有着广泛的应用,如自动驾驶,视频监控,智慧交通等。因此,实现高精度、快速的多目标跟踪具有重要的应用价值。然而,现实世界的应用场景较为复杂,具有目标外观特征退化、目标密集、遮挡频繁等特性,为多目标跟踪方法的研究与现实应用带来了挑战。

2、目前,实现多目标跟踪方法的一个主流范式是基于检测的跟踪。这类方法将多目标跟踪分为目标检测、数据关联两个步骤。其中,目标检测旨在定位当前帧中潜在的感兴趣的目标,通常由神经网络目标检测模型实现;关联任务则通过计算检测结果与目标历史轨迹之间的相似度,并基于相似度进行二部图匹配实现。由于检测器水平的快速进步,行人多目标跟踪领域的研究主要聚焦于如何实现高质量、鲁棒性强的关联。

3、为实现高精度的检测结果与目标历史轨迹关联,通常会考虑目标运动状态、目标外观特征两类关联依据。例如,在运动状态上,通常使用卡尔曼滤波对目标运动进行建模,并使用预测的运动状态来计算与检测结果之间的运动相似度(例如,以iou为指标的位置关系、速度方向一致性)。在外观特征上,通常使用神经网络从检测结果对应边界框中提取reid特征,并与轨迹中存储的外观特征计算特征距离(通常使用余弦距离),作为关联依据。同时,在成功关联后,检测对应的运动状态和外观特征,分别用来更新轨迹的卡尔曼滤波参数以及按照指数移动平均(ema)状态转移公式来更新轨迹的外观特征。然而,在现实场景中具有很多颇具挑战性的复杂场景。

4、其中,包含大量目标的密集场景下的跟踪是目前多目标跟踪的一个难点:

5、(1)一方面,由于场景中目标之间的运动会相互影响,大量目标之间的交互也使得运动模式更为复杂。

6、(2)另一方面,高度密集的目标之间的干扰会导致提取到的外观特征中具有更多的噪声,并在时序的积累中恶化。

7、(3)此外,遮挡等长尾情况在这种场景下也会更加频繁,导致提取到的特征的质量参差不齐,为跟踪带来了干扰。

8、(4)跟踪准确性不足:由于未充分考虑不同情况下目标的特征分布与特征质量差异,传统模型在复杂场景下跟踪效果不佳。

9、(5)实时性问题:许多高准确度跟踪算法计算复杂,难以满足实时跟踪的需求。

10、(6)环境适应性差:传统算法在不同场景下的泛化能力有限,特别是在目标密集的复杂环境中。

11、由于以上特性,高度密集的场景将导致跟踪器的性能更容易退化。因此,完善目标特征模型、改进关联策略,从而实现更高质量、更具鲁棒性的行人目标跟踪方法是一个亟需解决的现实问题。

12、基于此,本发明设计了一种改进外观特征处理的行人多目标跟踪方法及系统以解决上述问题。

技术实现思路

1、针对现有技术所存在的上述缺点,本发明提供了一种改进外观特征处理的行人多目标跟踪方法及系统。

2、为实现以上目的,本发明通过以下技术方案予以实现:

3、一种改进外观特征处理的行人多目标跟踪方法,包括以下步骤:

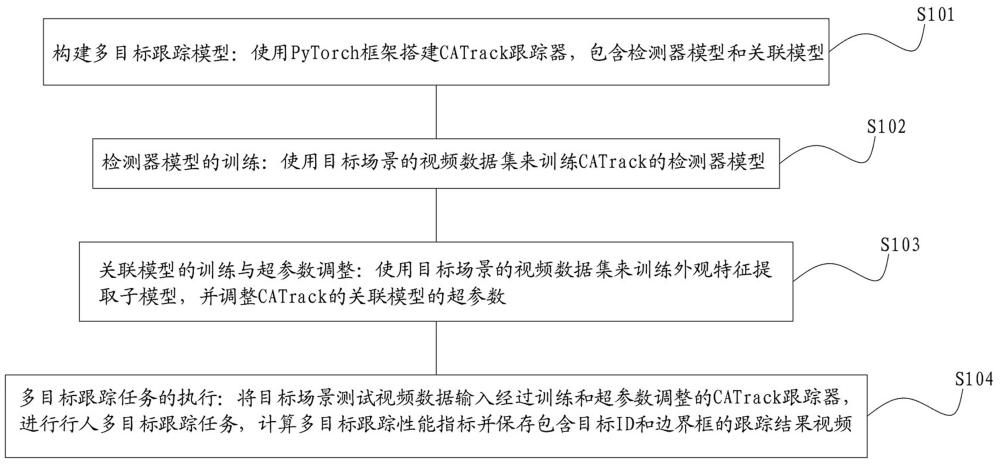

4、s101、构建多目标跟踪模型:使用深度学习框架pytorch框架搭建catrack跟踪器,该catrack跟踪器包含检测器模型和关联模型两部分,用于对输入视频进行逐帧处理;

5、其中,关联模型对检测器模型的输出进行四个阶段的处理,分别为:当前帧出现的目标的特征获取、当前帧出现的目标与目标历史轨迹之间的相似度计算、当前帧出现的目标与目标历史轨迹之间的二部图匹配、利用匹配结果进行轨迹特征更新;

6、s102、检测器模型的训练:使用目标场景的视频数据集来训练检测器模型;

7、s103、关联模型的训练与超参数调整:使用目标场景的视频数据集来训练关联模型,并根据场景特性在目标场景的视频中调整关联模型的超参数;

8、s104、多目标跟踪任务的执行:将目标场景测试视频数据输入经过训练和超参数调整的catrack跟踪器,进行行人多目标跟踪任务,计算多目标跟踪性能指标并保存包含目标id和边界框的跟踪结果视频。

9、更进一步的,步骤s101中,检测器模型采用深度神经网络目标检测模型yolox;关联模型包括一个外观特征提取子模型,该外观特征提取子模型采用sbs-50模型。

10、更进一步的,步骤s101中,所述目标的特征获取包括:获取目标运动状态、置信度和外观特征;所述当前帧出现的目标与目标历史轨迹之间的相似度计算包括:运动相似度计算,沿用基线方法hybrid-sort中的设置;外观相似度计算,提取当前帧潜在目标的外观特征与轨迹外观特征计算余弦相似度。

11、更进一步的,步骤s101中,关联模型在处理外观特征时,对轨迹的状态按照关联情况和位置情况进行划分:对于在前一帧中关联成功以及刚被初始化的轨迹,将其关联状态设置为激活,对于未关联成功的其他轨迹,则关联状态设置为未激活;在处理与处于未激活状态的轨迹进行关联的检测时,按照目标的位置对检测到的潜在目标进行划分:对于帧中存在的任何一个目标,将图像左右两侧分别向内收缩一个目标边界框宽的距离w,并将图像上下两侧分别向内收缩一个目标边界框高的距离h,得到一个潜在遮挡区域,而其他部分则被作为正常区域;对于目标边界框完全落入潜在遮挡区域的目标,将其判定为遮挡,对于目标边界框与正常区域存在重叠的目标,则被判定为非遮挡。

12、更进一步的,所述关联模型采用基于置信度的选择性特征更新模块,即casfum模块,casfum模块包含一种过滤歧义轨迹的选择性外观状态更新策略和一种基于置信度的自适应ema状态转移公式。

13、更进一步的,选择性外观状态更新策略按照轨迹情况进行差异化的处理:对于处于激活状态或是处于非激活状态但并不完全落在潜在遮挡区域的轨迹,在其关联成功后进行正常外观特征更新,而对于非激活遮挡区域轨迹,即在上一帧中没有成功关联且完全处于潜在遮挡区域的轨迹,不将其用于轨迹的外观特征的更新;

14、对于匹配成功的轨迹,使用同时考虑轨迹置信度和潜在目标置信度的自适应ema状态转移公式进行更新,计算公式为:

15、;

16、其中, 是更新后的轨迹外观特征,是更新前的轨迹外观特征,是与轨迹匹配的潜在目标检测框中提取的外观特征,是更新后的轨迹置信度,是更新前的轨迹置信度; α d是自适应的惯性权值,其计算公式为:

17、;

18、其中, α是人工设置的初始惯性权值参数, c i和 c det分别是轨迹i的置信度和与之匹配的检测结果对应的置信度, β是用于过滤噪声的接受阈值参数, σ是一个与 c i和 c det均线性相关的调整程度,并在 c i和 c det相等时取零。

19、更进一步的,所述关联模型在进行外观相似度计算时使用aaam校正模块;

20、首先,额外存储轨迹的两个外观特征:目标最后一次关联成功的检测对应的外观特征以及目标所有历史观测的外观特征的平均;

21、接着,计算目标最后一次关联成功的检测对应的外观特征与当前帧潜在目标外观特征之间的余弦距离以及相应的置信度之差的绝对值;同时,计算目标所有历史观测的外观特征的平均与当前帧潜在目标外观特征之间的余弦距离以及相应的置信度之差的绝对值;

22、对于每一个轨迹-潜在目标对(i,j),采用最后一次关联特征与历史平均特征中具有较小的置信度之差的轨迹特征构建候选模板置信度距离矩阵以及候选模板外观特征距离矩阵,计算公式为:

23、

24、采用自适应ema状态转移公式更新轨迹的外观特征以及置信度,得到置信度距离矩阵以及外观特征距离矩阵;

25、比较候选模板置信度距离矩阵与轨迹置信度距离矩阵中每个元素的大小,通过选取置信度距离更小者对应的外观特征距离构建最终的外观距离矩阵,计算公式为:

26、。

27、更进一步的,所述关联模型使用基线方法hybrid-sort中的运动模型进行运动相似度计算;

28、使用卡尔曼滤波对目标的运动状态进行建模与预测,卡尔曼滤波的状态向量为:

29、;

30、其中,(u,v)是目标的中心点坐标,a是边界框的面积,c是目标框的置信度,r是边界框的高宽比;分别是的速度分量;计算轨迹-潜在目标对(i,j)的运动相似度距离,采用以下公式:

31、;

32、其中, 是hybrid-sort中的hmiou空间位置交并比距离,是hybrid-sort中的速度方向一致性距离,是置信度距离之差的绝对值,λ1、λ2、λ3是三个人工设置的权重参数。

33、更进一步的,λ1,λ2,λ3分别设置为1.0,0.2,1.0。

34、为了更好地实现本发明的目的,本发明还提供了一种改进外观特征处理的行人多目标跟踪系统,包括:

35、多目标跟踪模型构建模块,用于使用深度学习框架pytorch框架搭建catrack跟踪器,该catrack跟踪器包含检测器模型和关联模型两部分,用于对输入视频进行逐帧处理;

36、其中,关联模型对检测器模型的输出进行四个阶段的处理,分别为:当前帧出现的目标的特征获取、当前帧出现的目标与目标历史轨迹之间的相似度计算、当前帧出现的目标与目标历史轨迹之间的二部图匹配、利用匹配结果进行轨迹特征更新;

37、检测器模型训练模块,用于使用目标场景的视频数据集来训练检测器模型;

38、关联模型训练与超参数调整模块,用于使用目标场景的视频数据集来训练关联模型,并根据场景特性在目标场景的视频中调整关联模型的超参数;

39、多目标跟踪执行模块,用于将目标场景测试视频数据输入经过训练和超参数调整的catrack跟踪器,进行行人多目标跟踪任务,计算多目标跟踪性能指标并保存包含目标id和边界框的跟踪结果视频。

40、本发明相较于现有技术,其有益效果为:1、本发明在具有目标高度密集、遮挡频繁的mot20数据集上的多个评价指标中都表现出了比基线方法(hybrid-sort-reid)及其他先进方法更高的性能。说明在目标密集的复杂场景下具有优秀的跟踪表现。

41、2、本发明方法在mot20数据集上有较好的保持目标id的能力,本发明方法在目标密集、遮挡频繁的场景下具有较好的鲁棒性。

42、3、本发明方法在目标密集程度较低的mot17数据集上的多个评价指标中同样表现出了比基线方法(hybrid-sort-reid)及其他先进方法更高的性能优势,展现了本发明方法良好的泛化能力与在不同应用场景下的普适性。

43、4、本发明通过消融实验验证了所提出的选择性外观状态更新策略(su)、自适应ema状态转移公式(aema)、aaam校正模块(aaam)的有效性。

本文地址:https://www.jishuxx.com/zhuanli/20241204/341135.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。