基于多客户端内积函数代理重加密隐私保护联邦聚合方法与流程

- 国知局

- 2025-01-10 13:32:40

本发明涉及隐私保护,尤其涉及基于多客户端内积函数代理重加密隐私保护联邦聚合方法。

背景技术:

1、在现代医疗活动中,以机器学习模型训练和推理为代表的人工智能发挥着越来越重要的作用,在模型训练过程中,往往需要引入多维度的医疗数据,这些数据可能来自多个用户或多个医疗机构,在传统的模型训练过程中,需要首先收集所有参与训练的数据然后进行集中训练,在数据收集过程中,由于存在数据的跨域传输,存在较大的用户隐私泄露风险。

2、联邦学习允许不同参与者在不传输原始数据的情况下进行模型训练协作,从而保护用户数据隐私;然而,联邦学习面临中央服务器通过中间参数恢复参与者原始数据相关信息的威胁,为解决此隐私保护问题,存在多种联邦学习参数聚合方式,如基于安全多方计算(mpc)的联邦学习,参与者用秘密共享共享中间参数,中央服务器通过与参与者运行mpc协议聚合参数,再通过秘密共享重建恢复全局参数,但引入了更多通信轮次和显著开销;基于同态加密(he)的联邦学习,参与者共享密钥并加密中间参数,虽允许对加密数据计算使中央服务器能用同态运算聚合参数并广播结果,但因同态加密复杂性通常带来大量计算开销;基于差分隐私(dp)的联邦学习,参与者向中间参数添加噪声后上传中央服务器,服务器聚合随机参数并广播结果,却易因大量噪声造成模型精度损失,相比之下,基于函数加密(fe)的联邦学习更好地平衡了安全性和性能,具有更强实用性,多输入函数加密(mife)是应用于基于fe的联邦学习的有前景技术,可使多个参与者加密明文,拥有解密密钥的参与者能进行函数求值且输入来自多个参与者,在联邦学习中,mife一般用于保护本地模型参数不被中央服务器泄露,但不能阻止服务器获取全局模型参数,因此,现有基于mife的联邦学习框架存在多种安全风险,例如中央服务器可组合不同轮次密文和解密密钥以揭示原始数据有价值信息,且会话密钥在参与者之间共享并多次使用,导致中央服务器可获得与同一会话密钥对应的多组参数,从而通过组合这些参数获得明文信息。

3、因此,有必要提供基于多客户端内积函数代理重加密隐私保护联邦聚合方法解决上述技术问题。

技术实现思路

1、本发明提供基于多客户端内积函数代理重加密隐私保护联邦聚合方法,解决了不能阻止中央服务器获取全局模型参数,可能导致原始数据有价值信息被泄露和因同态加密复杂性通常带来大量计算开销,以及会话密钥在参与者之间共享并多次使用,使中央服务器可通过组合多组参数获得明文信息的问题。

2、为解决上述技术问题,本发明提供的基于多客户端内积函数代理重加密隐私保护联邦聚合方法,包括以下四个步骤,分别为初始化阶段、本地训练阶段、联邦聚合阶段和参数更新阶段,具体如下:

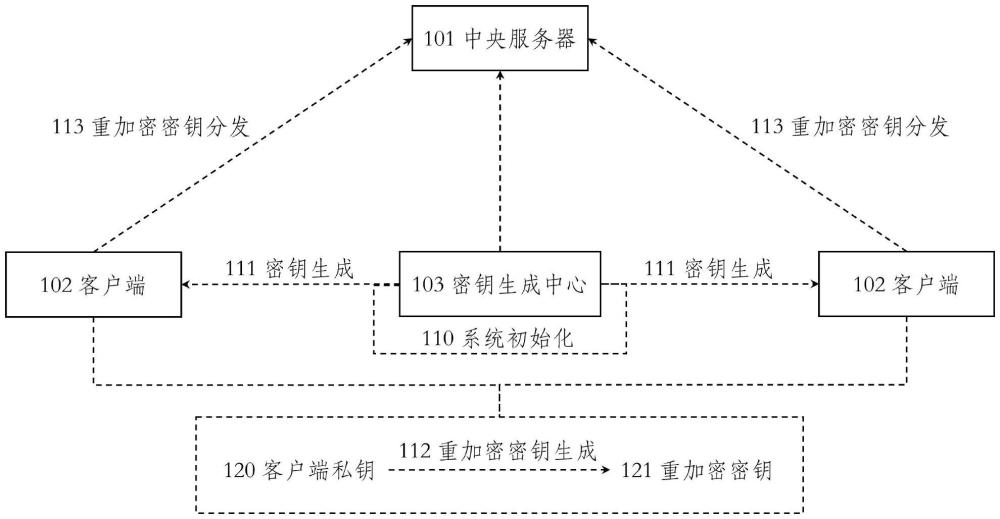

3、初始化阶段:步骤110,密钥生成中心(kgc)输入安全参数λ并调用群生成算法,随后选取哈希函数零eki=si,公共参数和主密钥分别可以表示为和msk=((eki)i),kgc对公共参数pp进行广播并在安全区域存储主密钥msk;

4、步骤111,密钥生成中心(kgc)输入主密钥msk=(si)i以及一个向量并返回解密密钥给每个客户端,对于kgc计算并令解密密钥为最终kgc发送解密密钥给每个客户端;

5、步骤112,随机选择一个客户端,该客户端选取随机数对于i∈[m],客户端j∈[n]计算并发送rk给中央服务器;

6、本地训练阶段:步骤201,每个客户端利用本地数据在本地进行模型训练,得到训练后的本地模型参数;

7、步骤202,对于步骤201中得到的每一维模型参数xi,客户端计算随后计算密文可以表示为

8、步骤203,每个客户端上传步骤202中加密后得到的参数密文cti到中央服务器;

9、联邦聚合阶段:步骤204,中央服务器收集每个客户端发送的模型参数密文,对于i∈[m],中央服务器用重加密密钥rk对原始密文cti进行重加密,计算ct′;

10、步骤205,每个客户端从中央服务器下载聚合后的模型参数密文ct′至本地;

11、参数更新阶段:步骤206:每个客户端用自己的解密密钥对获取到的密文进行解密,即拥有dk=s′的客户端计算并得到内积结果

12、步骤207,每个客户端利用步骤206中得到的内积结果对本地模型参数进行更新,并利用更新后的参数进行下一轮迭代;

13、每个客户端和中央服务器重复步骤201至步骤207直至模型收敛。

14、优选的,所述步骤110中的群生成算法为哈希函数为可以把任意字符串映射为群上的元素。

15、优选的,所述步骤202中的nj为客户端j的向量维度。

16、优选的,所述步骤204中的m为向量长度,计算ct′方式为

17、优选的,所述中央服务器包括本体,所述本体的正面开设有多个插接口,所述本体的正面固定安装有安装板,所述安装板的正面开设有安装槽,所述安装框的正面开设有滑槽,所述滑槽的内侧面滑动连接有抵接件,所述安装框的顶部和底部均开设有卡接槽。

18、优选的,所述安装板的顶部和底部的内部均滑动连接有挡板,所述挡板的内部均开设有滑腔,所述滑腔的内侧面设置有弹簧,所述挡板的内部滑动连接有滑杆,所述滑杆的端面设置于所述滑腔的内侧面。

19、优选的,所述挡板的外表面固定安装有卡接块,所述卡接块设置于所述卡接槽的一侧。

20、优选的,所述挡板的一端开设有贯穿槽,所述贯穿槽的内侧面固定安装有海绵垫。

21、优选的,所述滑槽的内部和所述卡接槽的内侧面相贯通。

22、优选的,所述安装板正面的顶部和底部均固定安装有转动座,所述转动座的内侧面转动连接有转动块,所述转动块的一侧固定安装有防护罩,所述防护罩罩设于所述抵接件的外侧面。

23、与相关技术相比较,本发明提供的基于多客户端内积函数代理重加密隐私保护联邦聚合方法具有如下有益效果:

24、本发明提供基于多客户端内积函数代理重加密隐私保护联邦聚合方法,通过计算负载主要在于中央服务器的参数聚合阶段,可以充分利用中央服务器的算力优势,降低客户端的资源开销;

25、在参数传递过程中,采用内积函数加密地方式加密模型参数,同时通过代理重加密的思想保证半诚实的中央服务器无法接触任何参数的明文信息,从而保证相关参数的安全性,进一步保证本地数据的隐私性;

26、在模型训练过程中,每个参与方(客户端)无需传输各自本地敏感数据即可利用每一方的数据进行模型训练,从而可以在保证数据隐私地前提下更广泛地利用多方数据训练更精准地模型,适用于对隐私保护要求更为严格地医疗模型训练场景。

技术特征:1.基于多客户端内积函数代理重加密隐私保护联邦聚合方法,其特征在于,包括以下四个步骤,分别为初始化阶段、本地训练阶段、联邦聚合阶段和参数更新阶段,具体如下:

2.根据权利要求1所述的基于多客户端内积函数代理重加密隐私保护联邦聚合方法,其特征在于,所述步骤110中的群生成算法为哈希函数为可以把任意字符串映射为群上的元素。

3.根据权利要求1所述的基于多客户端内积函数代理重加密隐私保护联邦聚合方法,其特征在于,所述步骤202中的nj为客户端j的向量维度。

4.根据权利要求1所述的基于多客户端内积函数代理重加密隐私保护联邦聚合方法,其特征在于,所述步骤204中的m为向量长度,计算ct'方式为

5.根据权利要求1所述的基于多客户端内积函数代理重加密隐私保护联邦聚合方法,其特征在于,所述中央服务器包括本体,所述本体的正面开设有多个插接口,所述本体的正面固定安装有安装板,所述安装板的正面开设有安装槽,所述安装框的正面开设有滑槽,所述滑槽的内侧面滑动连接有抵接件,所述安装框的顶部和底部均开设有卡接槽。

6.根据权利要求5所述的基于多客户端内积函数代理重加密隐私保护联邦聚合方法,其特征在于,所述安装板的顶部和底部的内部均滑动连接有挡板,所述挡板的内部均开设有滑腔,所述滑腔的内侧面设置有弹簧,所述挡板的内部滑动连接有滑杆,所述滑杆的端面设置于所述滑腔的内侧面。

7.根据权利要求6所述的基于多客户端内积函数代理重加密隐私保护联邦聚合方法,其特征在于,所述挡板的外表面固定安装有卡接块,所述卡接块设置于所述卡接槽的一侧。

8.根据权利要求7所述的基于多客户端内积函数代理重加密隐私保护联邦聚合方法,其特征在于,所述挡板的一端开设有贯穿槽,所述贯穿槽的内侧面固定安装有海绵垫。

9.根据权利要求8所述的基于多客户端内积函数代理重加密隐私保护联邦聚合方法,其特征在于,所述滑槽的内部和所述卡接槽的内侧面相贯通。

10.根据权利要求9所述的基于多客户端内积函数代理重加密隐私保护联邦聚合方法,其特征在于,所述安装板正面的顶部和底部均固定安装有转动座,所述转动座的内侧面转动连接有转动块,所述转动块的一侧固定安装有防护罩,所述防护罩罩设于所述抵接件的外侧面。

技术总结本发明提供基于多客户端内积函数代理重加密隐私保护联邦聚合方法,包括以下四个步骤,分别为初始化阶段、本地训练阶段、联邦聚合阶段和参数更新阶段,具体如下:初始化阶段:步骤110,密钥生成中心(KGC)输入安全参数λ并调用群生成算法。本发明提供的基于多客户端内积函数代理重加密隐私保护联邦聚合方法,通过计算负载主要在于中央服务器的参数聚合阶段,可以充分利用中央服务器的算力优势,降低客户端的资源开销;在参数传递过程中,采用内积函数加密地方式加密模型参数,同时通过代理重加密的思想保证半诚实的中央服务器无法接触任何参数的明文信息,从而保证相关参数的安全性,进一步保证本地数据的隐私性。技术研发人员:李瑞受保护的技术使用者:河北雄安易泰智方医疗科技有限公司技术研发日:技术公布日:2025/1/6本文地址:https://www.jishuxx.com/zhuanli/20250110/353820.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。