一种基于人工智能的人体嗓音检测分析方法

- 国知局

- 2024-06-21 10:40:20

本发明人工智能和大数据结合医学实施应用的交叉,其将大数据、人工智能、神经网络与人体声学特征实现了融合,具有来说就是一种基于大数据和人工智能实现人体声音分析检测方法。

背景技术:

1、发声是正常人从诞生之日起就具备的一项基本能力。随着年龄的增长,每个人的发声特征都会发生变化,特别是处于疾病状态时,人体的声音通常会发生比较大的变化。从人群来划分,男性和女性在声音的特征上必然有着显著区别;对某些特定职业的人群,发声也是其职业的一种标志,如,歌唱演员、播音节目主持人等。

2、如果不考虑每个人个体成长所造成的嗓音变化,通常由于创伤、生理疾病、心理疾病以及医源性病因都会导致声音的变化,这种变化可能出现在各年龄层的人群中,尤其是日常生活中需要语言沟通较多的人群,例如教师、医生、 广播员、演员、律师、电话销售员、急救人员、警察等如果声音发声变化将对个人生活造成影响。由于上述各行业,其声音都有着自身的特征,很多期望从属该行业的人群也可能会根据需要进行特定声音的训练以达到特定发声的目的,例如,如果想成为高音、低音歌唱家就必须坚持进行特定的声音训练。在现有的声音训练过程中,通常是通过反复听说来进行听觉上的鉴别来判断训练和声音改变效果的,这种方法具有极大的不确定性,无法定量准确获知发声和标准声音之间的差别,从而导致练习过程进入错误的方向而造成精力上的耗费。

3、此外,声音从自然物理学角度来分析,其本质就是振动所形成的波。波从数学上最终的决定参数就是振幅,周期,频率,相位,波长等一些列特征参数。因此,不同人群发出的声音不同必然在可以通过这些参数上予以区别和表征,这种声波的表征方式更参数化、准确定量化。人体发声参数化通常可以通过音频采集设备进行收集和分析,这些采集到的音频数据通过数字化,就可以进行对比其差别和影响。随着大数据分析和获取技术的发展,如何将该技术与不同人群的发声相结合,通过数据的分析和检测获得对声音效果影响的各个参数,并根据这些参数来提出特定的训练目标是大数据分析和医学发展的一个重要研究方向。

技术实现思路

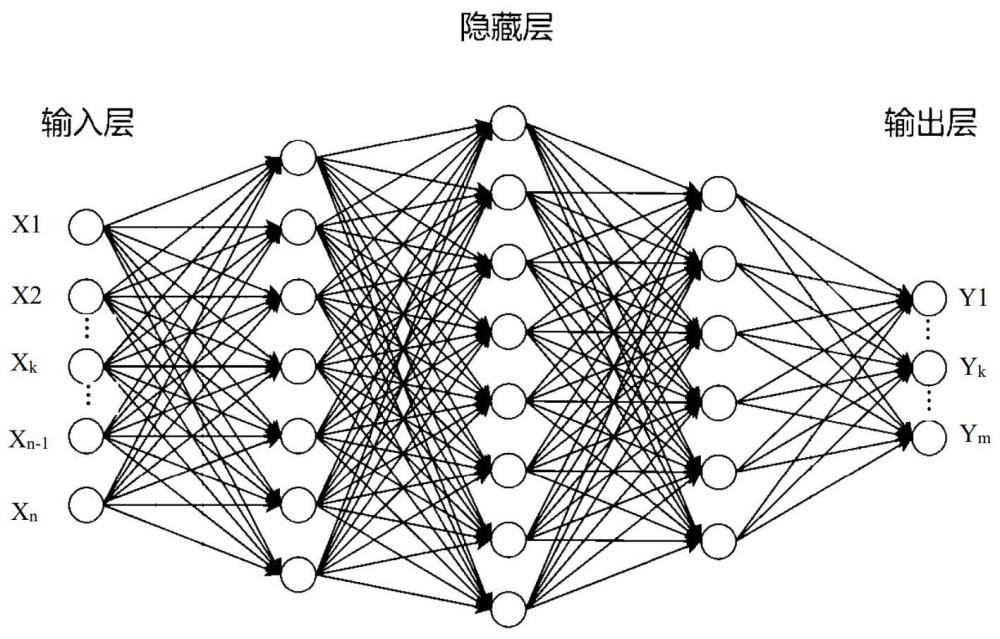

1、本申请为了实现对不同人群的嗓音数据进行定量准确分析,并为后续特定嗓音的形成提出训练针对性。本申请就是结合嗓音大数据,构建神经网络模型分析获得不同嗓音特征所对应的声音参数特征,从而为特征嗓音和声音参数之间构建起关联。

2、实现上述发明目的,本申请采用的技术方案为:一种基于人工智能的人体嗓音检测分析方法,该方法包括如下步骤:

3、s1、人体嗓音数据的采集和预处理;每条嗓音数据根据但不限于年龄、性别、职业进行标识;该嗓音数据预处理所获取的音频参数包括但不限于线性参数、非线性参数、复合参数;其中的线性参数包括但不限于基频、频率微扰、振幅微扰、信噪比、谐噪比;非线性参数包括但不限于频谱收敛比、发散率rod、非线性频谱能量差比、嗓音类型分布图;复合参数包括但不限于嗓音障碍严重程度指数、嗓音障碍倒谱指数、声学嗓音质量指数和声学呼吸指数;

4、s2、将s1步的数据划分为训练数据集、验证数据集和测试数据集;这里的训练数据集、验证数据集和测试数据集是动态变化的数据集,根据后续步骤的复合模型训练过程来进行动态改变;

5、s3、根据s2步中的训练数据集及其标识信息构建复合前馈神经网络模型,该神经网络模型的输出为不同标识信息对于人体嗓音输出特征量;该输出特征量与嗓音的频率参数相对应匹配;

6、s4、将验证数据集与s3步的复合前馈神经网络模型输出进行比较判断是否匹配,不断更新和扩展训练数据集中的数据完善该复合前馈神经网络模型;

7、s5、将测试数据集作为s4步获得的复合前馈神经网络模型输入参数进行测试,从测试嗓音输出特征获得测试嗓音和最佳标识相应最佳特征之间的差异性,从而确定该嗓音的缺陷。

8、上述整个s1-s4步的复合前馈神经网络模型在输入一条嗓音信息后都进行一次网络学习和更新。

9、该复合前馈神经网络模型在测试使用中仅需输入测试嗓音数据而不再进行标识。

10、该复合型前馈神经网络应用于人体嗓音检测和分析,根据输出特征量获得特点嗓音特点训练对象和目标。

11、本申请的技术方案,充分利用了人体嗓音输入的大数据,通过数据训练构建复合前馈神经网络模型,该神经网络模型可以嗓音参数进行分析获的影响嗓音各个状态的特征参数,通过参数比对以明确如果需要获得特点的嗓音特点进行有效训练的特征参数。该方法的神经网络模型提供了一种嗓音检测和分析的特征模型方式,其借助大数据和物理参数给出了生物学特征的判断和分析方法。

技术特征:1.一种基于人工智能的人体嗓音检测分析方法,其特征在于,该方法包括如下步骤:

2.根据权利要求1所述的基于人工智能的人体嗓音检测分析方法,其特征在于,s1步的嗓音数据预处理所获取的音频参数包括但不限于线性参数、非线性参数、复合参数。

3.根据权利要求2所述的基于人工智能的人体嗓音检测分析方法,其特征在于,线性参数包括但不限于基频、频率微扰、振幅微扰、信噪比、谐噪比;非线性参数包括但不限于频谱收敛比、发散率rod、非线性频谱能量差比、嗓音类型分布图;复合参数包括但不限于嗓音障碍严重程度指数、嗓音障碍倒谱指数、声学嗓音质量指数和声学呼吸指数。

4.根据权利要求1所述的基于人工智能的人体嗓音检测分析方法,其特征在于,s2步中的训练数据集、验证数据集和测试数据集是动态变化的数据集,根据步骤s3和s4的复合模型训练过程来变化。

5.根据权利要求1所述的基于人工智能的人体嗓音检测分析方法,其特征在于,s3步训练后的复合前馈神经网络模型的输出特征量与嗓音的频率参数相对应匹配。

6.根据权利要求1所述的基于人工智能的人体嗓音检测分析方法,其特征在于,s1-s4步的复合前馈神经网络模型在输入一条嗓音信息后都进行一次网络学习和更新。

7.根据权利要求1所述的基于人工智能的人体嗓音检测分析方法,其特征在于,该复合前馈神经网络模型在测试使用中仅需输入测试嗓音数据而不在进行标识。

8.根据权利要求1-7任意权利要求所述的基于人工智能的人体嗓音检测分析方法,其特征在于,该复合型前馈神经网络应用于人体嗓音检测和分析,根据输出特征量获得特点嗓音特点训练对象和目标。

技术总结本发明公开了一种基于人工智能的人体嗓音检测分析方法,该方法包括S1嗓音数据的采集和预处理;S2、采集数据划分为训练数据集、验证数据集和测试数据集;S3、训练数据集及其标识信息构建复合前馈神经网络模型,输出为不同标识信息对于人体嗓音输出特征量;S4、验证数据集与复合前馈神经网络模型输出比较判断是否匹配,不断更新完善该复合前馈神经网络模型;S5、将测试数据集作为S4步获得的复合前馈神经网络模型输入参数进行测试,从测试嗓音输出特征获得测试嗓音和最佳标识相应最佳特征之间的差异性,从而确定该嗓音的缺陷。本申请的方法实现了对不同人群的嗓音数据进行定量准确分析,并为特定嗓音的形成提出训练针对性。技术研发人员:闫燕,杜晨,李金红,李涛受保护的技术使用者:北京大学第三医院(北京大学第三临床医学院)技术研发日:技术公布日:2024/1/22本文地址:https://www.jishuxx.com/zhuanli/20240618/21086.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表