数字人视频生成方法及装置、设备、存储介质与流程

- 国知局

- 2024-06-21 10:44:11

本技术实施例涉及人工智能技术,涉及但不限于一种数字人视频生成方法及装置、设备、存储介质。

背景技术:

1、近年来,随着数字人生成技术的发展,数字人在众多场景下使用广泛,例如短视频创作、新闻播报、远程视频会议等。

2、目前,在进行数字人视频生成过程时,需要用户在具有专业录制设备和专业环境的场所中,录制一段含有用户清楚声音且没有杂音的语音以用于声音建模。否则所录制的语音将难以进行声音建模,导致用户声音驱动数字人形象失败。

3、因此目前的数字人视频生成方法,受限于设备造价高昂,仅限具有专业录制设备和专业环境的场所中,难以推广到短视频创作应用场景中。

技术实现思路

1、有鉴于此,本技术实施例提供的数字人视频生成方法及装置、设备、存储介质,不依赖高昂的录音设备和专业的环境,能够推广到短视频创作等应用场景。本技术实施例提供的数字人视频生成方法及装置、设备、存储介质是这样实现的:

2、第一方面,本技术实施例提供的数字人视频生成方法,包括:

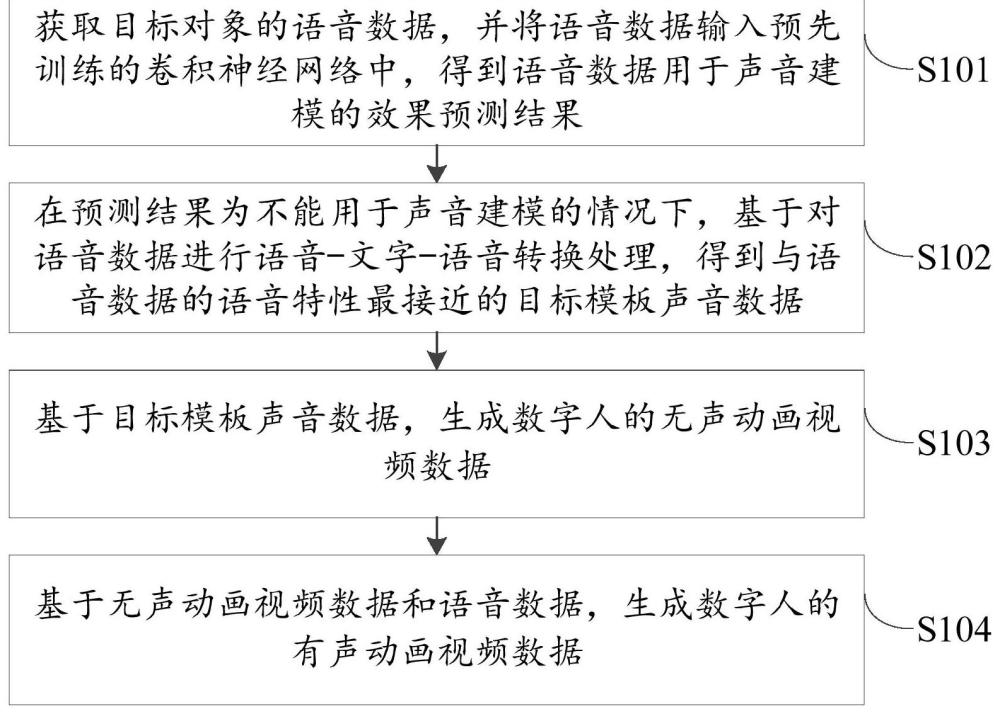

3、获取目标对象的语音数据,并将所述语音数据输入预先训练的卷积神经网络中,得到所述语音数据用于声音建模的效果预测结果;

4、在所述预测结果为不能用于声音建模的情况下,基于对所述语音数据进行语音-文字-语音转换处理,得到与所述语音数据的语音特性最接近的目标模板声音数据;

5、基于所述目标模板声音数据,生成数字人的无声动画视频数据,所述无声动画视频数据表征数字人呈现与所述目标模板声音数据相关的唇部动作和表情;

6、基于所述无声动画视频数据和所述语音数据,生成数字人的有声动画视频数据,所述有声动画视频数据表征数字人播报所述语音数据且呈现与所述目标模板声音数据相关的唇部动作和表情。

7、在一些实施例中,所述预测结果为所述语音数据用于声音建模的置信度,所述在所述预测结果为不能用于声音建模的情况下,基于对所述语音数据进行语音-文字-语音转换处理,得到与所述语音数据的语音特性最接近的目标模板声音数据,包括:

8、在所述置信度小于预设阈值的情况下,对所述语音数据进行降噪处理;

9、基于对降噪处理后的所述语音数据进行语音-文字-语音转换处理,得到与所述语音数据的语音特性最接近的目标模板声音数据。

10、在一些实施例中,所述基于对所述语音数据进行语音-文字-语音转换处理,得到与所述语音数据的语音特性最接近的目标模板声音数据,包括:

11、将所述语音数据转换为文本数据,并利用预设声音模板将所述文本数据转换为模板声音数据;

12、调整所述模板声音数据的语音特性,得到多个具有不同语音特性的模板声音数据;

13、从所述多个具有不同语音特性的模板声音数据中选取与所述语音数据的语音特性最接近的模板声音数据,作为所述目标模板声音数据。

14、在一些实施例中,所述语音特性至少包括语速和语调,所述调整所述模板声音数据的语音特性,得到多个具有不同语音特性的模板声音数据,包括:

15、调整所述模板声音数据的语速和语调,得到多个具有不同语速和语调的模板声音数据。

16、在一些实施例中,所述从所述多个具有不同语音特性的模板声音数据中选取与所述语音数据的语音特性最接近的模板声音数据,作为所述目标模板声音数据,包括:

17、确定所述语音数据的语速类型和语调类型;

18、将与所述语音数据具有相同语速类型和语调类型的模板声音数据,确定为所述目标模板声音数据。

19、在一些实施例中,所述基于所述目标模板声音数据,生成数字人的无声动画视频数据,包括:

20、基于所述目标模板声音数据,生成数字人的唇部动作数据和表情数据;

21、基于数字人的唇部动作数据和表情数据,生成所述数字人的无声动画视频数据。

22、在一些实施例中,所述基于所述无声动画视频数据和所述语音数据,生成数字人的有声动画视频数据,包括:

23、将降噪后的所述语音数据与所述无声动画视频数据进行融合,生成所述数字人的有声动画视频数据。

24、在一些实施例中,所述卷积神经网络的训练过程包括:

25、构建初始卷积神经网络,所述初始卷积神经网络为二维神经网络或三维神经网络;

26、获取样本语音数据,并获取各样本语音数据对应的建模置信度标签;

27、将各样本语音数据,以及各样本语音数据对应的建模置信度标签输入所述初始卷积神经网络,训练得到所述卷积神经网络。

28、在一些实施例中,所述方法还包括:

29、在所述预测结果为能用于声音建模的情况下,基于所述语音数据,生成所述数字人的有声动画视频数据。

30、在一些实施例中,所述语速包括:慢速、中速和快速,所述语调包括升调、降调、平调和曲调。

31、第二方面,本技术实施例提供一种数字人视频生成装置,包括:

32、预测模块,用于获取目标对象的语音数据,并将所述语音数据输入预先训练的卷积神经网络中,得到所述语音数据用于声音建模的效果预测结果;

33、处理模块,用于在所述预测结果为不能用于声音建模的情况下,基于对所述语音数据进行语音-文字-语音转换处理,得到与所述语音数据的语音特性最接近的目标模板声音数据;

34、第一生成模块,用于基于所述目标模板声音数据,生成数字人的无声动画视频数据,所述无声动画视频数据表征数字人呈现与所述目标模板声音数据相关的唇部动作和表情;

35、第二生成模块,用于基于所述无声动画视频数据和所述语音数据,生成数字人的有声动画视频数据,所述有声动画视频数据表征数字人播报所述语音数据且呈现与所述目标模板声音数据相关的唇部动作和表情。

36、第三方面,本技术实施例提供一种计算机设备,包括存储器和处理器,所述存储器存储有可在处理器上运行的计算机程序,所述处理器执行所述程序时实现本技术实施例所述的方法。

37、第四方面,本技术实施例提供一种计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现本技术实施例提供的所述的方法。

38、本技术实施例所提供的数字人视频生成方法、装置、计算机设备和计算机可读存储介质,在获取目标对象的语音数据后,先通过预先训练的卷积神经网络预测目标对象的语音数据是否能用于声音建模,在语音数据不能用于声音建模的情况下,基于对语音数据的语音-文字-语音转换处理,得到与所述语音数据的语音特性最接近的目标模板声音数据,从而生成数字人的无声动画视频数据。由于目标模板声音数据的语音特性与语音数据的语音特性最接近,因此数字人所呈现的唇部动作和表情也能够与目标对象的语音数据良好契合。进而,本技术实施例基于所述无声动画视频数据和所述语音数据,生成数字人的有声动画视频数据,使数字人既能够呈现目标对象的真实语音,又能够呈现与其语音数据具有良好协调性的唇部动作和表情。由于本技术实施例能够基于对语音数据的语音-文字-语音转换处理得到目标模板声音数据,因此用户无需通过专业录音设备和环境录制高要求的语音数据,即使用户上传的语音数据品质不佳,也能够生成与其语音数据具有良好协调性的唇部动作和表情的数字人视频,降低了用户生成数字人视频的操作门槛,尤其适合应用于普通创作者居多的短视频创作应用场景中。

本文地址:https://www.jishuxx.com/zhuanli/20240618/21428.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表