视频处理方法、装置、设备以及介质与流程

- 国知局

- 2024-06-21 11:26:54

本技术涉及互联网,尤其涉及一种视频处理方法、装置、设备以及介质。

背景技术:

1、语音识别技术(automatic speech recognition,asr),也被称为自动语音识别或是语音转文本识别,其目标是通过机器对采集到的用户语音数据进行识别,进而将采集到的用户语音数据转换为相应的文本数据。为了保证模型的准确度,需要收集大量的样本数据对模型进行训练。

2、现有的样本数据获取方案,一般是预先收集一定量的文本数据,然后雇人在安静的环境下对该文本数据进行朗读,通过麦克风采集语音数据,形成样本语音数据集。然而,上述的方案需要耗费大量的时间和人力,效率较为低下。

技术实现思路

1、本技术实施例提供一种视频处理方法、装置、设备以及介质,可以降低语音识别模型的样本数据的获取成本,提高语音识别模型的样本数据获取效率。

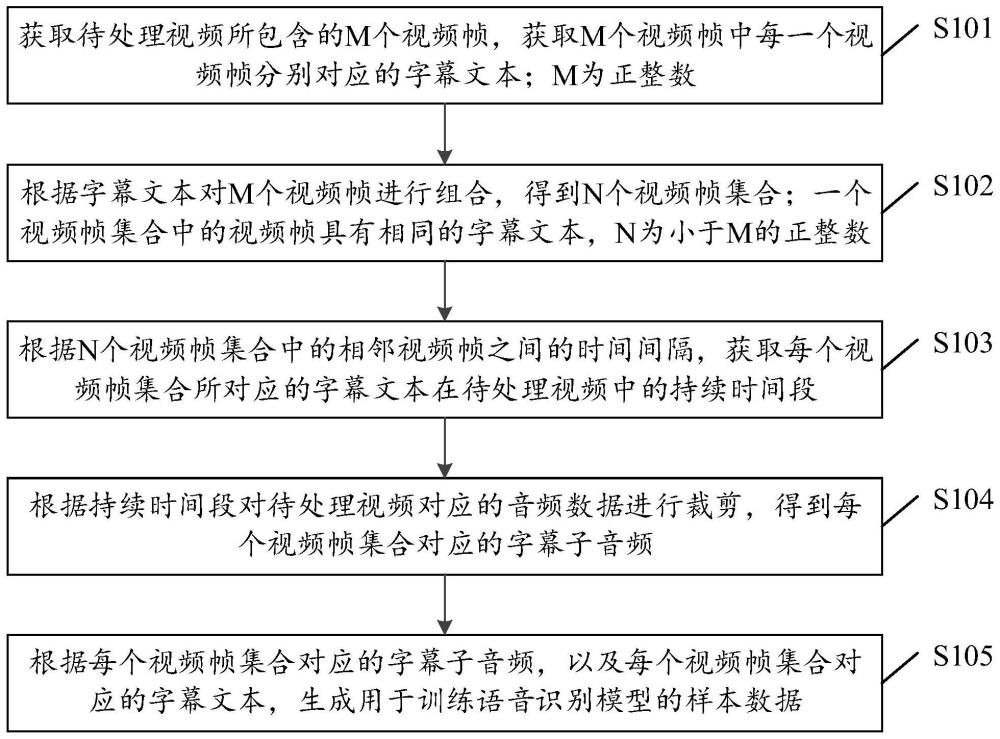

2、本技术实施例一方面提供了一种视频处理方法,包括:

3、获取待处理视频所包含的m个视频帧,获取m个视频帧中每一个视频帧分别对应的字幕文本;m为正整数;

4、根据字幕文本对m个视频帧进行组合,得到n个视频帧集合;一个视频帧集合中的视频帧具有相同的字幕文本,n为小于m的正整数;

5、根据n个视频帧集合中的相邻视频帧之间的时间间隔,获取每个视频帧集合所对应的字幕文本在待处理视频中的持续时间段;

6、根据持续时间段对待处理视频对应的音频数据进行裁剪,得到每个视频帧集合对应的字幕子音频;

7、根据每个视频帧集合对应的字幕子音频,以及每个视频帧集合对应的字幕文本,生成用于训练语音识别模型的样本数据。

8、本技术实施例一方面提供了一种视频处理装置,包括:

9、字幕文本获取模块,用于获取待处理视频所包含的m个视频帧,获取m个视频帧中每一个视频帧分别对应的字幕文本;m为正整数;

10、视频帧组合模块,用于根据字幕文本对m个视频帧进行组合,得到n个视频帧集合;一个视频帧集合中的视频帧具有相同的字幕文本,n为小于m的正整数;

11、持续时间段获取模块,用于根据n个视频帧集合中的相邻视频帧之间的时间间隔,获取每个视频帧集合所对应的字幕文本在待处理视频中的持续时间段;

12、音频数据裁剪模块,用于根据持续时间段对待处理视频对应的音频数据进行裁剪,得到每个视频帧集合对应的字幕子音频;

13、样本数据生成模块,用于根据每个视频帧集合对应的字幕子音频,以及每个视频帧集合对应的字幕文本,生成用于训练语音识别模型的样本数据。

14、其中,字幕文本获取模块包括:

15、文字检测单元,用于对m个视频帧中的第i个视频帧进行文字检测,得到一个或多个文本显示区域;i为小于或等于m的正整数;

16、字幕文本获取单元,用于获取一个或多个文本显示区域的位置信息,根据位置信息确定字幕显示区域,获取字幕文本区域所包含的字幕文本。

17、其中,视频帧组合模块包括:

18、文本转换单元,用于将m个视频帧中的中每一个视频帧分别对应的字幕文本均转换为文本向量,将每一个视频帧所对应的文本向量添加至文本向量集合,从文本向量集合中选择中心向量ti;i为小于或等于n的正整数;

19、相似度获取单元,用于获取文本向量集合中的每个文本向量分别与中心向量ti之间的相似度,若文本向量集合中的文本向量gj与中心向量ti的相似度最大,则将文本向量gj添加至中心向量ti所属的待处理簇ci;j为小于或者等于文本向量集合中所包含的文本向量的数量的正整数;

20、簇更新单元,用于根据待处理簇ci中所包含的文本向量,更新中心向量ti,直至待处理簇ci中更新后的中心向量ti与更新前的中心向量ti相同时,根据待处理簇ci得到视频帧集合。

21、其中,持续时间段获取模块包括:

22、相邻视频帧获取单元,用于获取n个视频帧集合中的第y个视频帧集合,在m个视频帧中的相邻视频帧;y为小于或等于n的正整数;

23、时间间隔获取单元,用于获取相邻视频帧在待处理视频中的排序标识,以及获取相邻视频帧之间的时间间隔;

24、持续时间段获取单元,用于根据排序标识、时间间隔以及相邻视频帧,确定第y个视频帧集合所对应的字幕文本在待处理视频中的持续时间段。

25、其中,音频数据裁剪模块包括:

26、声源分离单元,用于获取待处理视频对应的音频数据,获取音频数据对应的音频特征,根据音频特征对音频数据进行声源分离,得到目标语音音频;

27、音频数据裁剪单元,用于根据持续时间段对目标语音音频进行裁剪,得到每个视频帧集合对应的字幕文本的字幕子音频。

28、其中,样本数据生成模块包括:

29、声纹特征获取单元,用于获取每个视频帧集合对应的字幕子音频的声纹特征,基于声纹特征确定n个视频帧集合对应的字幕子音频之间的相似度;

30、字幕子音频组合单元,用于根据相似度,对n个视频帧集合对应的字幕子音频进行组合,得到p个子音频集合;一个子音频集合中的字幕子音频之间的相似度大于相似度阈值,p为小于n的正整数;

31、样本数据生成单元,用于将每个子音频集合所关联的字幕文本确定为联合文本,为联合文本对应的子音频集合和联合文本之间建立关联关系,基于关联关系生成用于训练语音识别模型的样本数据。

32、其中,该装置还包括:

33、音素识别模块,用于获取每个视频帧集合对应的字幕子音频的音素标注数据,将每个视频帧集合对应的字幕子音频输入至声学模型,通过声学模型输出每个视频帧集合对应的字幕子音频的音素识别结果;

34、声学模型训练模块,用于基于音素识别结果和音素标注数据之间的第一损训练声学模型的模型参数;

35、文本识别模块,用于将音素识别结果输入至语言模型,通过语音模型输出音素标注数据的对应的文本识别结果;

36、语言模型训练模块,用于基于文本识别结果和每个视频帧集合对应的字幕文本之间的第二损失值,训练语言模型的模型参数。

37、本技术实施例一方面提供了一种计算机设备,包括存储器和处理器,存储器存储有计算机程序,计算机程序被处理器执行时,使得处理器执行本技术实施例中一方面中方法的步骤。

38、本技术实施例一方面提供了一种计算机可读存储介质,计算机可读存储介质存储有计算机程序,计算机程序包括程序指令,程序指令被处理器执行时,执行本技术实施例中一方面中方法的步骤。

39、根据本技术的一个方面,提供了一种计算机程序产品或计算机程序,该计算机程序产品或计算机程序包括计算机指令,该计算机指令存储在计算机可读存储介质中。计算机设备的处理器从计算机可读存储介质读取该计算机指令,处理器执行该计算机指令,使得该计算机设备执行上述一方面的各种可选方式中提供的方法。

40、本技术实施例可以获取待处理视频所包含的m个视频帧中每一个视频帧分别对应的字幕文本;然后根据该字幕文本对m个视频帧进行组合,将具有相同字幕文本的视频帧划分到同一个视频帧集合中,得到n个视频帧集合;根据n个视频帧集合中的相邻视频帧之间的时间间隔,获取每个视频帧集合所对应的字幕文本在待处理视频中的持续时间段,进而可以根据每个视频帧集合所对应的字幕文本在待处理视频中的持续时间段,对待处理视频对应的音频数据进行裁剪,得到每个视频帧集合对应的字幕子音频。由于每个视频帧集合对应的字幕子音频,与每个视频帧集合所对应的字幕文本在待处理视频的时间轴上是一致的,因此通过持续时间段可以使得每个视频帧集合所对应的字幕文本与每个视频帧集合所对应的字幕子音频关联。将每个视频帧集合对应的字幕子音频,以及每个视频帧集合对应的字幕文本,生成用于训练语音识别模型的样本数据,可以使得该样本数据具有较高的准确性,进而提高语音识别模型识别的准确性。此外,本技术实施例可以自动生成用于训练语音识别模型的样本数据,节约了大量的人力时间成本,降低了语音识别模型的样本数据的获取成本,提高了语音识别模型的样本数据获取效率。

本文地址:https://www.jishuxx.com/zhuanli/20240618/21583.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表