基于分割一切模型和伪全监督学习的高分辨率遥感图像弱监督目标检测方法

- 国知局

- 2024-07-31 22:59:16

本发明涉及深度学习的,尤其涉及一种基于分割一切模型和伪全监督学习的高分辨率遥感图像弱监督目标检测方法。

背景技术:

1、高分辨率遥感图像目标检测是遥感图像处理领域中最重要的任务之一,旨在识别并定位高分辨率遥感图像中的高价值地物目标。在军事领域,该技术能够用于敌方军事目标的侦察工作,例如对港口、机场、军事基地等重要设施的监测,为军事决策提供关键情报支持。在民用领域中,遥感图像目标检测可用于城市规划中的土地利用、交通规划、城市扩张监测等,为城市规划提供科学依据,因此,遥感图像目标检测在军事和民事等领域发挥着极其重要的应用价值。

2、高分辨率遥感图像全监督目标检测方法需要图像中每个目标实例的类别和位置标签来监督模型的训练,这依赖于大量的完全标注样本,这使得标注工作变得既耗时又费力。相比之下,基于深度学习的弱监督目标检测方法仅需图像级的类别标注,显著降低了标注成本,因此受到了越来越多的关注。

3、随着深度学习的发展,尽管弱监督目标检测方法在遥感图像目标检测中取得了一定的进展,但仍存在两大问题亟待解决:第一个问题:现有方法大多仅依赖类别置信得分来挖掘种子实例,但是,考虑到遥感图像中类内多样性和类间相似性等问题尤为突出,这将导致利用类别置信得分所得到的种子实例是不可靠的,并且具有较高类别置信得分的目标候选框通常仅覆盖目标的最显著部分,这将导致模型也过分关注最显著区域。第二个问题:现有方法大都通过选择性搜索或边缘框来产生目标候选框,但是遥感图像相比于自然场景图像具有更为复杂的背景,同时考虑到选择性搜索或边缘框是早期非深度学习的方法,其所产生的目标候选框仅具由较低的定位精度,这在一定程度上限制了弱监督目标检测的发展。

4、例如申请号为202310845480.0的发明专利公开一种基于boxinst的弱监督猪只图像实例分割方法,利用训练好的boxinst分割模型进行猪只图像实例分割,其中,所述boxinst分割模型的训练进一步包括:构建弱监督数据集;使用搭建的boxinst分割模型对弱监督数据集进行训练,得到训练好的boxinst分割模型;搭建的所述boxinst分割模型由cotsenet骨干提取网络、fpn层和controllerhead层和maskbranch层组成,cotsenet骨干提取网络提取后的特征图传递给fpn层进行多尺度融合,通过controllerhead层进行目标检测及maskbranch层进行最终的像素点预测,通过projectionloss和pairwiseaffinityloss进行梯度反向传播,最终实现基于边界框的弱监督实例分割。该发明用以实现对猪只图像中猪只的分割,在减少制作数据集的成本的同时,能将猪只从图像中分割出来。但是,相较于本技术,该专利中boxinst分割的一个主要缺点是它依赖于边界框(bounding box)标注作为监督信息。这种标注方式虽然比像素级别的标注要简单,但仍然需要一定的人工参与,这增加了数据标注的成本和时间。此外,边界框标注可能无法提供足够的细节信息,导致分割结果的精度受到限制。相比之下,分割一切模型在处理图像分割任务时具有更高的精度和灵活性。

技术实现思路

1、针对现有目标检测方法的目标候选框定位精度较低的技术问题,本发明提出基于分割一切模型和伪全监督学习的高分辨率遥感图像弱监督目标检测方法,基于分割一切模型的伪真值挖掘策略,能够得到更可靠的伪真值实例,进而监督伪全监督目标检测头的训练,能够有效提升高分辨率遥感图像弱监督目标检测的精度。

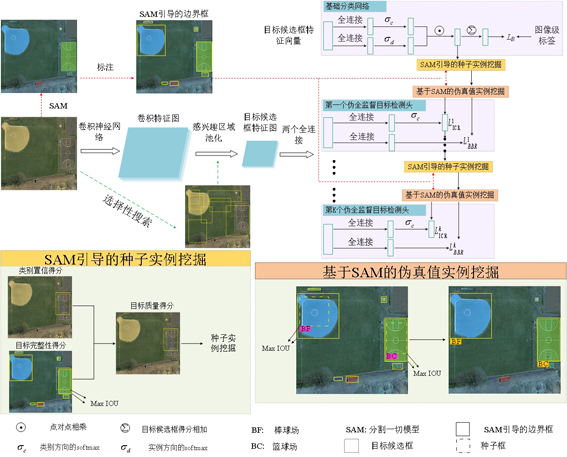

2、为了达到上述目的,本发明的技术方案是这样实现的:一种基于分割一切模型和伪全监督学习的高分辨率遥感图像弱监督目标检测方法,具体步骤包括:

3、s1:构建弱监督深度检测网络,得到弱监督目标检测模型,在弱监督目标检测模型中加入分类优化分支和边界框回归分支,获得弱监督深度检测网络的损失函数、实例分类优化分支损失函数和边界框回归分支损失函数;

4、s2:基于在线实例优化器和边界框回归分支构建伪全监督目标检测头,计算目标完整性得分和目标质量得分,根据mist的种子挖掘策略进行种子实例的挖掘;

5、s3:利用分割一切模型引导的边界框与种子实例匹配交并比完成种子的更新,并进行标签的传播,得到与种子类别相同的伪真值实例;

6、s4:利用伪真值实例替代原始方法所产生的原伪真值实例,对实例分类优化分支损失函数和边界框回归分支损失函数进行调整,得到pfsod head的损失函数;

7、s5:建立总体损失函数对弱监督深度检测网络的损失函数和pfsod head的损失函数进行训练,得到完成训练的弱监督目标检测模型,将待检测图像送入训练后的弱监督目标检测模型获得图像中感兴趣目标的类别和位置。

8、步骤s1所述得到弱监督目标检测模型的具体步骤为:

9、s11:利用选择性搜索算法生成目标候选框;

10、s12:利用检测网络的主干网络处理高分辨率遥感图像和对应的目标候选框,得到目标候选框的特征向量;

11、s13:在弱监督目标检测模型中加入分类优化分支和边界框回归分支,在将目标候选框的特征向量送入检测网络的两个平行分支,获得弱监督深度检测网络的损失函数、实例分类优化分支损失函数和边界框回归分支损失函数。

12、步骤s13所述获得实例分类优化分支损失函数和边界框回归分支损失函数的具体方法为:

13、将目标候选框向量送入检测网络的两个平行分支,每个分支由一个全连接层与一个softmax分类器构成,随后得到两个得分矩阵xc,

14、类别置信得分矩阵可通过下式得到:

15、x=σc(xc)⊙σd(xd);

16、其中,σc、σd分别表示沿类别与目标候选框维度的softmax操作,⊙表示逐元素点乘操作,n表示目标候选框的数量,类别c的图像级预测得分φc的计算方式如下:

17、

18、其中,c表示类别的数目,xc,n∈x表示目标候选框rn在类别c上的置信得分,使用图像级标签监督弱监督深度检测网络的训练,图像级标签用于指示图像中是否存在特定目标类别标签;通过使用图像级标签计算得到弱监督深度检测网络的损失函数lw为:

19、

20、其中,yc=1或0是输入图像的图像级标签,表示输入图像是否包含属于类别c的目标;在弱监督深度检测网络的基础上添加k个分类优化分支,每个分类优化分支包括一个全连接层和一个类别方向的softmax运算;

21、每个分类优化分支输出一个目标候选框类别置信得分矩阵,标记为其中,k为分支数量,k∈{1,2,...,k},表示目标候选框rn在类别c上的目标候选框类别置信得分,第(c+1)类代表背景类,

22、使用实例分类优化分支损失函数训练第k个分类优化分支:

23、

24、其中,表示在第k个分类优化分支类别c下rn的类别置信得分,表示第k个分类优化分支的伪标签,当目标候选框rn属于第k个实例分类优化分支中类别c的伪真值实例时,否则表示目标候选框rn的损失权重,表示第(k-1)个分类优化分支中在类别c上最高的目标候选框类别置信得分;

25、在每个分类优化分支添加一个边界框回归分支,利用伪真值监督边界框回归分支得到边界框回归分支损失函数,边界框回归分支损失函数如下式所示:

26、

27、其中,表示正样本的集合,表示正样本的数量,smooth l1(·)表示smoothl1损失函数,tn和分别表示第k个边界框回归分支目标候选框n的位置和尺寸的预测偏移量和真实偏移量。

28、步骤s2所述进行种子实例的挖掘的具体方法为:

29、s21:基于在线实例优化器和边界框回归分支构建伪全监督目标检测头,得到目标完整性得分;

30、s22:将目标完整性得分和传统的类别置信得分动态加权融合,得到目标质量得分;

31、s23:利用目标质量得分取代传统的类别置信得分,根据mist的种子挖掘策略进行种子实例的挖掘。

32、步骤s21所述基于在线实例优化器和边界框回归分支构建伪全监督目标检测头的具体方法为:

33、将高分辨率遥感图像输入到分割一切模型中,得到每张图像所对应的分割图,利用每块分割区域的顶部、底部、最左边和最右边的像素坐标得到包围每块分割区域的矩形框,获得能够紧密覆盖每块分割区域的分割一切模型引导的分割一切模型引导的边界框,计算分割一切模型引导的边界框与目标候选框之间的交并比,对于每一个目标候选框,选择与其具有最大交并比的分割一切模型引导的边界框,得到该目标候选框的目标完整性得分,目标完整性得分ocsn如下式所示:

34、

35、其中,b代表所有分割一切模型引导的边界框样本集合的集合,|b|代表分割一切模型引导的边界框样本集合的数量,bj代表集合b中第j个分割一切模型引导的边界框,rn代表r中第n个目标候选框,max{·}代表取最大值的操作,iou(·,·)代表目标候选框与分割一切模型引导的边界框之间的交并比运算操作,ocsn表示第n个目标候选框的目标完整性得分。

36、步骤s22所述得到目标质量得分的具体方法为:

37、通过将目标完整性得分和传统的类别置信得分动态加融合得到目标质量得分,如下式所示:

38、

39、其中,α是权重系数,k代表pfsod head的数量,表示在第k个pfsod head中第n个目标候选框属于类别c的置信得分,当k>1时,表示第k-1个pfsod head中目标候选框rn在第c个类别上的类别置信得分,当k=1时,表示基础分类网络中目标候选框rn在第c个类别上的类别置信得分,表示第k个pfsod head中目标候选框在第c个类别上的目标质量得分,权重系数α定义为:

40、

41、其中,n1、30000和200000分别代表当前迭代次数、阈值迭代次数和总迭代次数。

42、步骤s23所述根据mist的种子挖掘策略进行种子实例的挖掘的具体方法为:

43、利用目标质量得分取代传统的类别置信得分进行种子实例的挖掘,根据mist的种子挖掘策略,如果目标质量得分位于前百分之p,那么目标候选框rn将会被选择为第k个实例分类优化分支中属于类别c的初始种子实例;如果目标候选框rn与其他初始种子伪真值实例之间的交并比小于阈值th,那么目标候选框rn将会被选择为最终种子实例。

44、步骤s3所述得到与种子类别相同的伪真值实例的具体方法为:

45、利用分割一切模型引导的边界框与种子实例进行匹配,计算两者之间的交并比,当交并比小于所设定阈值时,代表种子实例没有匹配到对应的分割一切模型引导的边界框,当交并比大于设定阈值且存在多个种子实例匹配的同一个分割一切模型引导的边界框时,选择与分割一切模型引导的边界框交并比最大的种子实例与之匹配,最后将种子的类别信息赋予分割一切模型引导的边界框,完成了种子实例的更新;利用更新后的种子实例进行标签传播,与种子实例的交并比位于[0.5,1]区间的目标候选框被标记为与种子类别相同的伪真值实例

46、步骤s4所述利用伪真值实例替代原始方法所产生的原伪真值实例的具体方法为:

47、利用伪真值实例替代原始方法所产生的伪真值实例,相对应的损失函数也应该被调整为:

48、

49、

50、其中,当目标候选框rn属于时,则否则第k个pfsod head的损失函数为:

51、

52、步骤s5所述总体损失函数包括:弱监督深度检测网络的训练损失lw和k个pfsodhead的训练损失

53、

54、本发明的有益效果为:使用选择性搜索算法为图像生成一系列目标候选框,依次计算目标候选框类别得分和图像的类别预测得分,来训练弱监督深度检测网络;将目标候选框与分割一切模型引导的分割框进行交并比运算得到目标完整性得分和目标质量得分;根据目标质量得分来挖掘伪全监督目标检测头的种子实例;将种子实例与分割一切模型引导的边界框进行交并比运算来更新种子实例;随后进行标签传播得到伪真值实例;依据伪真值实例来监督伪全监督目标检测头的训练。本发明通过设计的分割一切模型引导的种子实例挖掘策略,能够挖掘出高质量的种子实例;通过设计了一种新颖的基于分割一切模型的伪真值挖掘策略,能够得到优质的伪真值实例并监督伪全监督目标检测头的训练,从而有效地提升高分辨率遥感图像弱监督目标检测的检测精度。本发明能够有效提升伪标签挖掘的鲁棒性,可以有效提升图像弱监督目标检测的准确性。

本文地址:https://www.jishuxx.com/zhuanli/20240730/195614.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。