生产线上产品人工装配流程的自学习及检测方法

- 国知局

- 2024-07-31 23:13:07

本发明涉及一种自学习及检测方法,特别是一种生产线上产品人工装配流程的自学习及检测方法。

背景技术:

1、随着工业智能化数字化进程的不断推进,制造业的智能化需求已经不仅仅是生产线的智能化,由于小家电生产的灵活性、定制化、特异性和成本控制,大量的部件需要通过人工选择、安装的方法进行作业,不能被机器所替代。所以对生产过程中生产线人员装配行为中的漏件检测,也是制造业智能化进程中重要的环节。因此,生产线管理中,生产线一线工作人员操作流程是否严格规范,选取的零部件是否正确是影响生产质量的重要环节。现有技术通常依赖经过专业培训的人员来操作,但人工操作难免会出现流程不规范、选择错误零部件等问题。某些零部件差异微小,难以通过肉眼在短时间内准确辨别。这可能导致零部件选择不符合需求,进而引发质量问题,如零部件错装、漏装等,影响生产效率和成品率。

2、目前漏件、缺件检测在各行各业中采用的方法有很多。在电控板元件生产中,对电控板的质量要求特别严格,而电控板上的元器件数量较多并且分布密集, 操作人员由于长时间工作导致的视觉疲劳、肉眼的主观误差、不连续的缺陷发觉等无法满足生产要求。通过图像处理技术,根据电控板存在的特征,选用harris算子进行特征点的提取,利用图像的灰度值模板匹配法实现电控板漏件、错件的质量检测,该算法对电控板的质量检测有较高的正确率。

3、除了直接对成品进行质量检测之外,通过对工人的行为进行识别也是装配生产中重要的方式。北京海研自动化科技有限公司研究了一种基于姿态识别的家电装配防差错系统。该系统获取装配工位的图像和操作人员作业视频流,利用alphapose算法对视频流中的人体姿态进行估计,确定操作人员的左手腕和右手腕2d像素坐标,当手腕处于零部件的装配位置时,确定操作动作完成,符合规定装配工艺。该方案在高计算能力的gpu上实现实时监测,确保正确的零部件以正确的方式安装到正确的位置,防止了操作不规范,或者误操作。

4、在汽车自动化生产线生产制造过程中零件装配存在大规模、多品种和高自动化等特征,在自动生产线中添加大量视觉在线检测专机。如视比特机器人自主研发的ai机器视觉柔性在线检测专机,其中多目视觉在线检测方案通过在线检测采用相机固定安装方式,基于多个相机全视角取图实现工件的高效检测;采用眼在手上在线检测方案,由工业机器人携带相机模块,结合调整变位机角度进行移动拍照检测,自研小样本及在线学习技术实现了零件的错装、漏装精准检测。

5、目前,工业市场环境下监控人员操作步骤是否遗漏的技术仍处于发展阶段。监控的场景包括检查工作人员是否漏装部件、漏打螺钉或遗漏附件等。然而,针对人员操作步骤的行为防错技术仍然面临一些技术挑战。例如,仅依靠视觉拍照难以实现精准检测,操作步骤监控存在困难,且方案适应性较差。

6、以视觉检测技术为例,通过视觉检测采集数据时,目标物体由于形状大小各异,以及装配时手部动作的遮挡等因素,导致检测的准确性难以保证。因此,在小家电类型的装配生产线上,难以直接通过图像特征匹配的方法实现检测。同时,基于姿态识别的在线检测算法受实际生产环境中模型精度和大量工位同时进行检测的限制,导致行为识别精度难以保证,并且计算成本高昂。

7、此外,ai机器视觉柔性在线检测专机虽然适用于高自动化生产和大批量生产的流水线,但对于小家电生产线的灵活性、定制化和成本控制等特点,其成本过高。当生产方案和对象发生变化时,调试和训练难度较大。

8、故此,申请人提出了本发明。

技术实现思路

1、本发明的目的是针对装配行为检测中适应不同装配流程的变化时,生产方案和对象发生变化,需要重新对整个程序模型进行训练和调试的成本过大的不足,而提供一种生产线上产品人工装配流程的自学习及检测方法。

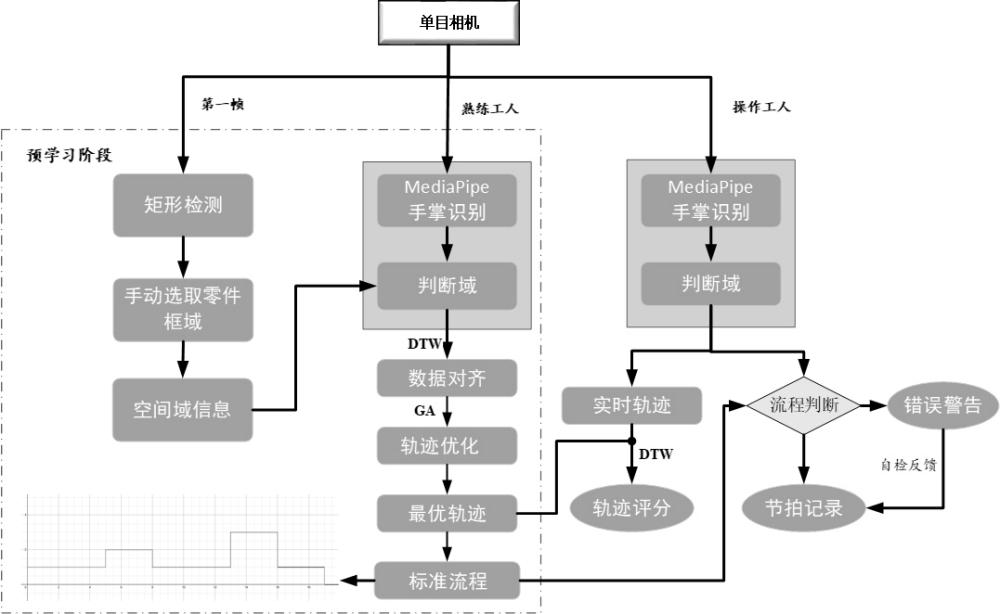

2、为了实现上述目的,本发明所设计的一种生产线上产品人工装配流程的自学习及检测方法,包括:

3、在面对新的装配工序时,首先通过opencv的边缘检测和矩形检测技术对工作区域进行划分,人工将工作区域分为零件区、传送区和装配区;然后,保存工作区域空间信息,并开始学习和调试阶段;

4、在此阶段,多名经验丰富的工人在工位上模拟装配动作,通过结合mediapipe的手掌检测器与byte方法,获取带有方向的手部定位框以定位手掌位置;通过比较手掌位置和工作区域空间确定手掌的区域,同时记录轨迹信息;在收集多名工人的手部轨迹数据后,由于每个工人的演示时间可能有所不同,需要使用动态时间规整算法将不同长度的轨迹数据序列在时间上进行拉伸或压缩,以便找到它们之间最佳的匹配,进行对齐以确保时间上的一致;

5、接下来,使用遗传算法对轨迹参数进行优化搜索,首先将轨迹参数集合初始化为一个种群,定义适应度函数,适应度函数用于评估种群中每个个体的性能,在装配场景中基于装配轨迹的效率和装配路径长度来计算适应度分数,轨迹的效率越高和路径长度越短,适应度分数越高;重复迭代找到适应度最高的个体作为最优轨迹,这个轨迹的区域信息变化顺序代表了装配行为的标准流程,用于指导实际的装配操作,轨迹信息则作为检测操作偏差的参考;

6、在得到标准流程后,当操作工人进行装配时,继续通过结合mediapipe的手掌检测器与byte方法来追踪其手部轨迹并判断区域信息,然后将其与标准流程进行比较,当工人区域信息变化顺序与标准流程不一致,发出警告提醒工人进行自检,工人完成自检后需反馈自检结果,以确保装配工序的完整性;此外,实时地将捕获到的轨迹与遗传算法确定的标准流程轨迹进行比较,通过动态时间规整算法对实时捕获的轨迹和预设的标准流程轨迹进行时间序列分析,以弹性地对齐轨迹点并衡量它们之间的相似性,并计算两个轨迹之间的最小累积距离,得出它们的相似程度,并将该距离转换成一个相似度评分;

7、其中,基于mediapipe手掌识别和byte方法的手掌追踪模型实现流程如下:

8、1.初始化: 设置一个空的轨迹集合t,用于存储视频中各个目标的跟踪信息;

9、2.目标检测: 对于视频序列中的每一帧fk,使用手掌检测器 det预测目标的检测框和分数dk;

10、3.检测结果分类: 将检测结果根据分数阈值τ分为高置信度框 dhigh 和低置信度框 dlow ;

11、4.轨迹预测: 使用卡尔曼滤波算法预测每个现有轨迹t在当前帧的新位置;

12、5.第一次数据关联: 使用相似度度量reid将现有轨迹t与高置信度框dhigh进行关联;

13、6.更新剩余检测和轨迹: 确定在第一次关联后剩余的未匹配检测框dremain1和未匹配轨迹tremain1;

14、7.第二次数据关联: 使用另一个相似度度量iou 将未匹配轨迹tremain1 与低置信度框dlow 进行关联;

15、8.清理未匹配轨迹:从轨迹集合t中删除所有未在第二次关联中匹配的未匹配轨迹tremain2;

16、9.初始化新的轨迹:对于第二次关联后剩余的未匹配检测框dremain2,为每个未匹配检测框dremain2初始化一个新的轨迹,并将其加入轨迹集合t;

17、10.返回结果:返回更新后的轨迹集合t,代表视频中所有目标的跟踪路径。

18、针对小家电生产过程中,装配行为具有灵活性、装配工艺复杂、定制化和成本控制等特点,在保证识别精度的前提下,提供了一种更加快速、低成本、易于推广的生产线上产品人工装配流程的自学习及检测方法。该方法和现有技术相比较,其具备以下的技术优点:

19、1.使用手部目标追踪算法代替姿态识别算法实现装配行为中的手腕定位。在实际生产过程中由于人体会存在大量遮挡,现有的姿态识别算法精度难以保证,识别到的大部分关节点并没有使用,主要依靠手腕关节点,且需要的算力较高。使用mediapipe中基于ml的手掌检测器,该检测器能够检测被遮挡和自遮挡的手,在实现了更高的95.7%的平均精度同时,需要的算力更小。

20、2.结合mediapipe的手掌检测器与byte方法保证追踪手部轨迹,利用检测框和跟踪轨迹之间的相似性,在保留高分检测结果的同时,从低分检测结果中去除背景,挖掘出真正的物体(即使在手部遮挡、模糊等困难样本),从而降低漏检并提高轨迹的连贯性。

本文地址:https://www.jishuxx.com/zhuanli/20240730/196486.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表