一种基于ViT的海上小目标检测方法

- 国知局

- 2024-08-22 14:50:02

本发明涉及海上交通智能感知领域,具体为一种基于vit的海上小目标检测方法。

背景技术:

1、雷达和声呐等传统的船舶感知系统虽能实时监控海上环境,但在检测小型或部分浸没目标方面却表现不佳。此外,上述系统需要处理来自多种传感器的数据,这不仅增加了计算复杂性,也带来了数据融合过程中产生的时空对齐和误差校准问题。这些限制会影响船舶的操作效率和航行安全。

2、在小目标检测方面,现有方法面临的挑战包括目标的尺寸小、特征信息少、容易受到遮挡和环境因素影响等问题,传统的基于锚框的目标检测方法在处理小目标时,因锚框与目标尺寸和形状匹配度低与目标关注度较低,难以对小目标进行准确分类和定位。

3、本发明提出了一种基于vit的海上小目标检测方法,该方法引入基于vit的swin-transformer主干网络,通过滑动窗口机制,高效地提取图像中的细微特征和全局特征。进一步,针对锚框与目标尺寸和形状匹配度低与目标关注度较低问题,提出基于预测位置信息与分数信息的样本输入权重动态更新策略(prd),提升模型对小目标的检测效果。

技术实现思路

1、本发明的目的在于提供一种基于vit的海上小目标检测方法,以解决上述背景技术中提出的问题。

2、为实现上述目的,本发明提供如下技术方案:

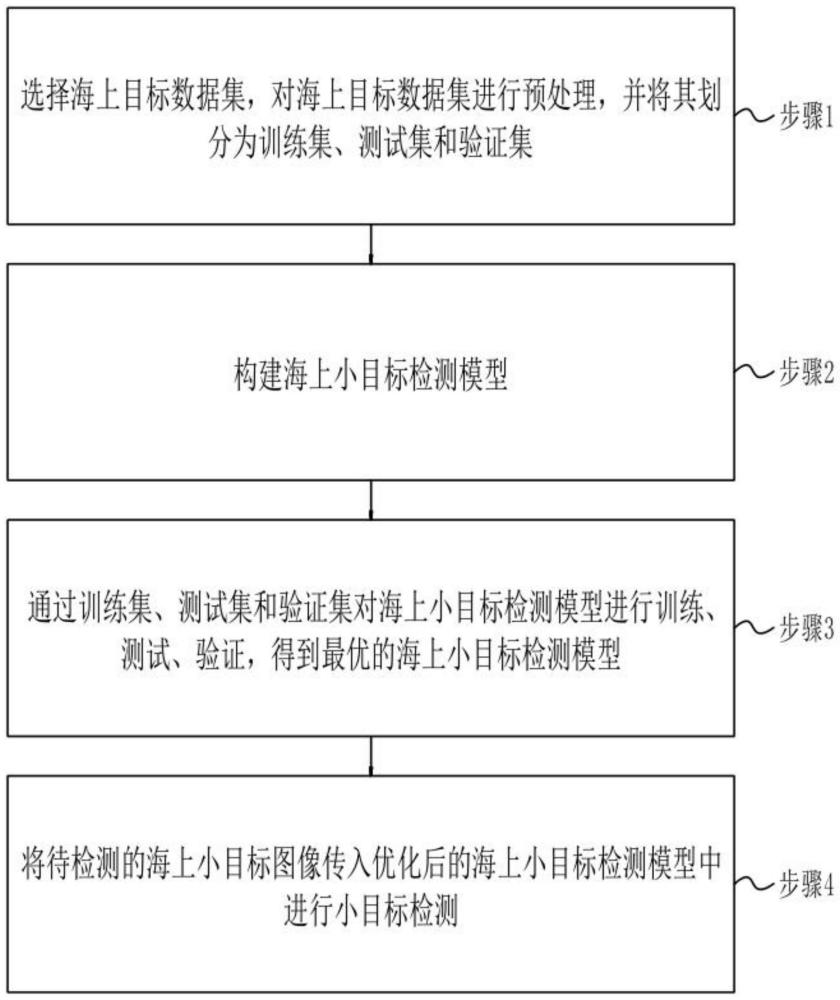

3、一种基于vit的海上小目标视觉检测方法,包括以下步骤:

4、步骤1,选择海上目标数据集,对海上目标数据集进行预处理,并将其划分为训练集、测试集和验证集;

5、步骤2,构建海上小目标检测模型;

6、步骤3,通过训练集、测试集和验证集对海上小目标检测模型进行训练、测试、验证,得到最优的海上小目标检测模型;

7、步骤4,将待检测的海上小目标图像传入优化后的海上小目标检测模型中进行小目标检测。

8、进一步地,所述步骤1中的预处理包括:

9、s1,对海上目标数据集进行多种数据增强,扩充数据集样本;

10、s2,用copy-paste方法,增加小目标样本数量,从而增强小目标权重。

11、进一步地,所述s2具体包括:

12、s201,提取:从扩充后的数据集中选取包含不同海上目标(如船只、浮标等)的图像,这些图像具有不同的环境条件(如光照、天气、水面纹理等);

13、s202,小目标截取:对s201选取的图像进行目标检测和分割,将小目标对象从其原始背景中分离出来,得到纯净的小目标对象图像;

14、s203,背景图像选择:从其他数据源中选取一些只包含水面背景的背景图像,这些背景图像也具有不同的环境条件,以增加数据的多样性;

15、s204,小目标对象粘贴:将s202提取出的小目标对象图像随机地粘贴到s203,选取的背景图像上,生成新的合成图像。

16、进一步地,所述s204还包括:在粘贴过程中,对小目标对象图像进行一些随机变换,如缩放、旋转、翻转等,以模拟不同的视角和姿态。

17、进一步地,所述海上小目标检测模型包括swin-transformer、dynamic head、prd策略、dino头部网络;

18、swin-transformer作为海上小目标检测模型的主干网络,主要负责提取图像的特征。通过使用窗口化的自注意力机制,处理图像中的局部特征,并通过层次化的结构逐渐扩展感受野,以捕获更广泛的上下文信息。这种结构使得网络在处理不同尺寸的图像时更加灵活和高效;

19、dynamic head颈部网络用于在从主干网络提取的特征图之间建立连接,并进行特征融合。它动态地调整其模块的结构来适应不同的目标尺寸和形状,优化特征传递路径,从而提高模型对各种目标的检测精度。

20、通过prd策略,引入预测位置信息和分数信息来动态更新样本输入权重,通过更合理的样本权重分配,增强小目标样本权重,进而实现更细致的小目标检测效果;

21、dino head作为头部网络,负责目标的分类和边界框的精确定位,通过接收颈部网络dynamic head输出的特征图,并通过一系列优化的网络层来判断每个候选区域的类别并精确计算其边界框的位置。

22、进一步地,所述dynamic head的处理过程分为三个注意力计算过程,分别是尺度注意力、空间注意力和通道注意力,其计算过程为:

23、w(f)=πc(πs(πl(f)·f)·f)·f

24、其中,w表示注意力计算函数,f代表输入的三维特征张量,πl、πs、πc分别指代特征图的层次、宽高乘积以及通道数,尺度注意力、空间注意力和通道注意力模块分别针对其特定的维度执行注意力操作。

25、进一步地,所述prd策略的流程包括:

26、s301,将特征图进行粗检测,生成若干的预检框b,作为后续精细检测的基础,为了确保预测框的准确性,采用平滑l1损失函数对其进行监督学习,该损失函数计算预测框b与真实标注框之间的差异,这一过程表示为:

27、

28、其中,b表示预测框的坐标,g表示真实标注框的坐标,i表示坐标的各个维度,即中心点的(x,y)坐标和宽w、高h,bi与gi表示边界框的具体参数,平滑l1损失函数的具体形式可表示为:

29、

30、其中,if|x|<1表示x的绝对值小于1。

31、s302,按置信度选取其中top k个预检框,并按照它们的位置生成特征权重增强掩码m,这一过程可以为:

32、

33、

34、其中,i、j表示当前像素的位置,mi,j表示图像中对应像素位置的权重,bk表示预检框,指示函数表示当前位置是否在预检框bk内,若在则置为1,否则置为0;

35、s303,将特征权重增强掩码m归一化并作为权重调整特征,提升特征对预检框区域的响应,其过程可表示为:

36、

37、其中,fm表示原始特征图,fm'表示增强后的特征图,α为超参数,用于控制特征响应放大倍数,max(m)为特征权重增强掩码m中的最大值。

38、通过这一操作,将潜在目标区域的特征响应放大α倍,从而提升模型对潜在目标区域的关注度,有利于模型捕捉其特征和位置信息。

39、与现有技术相比,本发明的有益效果是:

40、1)本发明采用vit(vision transformer)方式提取图像特征,通过其层次化的transformer结构能够有效地捕捉不同尺度的特征,这使得它在处理远距离小目标或近距离大目标时都能表现出色;采用动态的注意力机制,这使得模型可以根据输入的数据动态调整其处理方式,从而提升模型的泛化性;

41、2)本发明用dynamic head进行高效的特征融合,通过自注意力机制有效地提升了模型对不同尺度特征的鉴别能力;

42、3)本发明提出prd策略,通过渐进检测的方式,有效提升了模型对小目标区域的关注程度,从而提升了小目标的检测效果。

本文地址:https://www.jishuxx.com/zhuanli/20240822/280053.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。