基于云台的视觉追踪校正方法、装置、设备及存储介质与流程

- 国知局

- 2024-09-11 15:10:16

本发明涉及目标追踪,尤其涉及一种基于云台的视觉追踪校正方法、装置、设备及存储介质。

背景技术:

1、随着智能设备和移动互联网技术的发展,人们可以随手记录自己的精彩生活,为了进一步的提高拍摄质量,手持性云台设备作为提高拍摄质量的一种便携性设备逐渐受到人们的追捧。其中,手持性云台设备中的视觉追踪系统对稳定拍摄目标画面起着至关重要的作用,以实现精确地定位和跟踪动态目标,并在多变的环境中保持高度的稳定性和准确性。然而,由于外界环境的复杂性,如光照变化、遮挡、以及目标的快速移动,现有云台的视觉追踪系统面临着一系列挑战。尤其是在追踪精度和实时性方面,传统云台的视觉追踪系统往往难以满足高性能的要求,即现有云台的视觉追踪系统的无法动态调整与视觉追踪算法,以致对相关目标定位和校正的准确率较低。

技术实现思路

1、本发明的主要目的在于解决现有云台的视觉追踪系统的无法动态调整与视觉追踪算法,以致对相关目标定位和校正的准确率较低的问题。

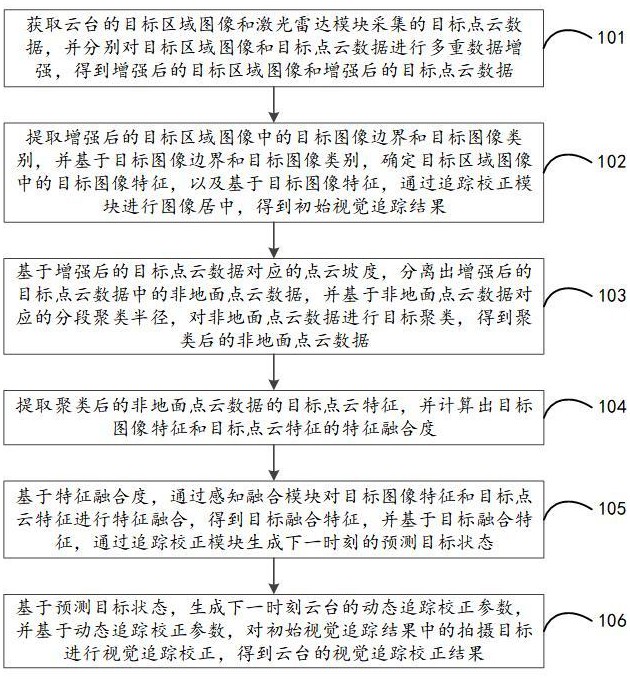

2、本发明第一方面提供了一种基于云台的视觉追踪校正方法,应用于视觉追踪校正系统,所述视觉追踪校正系统包括激光雷达模块、感知融合模块和追踪校正模块,所述基于云台的视觉追踪校正方法包括:获取所述云台的目标区域图像和所述激光雷达模块采集的目标点云数据,并分别对所述目标区域图像和所述目标点云数据进行多重数据增强,得到增强后的目标区域图像和增强后的目标点云数据;提取所述增强后的目标区域图像中的目标图像边界和目标图像类别,并基于所述目标图像边界和所述目标图像类别,确定所述目标区域图像中的目标图像特征,以及基于所述目标图像特征,通过所述追踪校正模块进行图像居中,得到初始视觉追踪结果;基于所述增强后的目标点云数据对应的点云坡度,分离出所述增强后的目标点云数据中的非地面点云数据,并基于所述非地面点云数据对应的分段聚类半径,对所述非地面点云数据进行目标聚类,得到聚类后的非地面点云数据;提取所述聚类后的非地面点云数据的目标点云特征,并计算出所述目标图像特征和所述目标点云特征的特征融合度;基于所述特征融合度,通过所述感知融合模块对所述目标图像特征和所述目标点云特征进行特征融合,得到目标融合特征,并基于所述目标融合特征,通过所述追踪校正模块生成下一时刻的预测目标状态;基于所述预测目标状态,生成下一时刻所述云台的动态追踪校正参数,并基于所述动态追踪校正参数,对所述初始视觉追踪结果中的拍摄目标进行视觉追踪校正,得到云台的视觉追踪校正结果。

3、可选的,在本发明第一方面的第一种实现方式中,所述分别对所述目标区域图像和所述目标点云数据进行多重数据增强,得到增强后的目标区域图像和增强后的目标点云数据,包括:对所述目标区域图像进行高斯滤波和图像灰度化,得到灰度化后的目标区域图像,并对灰度化后的目标区域图像进行多曝光融合的图像增强,得到增强后的目标区域图像;基于预设点云分割策略,分割出所述目标点云数据的多个体素网格,并计算出各所述体素网格的中心点坐标,以及基于各所述中心点坐标对所述目标点云数据进行降采样,生成增强后的目标点云数据。

4、可选的,在本发明第一方面的第二种实现方式中,所述提取所述增强后的目标区域图像中的目标图像边界和目标图像类别,并基于所述目标图像边界和所述目标图像类别,确定所述目标区域图像中的目标图像特征,以及基于所述目标图像特征,通过所述追踪校正模块进行图像居中,得到初始视觉追踪结果,包括:提取所述增强后的目标区域图像中的原始特征图,并计算出所述原始特征图各个位置的全局平均池化特征;利用所述全局平均池化特征融合所述原始特征图,得到融合后的原始特征图,并预测所述融合后的原始特征图中的预测边界框,以及匹配所述预测边界框对应真实边界框的多种图像边框参量;计算出所述图像边框参量对应的边框综合损失值,并基于所述边框综合损失值,更新所述图像边框参量直至满足预设的边框损失阈值,生成所述增强后的目标区域图像中的目标图像边界;计算出所述目标图像边界内各个图像目标的类别概率,以及基于所述类别概率,确定所述增强后的目标区域图像中的目标图像类别,并基于所述目标图像边界和所述目标图像类别,提取所述目标区域图像中各个图像目标在二维空间上的目标图像特征;基于所述目标图像特征,从各所述图像目标中确定对满足预设相对运动目标的拍摄目标,并通过所述追踪校正模块对所述拍摄目标进行图像居中,得到初始视觉追踪结果。

5、可选的,在本发明第一方面的第三种实现方式中,所述基于所述增强后的目标点云数据对应的点云坡度,分离出所述增强后的目标点云数据中的非地面点云数据,并基于所述非地面点云数据对应的分段聚类半径,对所述非地面点云数据进行目标聚类,得到聚类后的非地面点云数据,包括:划分所述增强后的目标点云数据的多个点云局部领域,并计算出各所述点云局部领域对应的局部平面法线;计算出各所述点云局部领域对应的点坐标与所述局部平面法线的夹角,得到点云坡度,并判断所述点云坡度是否小于预设的坡度阈值;若所述点云坡度不小于预设的坡度阈值,则分割出所述点云局部领域对应的目标点云数据中作为非地面点云数据,以及移出所述增强后的目标点云数据中的地面点云数据,并计算出各所述非地面点云数据对应点云局部领域的聚类半径;基于所述聚类半径,对所述非地面点云数据进行初始目标聚类,以及在初始目标聚类中,基于预设的分段阈值,调整所述聚类半径,得到分段聚类半径,并基于所述分段聚类半径,对初始目标聚类的结果进行二次聚类合并,直至所述分段聚类半径大于预设的半径阈值,得到聚类后的非地面点云数据。

6、可选的,在本发明第一方面的第四种实现方式中,所述提取所述聚类后的非地面点云数据的目标点云特征,并计算出所述目标图像特征和所述目标点云特征的特征融合度,包括:提取所述聚类后的非地面点云数据中的多种点云边框结构信息,并基于所述点云边框结构信息,确定所述聚类后的非地面点云数据在三维空间上的目标点云特征;对所述目标图像特征和所述目标点云特征进行时空坐标的同步匹配,并计算出匹配后的目标点云特征中三维点在匹配后的目标图像特征中二维图像的三维边界框投影;计算出所述三维边界框投影的二维投影边界框与所述目标图像特征中对应目标图像边界和目标图像类别之间的边界交集区域和边界并集区域,并比较所述边界交集区域和所述边界并集区域之间的重合度,得到特征融合度。

7、可选的,在本发明第一方面的第五种实现方式中,所述基于所述特征融合度,通过所述感知融合模块对所述目标图像特征和所述目标点云特征进行特征融合,得到目标融合特征,并基于所述目标融合特征,通过所述追踪校正模块生成下一时刻的预测目标状态,包括:基于所述特征融合度,通过所述感知融合模块对所述目标图像特征和所述目标点云特征中多种边界框参数进行参数的一致性调整,并计算调整后的目标图像特征和调整后的目标点云特征之间的加权边界框参数;基于所述加权边界框参数,生成目标融合特征,并获取所述云台视觉追踪时的过程噪声矩阵;基于所述目标融合特征和所述过程噪声矩阵,通过所述追踪校正模块中的状态转移模型映射出下一时刻的预测目标状态。

8、可选的,在本发明第一方面的第六种实现方式中,所述基于所述预测目标状态,生成下一时刻所述云台的动态追踪校正参数,包括:提取所述预测目标状态的预测目标特征,并对比所述预测目标特征和所述目标融合特征之间的特征相似度;获取所述云台的当前位置参数和上一时刻的历史位置参数,以及判断所述特征相似度是否大于预设相似度阈值,若所述特征相似度大于预设相似度阈值,基于所述当前位置参数和所述历史位置参数之间的位置差生成下一时刻所述云台的动态追踪校正参数;若所述特征相似度不大于预设相似度阈值,则计算出所述预测目标状态和所述目标融合特征对应的当前目标状态之间的状态差异值,并基于所述状态差异值生成下一时刻所述云台的动态追踪校正参数。

9、本发明第二方面提供了一种基于云台的视觉追踪校正装置,应用于视觉追踪校正系统,所述视觉追踪校正系统包括激光雷达模块、感知融合模块和追踪校正模块,所述基于云台的视觉追踪校正装置包括:数据增强模块,用于获取所述云台的目标区域图像和所述激光雷达模块采集的目标点云数据,并分别对所述目标区域图像和所述目标点云数据进行多重数据增强,得到增强后的目标区域图像和增强后的目标点云数据;特征提取模块,用于提取所述增强后的目标区域图像中的目标图像边界和目标图像类别,并基于所述目标图像边界和所述目标图像类别,确定所述目标区域图像中的目标图像特征,以及基于所述目标图像特征,通过所述追踪校正模块进行图像居中,得到初始视觉追踪结果;目标聚类模块,用于基于所述增强后的目标点云数据对应的点云坡度,分离出所述增强后的目标点云数据中的非地面点云数据,并基于所述非地面点云数据对应的分段聚类半径,对所述非地面点云数据进行目标聚类,得到聚类后的非地面点云数据;计算模块,用于提取所述聚类后的非地面点云数据的目标点云特征,并计算出所述目标图像特征和所述目标点云特征的特征融合度;状态预测模块,用于基于所述特征融合度,通过所述感知融合模块对所述目标图像特征和所述目标点云特征进行特征融合,得到目标融合特征,并基于所述目标融合特征,通过所述追踪校正模块生成下一时刻的预测目标状态;追踪校正模块,用于基于所述预测目标状态,生成下一时刻所述云台的动态追踪校正参数,并基于所述动态追踪校正参数,对所述初始视觉追踪结果中的拍摄目标进行视觉追踪校正,得到云台的视觉追踪校正结果。

10、本发明第三方面提供了一种基于云台的视觉追踪校正设备,包括:存储器和至少一个处理器,所述存储器中存储有指令;所述至少一个处理器调用所述存储器中的所述指令,以使得所述基于云台的视觉追踪校正设备执行上述的基于云台的视觉追踪校正方法的各个步骤。

11、本发明的第四方面提供了一种计算机可读存储介质,所述计算机可读存储介质中存储有指令,当其在计算机上运行时,使得计算机执行上述的基于云台的视觉追踪校正方法的各个步骤。

12、上述基于云台的视觉追踪校正方法、装置、设备及存储介质。本发明实施例中,通过获取云台的目标区域图像和激光雷达模块采集的目标点云数据,并分别对目标区域图像和目标点云数据进行多重数据增强,得到增强后的目标区域图像和增强后的目标点云数据;提取增强后的目标区域图像中的目标图像边界和目标图像类别,并基于目标图像边界和目标图像类别,确定目标区域图像中的目标图像特征,以及基于目标图像特征,通过追踪校正模块进行图像居中,得到初始视觉追踪结果;基于增强后的目标点云数据对应的点云坡度,分离出增强后的目标点云数据中的非地面点云数据,并基于非地面点云数据对应的分段聚类半径,对非地面点云数据进行目标聚类,得到聚类后的非地面点云数据;提取聚类后的非地面点云数据的目标点云特征,并计算出目标图像特征和目标点云特征的特征融合度;基于特征融合度,通过感知融合模块对目标图像特征和目标点云特征进行特征融合,得到目标融合特征,并基于目标融合特征,通过追踪校正模块生成下一时刻的预测目标状态;基于预测目标状态,生成下一时刻云台的动态追踪校正参数,并基于动态追踪校正参数,对初始视觉追踪结果中的拍摄目标进行视觉追踪校正,得到云台的视觉追踪校正结果。相比于现有技术,本技术通过提取摄像头采集的目标区域图像对应的目标图像特征,以及提取激光雷达采集的目标点云数据对应的目标点云特征,进而计算出目标图像特征与目标点云特征之间的特征融合度,从而融合目标图像特征和目标点云特征生成目标融合特征,进而通过预测下个时刻的预测目标状态,生成对应的动态追踪校正参数对初始视觉追踪结果中的拍摄目标进行视觉追踪校正,得到云台的视觉追踪校正结果。利用图像数据和点云数据实现对目标的快速和准确追踪,即使在复杂和动态变化的环境中也能保持高追踪性能,实现了云台对相关目标的动态调整与视觉追踪,提高了对相关目标校正的准确率。

13、本发明的其他特征和优点将在随后的说明书中阐述,并且,部分地从说明书中变得显而易见,或者通过实施本发明而了解。本发明的目的和其他优点在说明书、权利要求书以及附图中所特别指出的结构来实现和获得。

14、为使本发明的上述目的、特征和优点能更明显易懂,下文特举较佳实施例,并配合所附附图,作详细说明如下。

本文地址:https://www.jishuxx.com/zhuanli/20240911/293437.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表