一种基于深度学习的大数据信息处理方法、系统、介质及服务器与流程

- 国知局

- 2024-10-09 16:09:49

本技术涉及大数据信息处理的,尤其是涉及一种基于深度学习的大数据信息处理方法、系统、介质及服务器。

背景技术:

1、随着互联网上公开信息不断的增长,在社交网络、新闻资源、商业、政府系统平台上存在着大量带有主观情感色彩的文本,利用自然语言处理技术,可以对非结构化的文本信息进行观点提取、分析、处理,最后得到结构化的数据,直观的展现给用户。

2、跨领域情感分类(cross-domain sentiment classification)是自然语言处理中的一个重要任务,旨在利用一个或多个有标注情感的数据源来训练模型,以准确分类来自不同领域但无标注情感的数据。由于不同领域之间的语言风格、主题和情感表达方式存在差异,跨领域情感分类面临着巨大的挑战。

3、申请公布日为2019年07月19日,申请公开号为cn110032646a的中国发明专利,提供了一种基于多源领域适应联合学习的跨领域文本情感分类方法,其设计的联合训练的损失函数包括四个部分:情感分类损失、参数迁移损失、领域融合损失和防止过拟合的正则项。情感分类损失包含了源领域任务和目标领域任务上的情感分类损失,软参数迁移的方法可以有效地迁移源领域的情感知识到目标领域中,而深度领域融合可以保证在学习过程中不同领域的边际分布尽可能地相似,尽管该专利通过减小源域和目标域之间的领域差异来实现情感迁移,但未考虑跨领域情感分类问题中,单一分类器造成的领域偏移对分类结果的影响,即:如果单一分类器在源领域上训练得过于充分,它可能会学习到源领域的特定特征或模式,这些特征或模式在目标领域中可能不存在或表现不同,这会导致分类器在目标领域上的性能下降,即出现领域偏移问题。

技术实现思路

1、为了能够降低领域偏移对分类结果的影响,本技术提供了一种基于深度学习的大数据信息处理方法、系统、介质及服务器。

2、第一方面,本技术提供了一种基于深度学习的大数据信息处理方法,采用如下的技术方案:

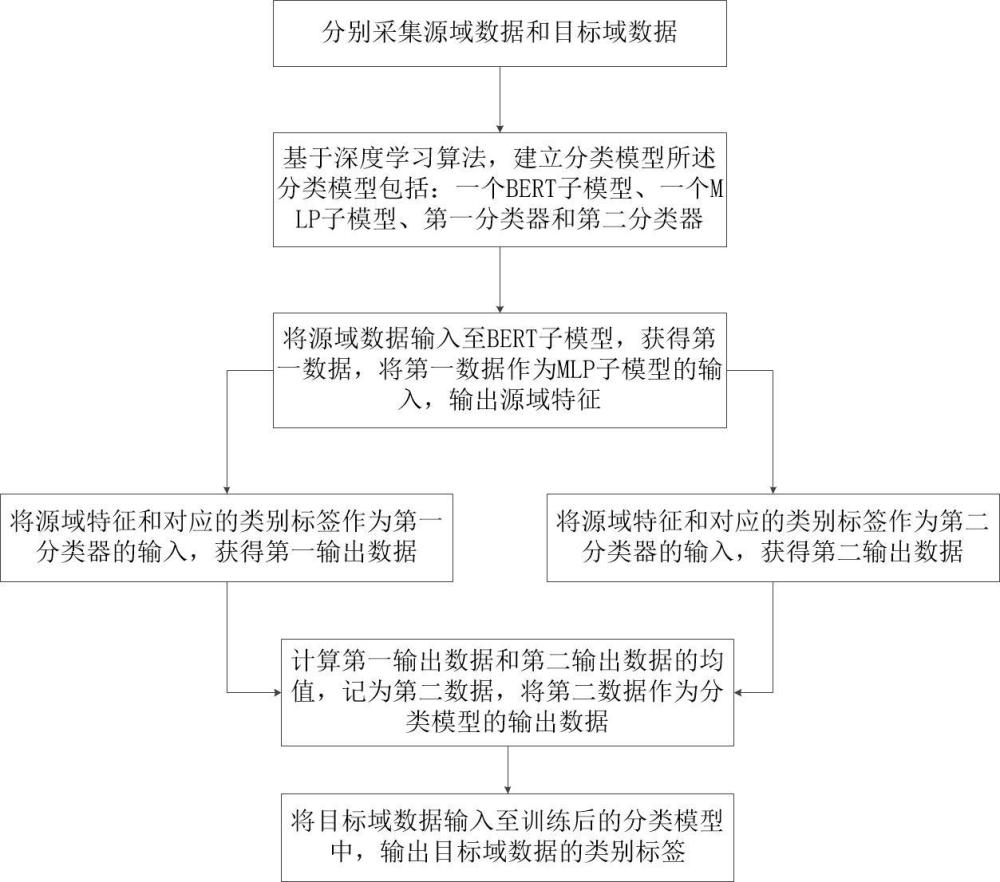

3、一种基于深度学习的大数据信息处理方法,包括以下步骤:

4、数据采集:分别采集源域数据和目标域数据,源域数据带有类别标签,目标域数据无类别标签;

5、建立模型:基于深度学习算法,建立分类模型,所述分类模型包括:一个bert子模型、一个mlp子模型、第一分类器和第二分类器;

6、模型训练:包括第一特征提取、第一训练、第二训练和求解均值;

7、第一特征提取:将源域数据输入至bert子模型,获得第一数据,将第一数据作为mlp子模型的输入,输出源域特征;

8、第一训练:将源域特征和对应的类别标签作为第一分类器的输入,获得第一输出数据;

9、第二训练:将源域特征和对应的类别标签作为第二分类器的输入,获得第二输出数据;

10、求解均值:计算第一输出数据和第二输出数据的均值,记为第二数据,将第二数据作为分类模型的输出数据;

11、分类:将目标域数据输入至训练后的分类模型中,输出目标域数据的类别标签。

12、通过采用上述技术方案,本技术设定了分类模型的结构,通过bert子模型和mlp子模型实现特征提取,并采用了两个分类器,第一分类器和第二分类器,两个分类器的性能是互补的,能够在分类时互补,并在最终输出时计算二者的均值,有助于减少单一分类器因为过度训练带来的偏差,降低领域偏移对分类结果的影响,提高分类模型的泛化能力和鲁棒性。在目标域数据没有标签的情况下,分类模型通过从源域学习到的知识和特征,对目标域数据进行分类,能够在一定程度上克服领域间的偏移,实现对目标域数据的分类。本技术通过bert子模型学习源域数据的特征,通过mlp子模型学习复杂的非线性变化,bert子模型提供了丰富的上下文表示,而mlp子模型则擅长从这些表示中提取和组合特征,二者的结合使得分类模型能够利用上下文信息的同时,还具备优异的特征提取能力,从而更好地应对领域偏移问题。

13、可选地,在执行求解均值的步骤之后,执行分类的步骤之前,还包括:

14、添加标签:选取部分目标域数据,为每个目标域数据添加类别标签,将类别标签记为第三数据;

15、再训练:包括第二特征提取、第三训练和第四训练;

16、第二特征提取:将目标域数据输入至训练后的分类模型的bert子模型中,获得第四数据,将第四数据输入至训练后的分类模型的mlp子模型中,获得目标域特征;

17、第三训练:将目标域特征和第三数据作为训练后的分类模型的第一分类器的输入,获得第三输出数据;

18、第四训练:将目标域特征和第三数据作为训练后的分类模型的第二分类器的输入,获得第四输出数据。

19、通过采用上述技术方案,本技术选取了部分目标域数据,并对其添加类别标签,获得了第三数据(即目标域数据的类别标签),并采用目标域数据和第三数据对训练过的分类模型进行再训练,使分类模型进一步适应目标域的数据分布,提高在目标域上的分类性能。在添加标签的步骤中,本技术尽量保持各个类别的数据平衡,提高分类模型的泛化能力。再训练的步骤中,由于第一分类器和第二分类器的类别不同,能够增加分类模型的多样性,通过对比第三输出数据和第四输出数据的分布差异,可以评估不同分类器的性能,与模型训练的步骤相同,本技术可以通过求解第三输出数据和第四输出数据的均值,能够进一步降低单一分类器可能带来的领域偏差问题的发生概率,进一步提高分类模型的泛化能力和鲁棒性。

20、可选地,在执行第四训练的步骤之后,执行分类的步骤之前,还包括:

21、计算分类差异:计算第三输出数据和第四输出数据的分类差异,计算模型如下:

22、;

23、;

24、;

25、其中,为第三输出数据和第四输出数据的分类差异;为第三输出数据的概率分布;为第i个类别第三输出数据的概率值;为第四输出数据的概率分布;为第i个类别第四输出数据的概率值;d为第三输出数据的概率分布和第四输出数据的概率分布的平均分布;为第i个类别平均分布的概率值,计算模型如下:

26、。

27、通过采用上述技术方案,本技术计算了分类差异,通过分类差异,评估两个分类器(第一分类器和第二分类器)之间的性能差异,如果差异很小,意味着两个分类器在性能上相近(即,两个分类器输出的分类结果类似),表明分类模型训练效果优异,在目标域数据的分类问题上应用效果明显,如果差异很大,则表明它们捕捉到了目标域数据中不同的特征或模式,需要进一步分析。

28、可选地,在执行计算分类差异的步骤之后,执行分类的步骤之前,还包括:

29、最小化分类差异:将分类差异作为对抗性损失,交替更新bert子模型和mlp子模型的参数,直至获得最小的对抗性损失。

30、通过采用上述技术方案,本技术最小化了分类差异,交替更新bert子模型和mlp子模型的参数,直至获得最小的对抗性损失。在此过程中,分类模型能够学习到更加一致和稳定的特征表示,从而提高对噪声、对抗性样本等的鲁棒性,并且有助于分类模型学习到更加泛化的特征,而不是仅仅记住训练数据中的特定模式,减少过拟合的风险,进一步降低领域偏移的影响。最小化分类差异还可以提升分类模型的分类性能,因为它鼓励分类模型在多个分类器之间达成共识,从而得到更加准确的分类结果。

31、可选地,在第三训练和第四训练的步骤中,采用dropout算法,训练第一分类器和第二分类器。

32、通过采用上述技术方案,本技术采用dropout算法实现第一分类器和第二分类器对目标域数据的依赖,降低了过拟合的风险,使分类模型更有可能学习到目标域数据中的一般化特征,由于dropout算法是在训练过程中随机丢弃神经元,它迫使两个分类器学习到多个不同的特征组合来做出预测,增加了分类模型的多样性,并使其能够更好地处理未见过的数据。通过dropout算法训练的分类器对输入数据的微小变化更加鲁棒,因为分类器在训练时已经学会了在缺失部分信息的情况下进行预测。虽然dropout算法本身并不直接减少训练时间,但它通过减少过拟合,使得分类模型在更少的训练周期内就能达到更好的性能,从而间接地优化了训练时间。

33、可选地,在执行添加标签的步骤之后,执行再训练的步骤之前,还包括:

34、标签评估:包括获取类别中心、计算距离、阈值过滤和删除;

35、获取类别中心:获取第k类所包含全部样本的类别中心,记为第五数据,计算模型如下:

36、;

37、其中,为第k类所包含的全部样本的类别中心;为第k类中所有样本的数量;为第k类的第i个样本;

38、计算距离:计算第i个第三数据与第五数据的距离,计算模型如下:

39、;

40、其中,为第k类的特征空间的维度;为第i个第三数据的第j个特征值;

41、阈值过滤:判断距离是否大于预设阈值,若是,则执行删除的步骤;若否,则基于第i+1个第三数据,执行计算距离的步骤;

42、删除:将当前的类别标签删除,在选定的目标域数据中,将当前的类别标签所对应的目标域数据一并删除。

43、通过采用上述技术方案,本技术计算了每个类别的中心,有助于分类模型了解每个类别的典型特征,通过计算类别中心,可以获得每个类别的代表性特征,类别中心提供了类别内部数据分布的一个概览,有助于识别异常值或错误标签的数据点。本技术通过评估新添加的目标域数据与其被赋予的类别中心之间的距离,以判断标签的合理性,如果目标域数据与其类别中心的距离过大,意味着该数据点并不真正属于该类别,或者其标签被错误地分配了。通过计算距离,可以量化标签的合理性,并为后续的阈值过滤提供基础。通过设定一个合理的阈值,可以有效地识别并删除那些与类别中心距离过大、属于错误类别标签的数据点,有助于减少数据集中的噪声和错误,提高分类模型的训练效果和泛化能力。通过删除拥有错误类别标签的目标域数据,可以减少这些错误的目标域数据对分类模型训练产生负面影响,从而提高分类模型的性能和稳定性。

44、可选地,在执行删除的步骤之后,执行再训练的步骤之前还包括:

45、数据收集:收集被删除的目标域数据,并整理为数据集,记为第一数据集;

46、重新添加标签:将第一数据集中的目标域数据输入至再训练后的分类模型中,输出第一数据集中的目标域数据的类别标签,将第一数据集中的目标域数据的类别标签记为第六数据;

47、重新计算距离:计算第i个第六数据与第五数据的距离h,计算模型如下:

48、;

49、其中,为第k类的特征空间的维度;为第i个第六数据的第j个特征值;

50、判断距离:判断距离h是否大于预设阈值,若是,则执行再训练的步骤;若否,则基于第i+1个第六数据,执行重新计算距离的步骤。

51、通过采用上述技术方案,本技术将被删除的目标域数据收集在一起,并整理为数据集,并通过再训练后的分类模型重新添加标签,可以将错误的类别标签替换为正确的类别标签;重新添加标签后,重新计算目标域数据的类别标签与对应类别中心的距离,评估新的类别标签的合理性。如果目标域数据新的类别标签对应的类别中心距离较近,那么可以认为新的类别标签是合理的,进而验证了再训练的分类模型能够很好的应用在目标域数据的分类。反之,分类模型需要重新执行再训练的步骤,使其能够适应目标域数据的数据分布。

52、第二方面,本技术提供了一种基于深度学习的大数据信息处理系统,采用如下的技术方案:

53、一种基于深度学习的大数据信息处理系统,包括:

54、数据采集模块,用于分别采集源域数据和目标域数据,源域数据带有类别标签,目标域数据无类别标签;

55、建立模型模块,用于建立分类模型,所述分类模型包括:一个bert子模型、一个mlp子模型、第一分类器和第二分类器;

56、模型训练模块,与数据采集模块、建立模型模块通信连接,包括第一特征提取单元、第一训练单元、第二训练单元和求解均值单元;

57、第一特征提取单元,用于将源域数据输入至bert子模型,获得bert子模型的输出,将bert子模型的输出作为mlp子模型的输入,输出源域特征;

58、第一训练单元,用于将源域特征和对应的类别标签作为第一分类器的输入,获得第一分类器的输出数据;

59、第二训练单元,用于将源域特征和对应的类别标签作为第二分类器的输入,获得第二分类器的输出数据;

60、求解均值单元,用于计算第一分类器的输出数据和第二分类器的输出数据的均值,将所述的均值作为分类模型的输出数据;

61、分类模块,与模型训练模块和数据采集模块通信连接,用于将目标域数据输入至训练后的分类模型中,输出目标域数据的类别标签。

62、通过采用上述技术方案,本系统融合了数据采集、模型建立、模型训练与分类的各个环节,形成了一个高效的迁移学习框架。通过数据采集模块分别收集带有类别标签的源域数据和未标记的目标域数据,为后续模型训练提供了坚实的基础。在模型建立阶段,利用bert子模型强大的特征提取能力和mlp子模型的非线性变换特性,结合双分类器的设计,增强了分类模型的鲁棒性和多样性。模型训练模块通过并行训练两个分类器并计算其输出均值,有效融合了不同分类策略的优势,提高了分类的准确性和稳定性。最终,分类模块将训练好的模型应用于目标域数据,实现了高精度的类别标签预测,为实际应用提供了有力支持。

63、第三方面,本技术提供了一种计算机可读存储介质,其上存储有计算机程序,所述计算机程序在被处理器处理时,用于实现所述的方法。

64、第四方面,本技术提供了一种服务器,所述服务器上加载有所述的系统,所述服务器包括处理器,以及与所述处理器通信连接的存储器;

65、所述存储器内设置有计算机可读存储介质,所述计算机可读存储介质上存储有计算机程序;

66、所述处理器处理所述计算机可读存储介质上存储的计算机程序时,以实现所述的方法。

67、综上所述,本技术包括以下至少一种有益技术效果:

68、1、本技术设定了分类模型的结构,通过bert子模型和mlp子模型实现特征提取,并采用了两个分类器,第一分类器和第二分类器,两个分类器的性能是互补的,能够在分类时互补,并在最终输出时计算二者的均值,有助于减少单一分类器因为过度训练带来的偏差,降低领域偏移对分类结果的影响,提高分类模型的泛化能力和鲁棒性。在目标域数据没有标签的情况下,通过从源域学习到的知识和特征进行迁移,能够在一定程度上克服领域间的偏移,实现对目标域数据的分类。本技术通过bert子模型学习源域数据的特征,通过mlp子模型学习复杂的非线性变化,bert子模型提供了丰富的上下文表示,而mlp子模型则擅长从这些表示中提取和组合特征,二者的结合使得分类模型能够利用上下文信息的同时,还具备优异的特征提取能力,从而更好地应对领域偏移问题。

69、2、本技术选取了部分目标域数据,并对其添加类别标签,获得了第三数据(即目标域数据的类别标签),并采用目标域数据和第三数据对训练过的分类模型进行再训练,使分类模型进一步适应目标域的数据分布,提高在目标域上的分类性能。在添加标签的步骤中,本技术尽量保持各个类别的数据平衡,提高分类模型的泛化能力。再训练的步骤中,由于第一分类器和第二分类器的类别不同,能够增加分类模型的多样性,通过对比第三输出数据和第四输出数据的分布差异,可以评估不同分类器的性能,与模型训练的步骤相同,本技术可以通过求解第三输出数据和第四输出数据的均值,能够进一步降低单一分类器带来的领域偏差问题的发生概率,进一步提高分类模型的泛化能力和鲁棒性。

70、3、本技术将被删除的目标域数据收集在一起,并整理为数据集,并通过再训练后的分类模型重新添加标签,可以将错误的类别标签替换为正确的类别标签;重新添加标签后,重新计算目标域数据的类别标签与对应类别中心的距离,评估新的类别标签的合理性。如果目标域数据新的类别标签对应的类别中心距离较近,那么可以认为新的类别标签是合理的,进而验证了再训练的分类模型能够很好的应用在目标域数据的分类。反之,分类模型需要重新执行再训练的步骤,使其能够适应目标域数据的数据分布。

本文地址:https://www.jishuxx.com/zhuanli/20240929/311943.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。