一种基于视图依赖差异解耦的3D高斯溅射场景重建方法

- 国知局

- 2024-10-09 15:19:47

本发明涉及计算机视觉和计算机图形学,具体涉及一种基于视图依赖差异解耦的3d高斯溅射场景重建方法。

背景技术:

1、从稀疏图像集中重建场景一直是计算机视觉和计算机图形学中的一个长期焦点问题,对于增强现实(augmented reality,ar)和虚拟现实(virtual reality,vr)等众多应用来说尤为重要。传统技术以及最近的进展如神经辐射场(neural radiance field,nerf)和3d高斯溅射(3d gaussian splatting,3dgs)在场景重建方面取得了显著进展,尤其是3d高斯溅射在重建结果的清晰度和快速渲染速度方面表现尤为突出。然而,将基于3d高斯溅射的方法扩展到有效重建大规模真实场景仍然面临挑战。大规模场景数据,例如城市环境,通常表现出视图之间的外观变化,而不像假定恒定光照的物体中心重建那样。光照和大气条件的变化(例如亮度和颜色差异)会显著影响重建质量。由于3d高斯的插值能力有限,且3d高斯溅射在优化过程中旨在准确拟合每个训练视图,这可能会导致它在新视图中引入浮动伪影和不真实的几何形态。

2、近来一些研究通过将外观变化与基本场景表示进行解耦来解决上述挑战。tao lu等人提出的scaffold-gs是一个代表性例子,它使用锚点创建分层3d场景表示,基于锚点特征动态预测局部高斯的位置偏移和属性,适应不同的视角。尽管这种方法对外观不一致性表现出更强的鲁棒性,但在不同视角渲染时生成新高斯会阻碍其实现一致的3d几何和视图不变的场景颜色。受神经辐射场相关方法的启发,另一条研究路径是引入可学习的嵌入来捕捉视图间的外观变化。jiaqi lin等人提出vastgaussian,假设存在一种理想的一致颜色,并使用卷积神经网络(convolutional neural network,cnn)来拟合从重建的3d场景渲染的图像与实际图像之间的外观调整。尽管这种方法在推理过程中提供了一致的3d高斯表示,但在无约束的真实世界中,这种颜色调整非常复杂。即使光照变化相同,不同物体也会表现出不同的亮度变化。使用2d卷积神经网络学习这种图像级映射可能并不准确,并且优化过程可能具有挑战性。

技术实现思路

1、鉴于上述问题,本发明提供了一种基于视图依赖差异解耦的3d高斯溅射场景重建方法,解决了现有技术中场景重建时难以表示不同视图间的外观差异的问题。

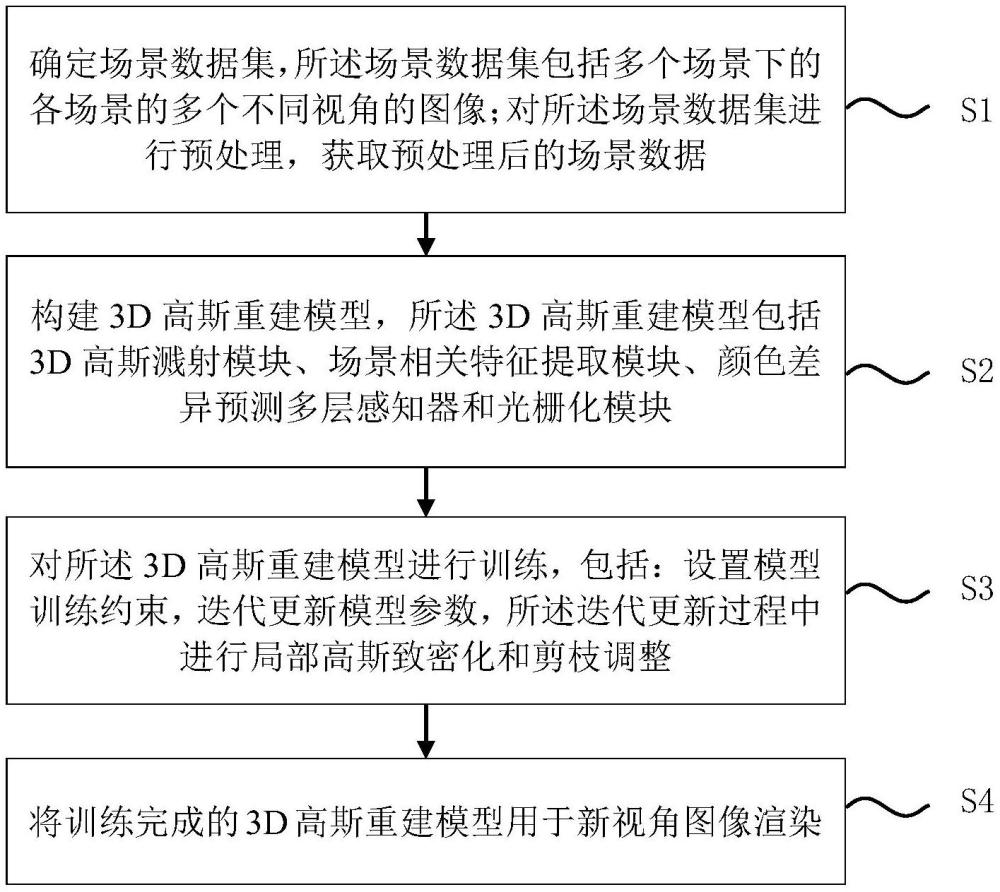

2、本发明提供了一种基于视图依赖差异解耦的3d高斯溅射场景重建方法,包括以下步骤:

3、步骤s1、确定场景数据集,所述场景数据集包括多个场景下的各场景的多个不同视角的图像;对所述场景数据集进行预处理,获取预处理后的场景数据;

4、步骤s2、构建3d高斯重建模型,所述3d高斯重建模型包括3d高斯溅射模块、场景相关特征提取模块、颜色差异预测多层感知器和光栅化模块;

5、步骤s3、对所述3d高斯重建模型进行训练,包括:设置模型训练约束,迭代更新模型参数,所述迭代更新过程中进行局部高斯致密化和剪枝调整;

6、步骤s4、将训练完成的3d高斯重建模型用于新视角图像渲染。

7、优选地,步骤s1中对所述场景数据集进行预处理包括:对场景数据集中各场景的图像,通过colmap对图像进行特征提取、特征匹配以及生成初始3d点云,将3d点云与相机姿态一同优化,最终获得所述多幅图像中各幅图像的相机姿态的估计量和各场景的初始化稀疏点云。

8、优选地,所述3d高斯溅射模块对所述相机姿态的估计量和所述初始化稀疏点云进行3d高斯溅射处理,获取各3d高斯块的一致性颜色;

9、所述场景相关特征提取模块获取场景特定网格特征和视图相关的光照嵌入,基于所述场景特定网格特征和所述视图相关的光照嵌入,采用所述颜色差异预测多层感知器对各3d高斯块的颜色差异进行预测,获取各3d高斯块的颜色差异预测量;

10、将所述各3d高斯块的颜色差异预测量与所述各3d高斯块的一致性颜色相加,获取各3d高斯块的最终颜色后,所述光栅化模块将各3d高斯块的一致性颜色进行光栅化渲染,得到一致性颜色渲染图,将各3d高斯块的最终颜色进行光栅化渲染,得到最终颜色渲染图。

11、优选地,所述获取各3d高斯块的颜色差异预测量的方式具体包括:

12、(1)获取场景特定网格特征,具体包括:通过网格的方式确定张量g(s),其中表示各维度均为实数,x,y,z表示特征网格的三个空间维度的尺寸,n(s)表示特征长度;对于每个通道r∈n(s),将张量g(s)分解为三个向量和三个矩阵:将通道的向量和矩阵组件进行串联:

13、

14、其中,表示在n(s)维度上的串联操作,表示外积,表示网格分辨率m下的场景网格特征,将不同尺度下的多分辨率的场景网格特征的集合确定为场景特征即

15、最后,将场景特征在位置x处三线性插值量确定为场景特定网格特征,其中表示3维实数域;

16、(2)获取视图相关的光照嵌入,将视图相关的光照嵌入设置为1xn(l)的向量,n(l)为向量长度;

17、(3)将所述场景特定网格特征和所述视图相关的光照嵌入输入颜色差异预测多层感知器,进行前向传播计算,获得输出各3d高斯块的颜色差异预测量;所述颜色差异预测多层感知器由多个全连接层结构组成,每层包含若干神经元。

18、优选地,步骤s3具体包括:

19、步骤s3-1、对所述3d高斯重建模型,设置模型的损失函数,所述损失函数包含重建损失、图像质量损失和尺度正则化损失;

20、步骤s3-2、基于所述损失函数值的梯度,采用反向传播算法,对3d高斯重建模型进行参数迭代更新;

21、步骤s3-3、在迭代过程中,每当经过预定的迭代更新次数时,基于局部高斯优化策略进行局部高斯致密化和剪枝调整;

22、步骤s3-4、当模型损失函数值趋于收敛时,结束迭代更新。

23、优选地,步骤s3-1具体包括:

24、3d高斯重建模型的损失函数表示为:

25、

26、其中,λssim为图像质量损失权重系数,λscal为尺度正则化损失权重系数,为重建损失,计算方式为真实图像igt与最终颜色渲染图if之间的距离;为图像质量损失,计算方式为真实图像igt与一致性颜色渲染图ic之间的ssim损失;为尺度正则化损失,计算方式为:

27、

28、其中,i为高斯块索引,si为第i个高斯块的尺度,mask(si,η)表示对si进行阈值为η的硬掩码,值大于η的部分保持不变,值小于或等于η的部分变为0;mean(·)和prod(·)分别表示向量的平均值和乘积。

29、优选地,步骤s3-2具体包括:

30、对所述3d高斯溅射模块的参数、所述场景特定网格特征、所述视图相关的光照嵌入和所述颜色差异预测多层感知器的参数进行迭代更新。

31、优选地,步骤s3-3具体包括:

32、(1)进行局部高斯构建,将三维空间划分为多个离散的立方体作为体素;在每个体素内的高斯块作为局部进行处理,处理方式为:

33、

34、其中v表示体素中心,∈代表体素大小,表示去除重复的体素中心,整个公式表示将高斯分布的均值μ映射到唯一的最近的体素中心;

35、(2)进行局部高斯的致密化和剪枝调整处理,处理方式为:

36、

37、其中,αv分别为体素的视图空间位置梯度平均值和不透明度,τg,τ′g分别为高斯块分裂的预设阈值和最终阈值,τv为体素局部分裂调整阈值,γg,γ′g分别为高斯不透明度的预设阈值和最终阈值,γv为体素局部剪枝调整阈值,||·||2为l2范数;

38、(3)进行局部高斯几何约束处理,处理方式为:

39、

40、其中,分别为迭代中优化的梯度和最终确定的梯度,dg为各高斯块与初始位置的偏移量,dv为体素内高斯位置的平均偏移。

41、优选地,对于所述场景数据集,将场景数据集中的图像划分为训练集和测试集,使用训练集中的数据进行训练,训练结束后,使用测试集中的数据对模型进行评估。

42、与现有技术相比,本发明至少具有如下有益效果:

43、(1)本发明提出的基于视图依赖差异解耦的3d高斯溅射场景重建方法,弥补了现有算法对于现实世界大场景不一致的颜色外观建模不充分的缺陷,提高了基于3d高斯在现实世界大场景重建的效果。

44、(2)本发明提供的方案中通过进行局部高斯优化策略,解决了在新视图中的伪影与漂浮物的问题。局部高斯优化策略考虑了几何约束的局部上下文,并相应地调整优化过程,从而实现更一致和更准确的3d场景重建。

45、(3)本发明提出的基于视图依赖差异解耦的3d高斯溅射场景重建方法可以有效地应用到现有的基于3d高斯的最先进方法上,适用范围更广。

本文地址:https://www.jishuxx.com/zhuanli/20241009/308359.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表