一种安全驾驶的人机多模态交互特征表达方法

- 国知局

- 2024-11-21 11:55:40

本发明属于自动驾驶及人工智能车联网信息感知,具体涉及一种安全驾驶的人机多模态交互特征表达方法。

背景技术:

0、技术背景

1、根据美国汽车工程师学会(sae)制定的分类标准,自动驾驶车辆目前还处于条件自动化(l3)级,在部分或有条件自动驾驶车辆中仍需驾驶员及时接管车辆,如何让驾驶员在较短时间内(10-15s内)响应自动驾驶系统的接管提醒和实现控制权的平稳过渡一直是自动驾驶车辆亟待解决的关键问题。但l3级别自动驾驶的车辆长时间自动驾驶过程中,驾驶员容易疲劳,在此情况下,若自动驾驶过程中出现紧急情况需要驾驶员接管时,驾驶员由于处于疲劳状态,难以恢复到可迅速接管车辆的状态,此时若未接管车辆,或在疲劳状态下接管车辆都会造成行车危险。接管请求及控制权切换是自动驾驶车辆关键核心技术,目前对于控制权切换的研究仍未很好地提升接管质量,车辆的接管控制仍有较大的发展空间。

技术实现思路

1、为了克服上述现有技术中的不足,本发明提供了一种安全驾驶的人机多模态交互特征表达方法,短时间内提升驾驶员认知情况以便安全平稳接管车辆。

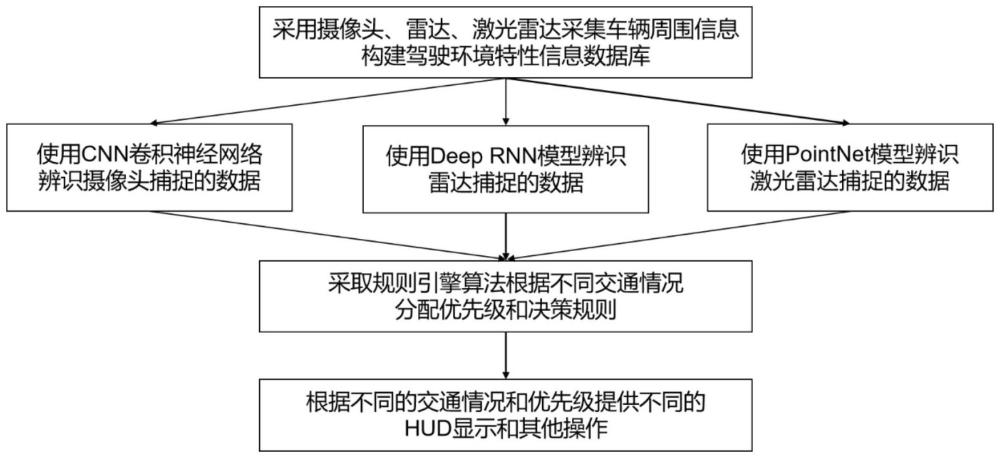

2、本发明的技术方案为:一种安全驾驶的人机多模交互特征表达方法,包括以下步骤:

3、步骤1,选取多种传感设备采集信息,构建驾驶环境特性信息数据库;

4、步骤2,根据构建的信息数据库,结合cnn、deep rnn、pointnet模型,实时辨识交通环境,触发交通安全接管请求;

5、步骤3,根据不同的交通环境,结合规则引擎算法,提供不同的决策建议;

6、步骤4,根据不同的决策建议,向驾驶员提供不同的hud显示。

7、进一步,步骤1具体过程为:

8、首先,利用摄像头、雷达和激光雷达收集到的数据创建驾驶环境特征信息数据库;

9、摄像头以视频流形式收集数据,摄像头应安装在车辆前方,以覆盖前方道路和交通状况,摄像头的视野应足够宽,以覆盖整个车道和周围环境,收集的信息包括以下内容:

10、路径宽度:摄像机获取路径两侧的边界线,并根据像素尺寸和摄像机视角计算路径宽度;

11、车道线:利用图像处理技术检测图像中的车道线,并提取其位置和属性;

12、路面状况:利用图像分割和特征提取技术分析路面的颜色、纹理和形状,以确定路面是否平整干燥;

13、交通标志:使用目标检测和分类算法对图像中的交通标志进行识别和分类,如限速标志和来车标志;

14、交通信号:检测图像中交通信号的状态:红色、绿色、黄色,以及交通信号的位置和方向;

15、设置如下的参数变量:

16、摄像头的安装位置坐标(x1,y1,z1);

17、水平视野角度(horizontal_view_angle);

18、垂直视野角度(vertical_view_angle);

19、数据采集频率(fps);

20、曝光时间(exposure_time);

21、对焦距离(focus_distance);

22、雷达以雷达波束的形式收集数据,雷达波束安装在车辆前部、后部和中部,覆盖车辆周边;雷达用于收集这些数据:

23、车辆轨迹:雷达波束的数据用于获取周围车辆的距离、速度和方向,以跟踪车辆轨迹;

24、行人活动:雷达探测附近行人的存在和移动,并提供其相对位置和速度的信息;

25、设置如下的参数变量:

26、并设置如下的参数变量:

27、雷达的安装位置坐标(x2,y2,z2);

28、雷达水平扫描角度(radar_horizontal_scanning_angle);

29、雷达垂直扫描角度(radar_vertical_scanning_angle);

30、雷达扫描频率(radar_scanning_frequency);

31、雷达最大测量范围(maximum_radar_measuring_range);

32、雷达最小测量范围(minimum_radar_measuring_range);

33、激光雷达系统以点云数据的形式收集数据,激光雷达安装在车辆顶部,用于获取车辆周围环境的3d地图和障碍物信息;使用激光雷达可收集以下数据:

34、路面曲率:点云数据用于获取道路几何形状并计算路面曲率,从而确定路面的弯曲程度;

35、施工区:点云数据用于检测道路上的障碍物或施工标记,以确定施工区域;

36、行人活动:激光雷达可提供高分辨率点云数据,帮助确定行人交通的位置和路径;

37、设置如下的参数变量:

38、激光雷达的安装位置坐标(x3,y3,z3);

39、雷达水平扫描角度(lidar_horizontal_scanning_angle);

40、雷达垂直扫描角度(lidar_vertical_scanning_angle);

41、雷达扫描频率(lidar_scanning_frequency);

42、雷达最大测量范围(maximum_lidar_measuring_range);

43、雷达最小测量范围(minimum_lidar_measuring_range)。

44、进一步,步骤2具体过程为:

45、首先,使用cnn解卷积神经网络处理摄像头数据;其输入层为rgb图像,摄像头拍摄的图像大小为224×224×3;解卷积层分为三层,第一解卷积层:64个卷积核3×33×3,步长为1,使用relu激活函数;第二卷积层:128个卷积核3×33×3,步长为1,使用relu激活函数;第三卷积层:256个卷积核3×33×3,步长为1,使用relu激活函数:256个卷积核3×33×3卷积核,步长为1,使用relu激活函数;集合层:每个全连接卷积层之后都有一个2×2最大聚类层,用于减小特征图的大小;全连接层分为两层:第一层使用relu激活函数与1024个神经元全连接;第二层使用relu激活函数与512个神经元全连接;第三层使用relu激活函数与512个神经元全连接。第二层使用relu激活函数与512个神经元完全连接;输出层:根据任务需要,为输出分配不同数量的神经元,并使用softmax激活函数将输出转化为概率分布,用于多类分类;

46、接着,使用deep rnn模型处理雷达数据;其输入层为每个时间步x(t)的输入数据;deep rnn模型包含多个循环神经网络rnn层,用于处理时间序列数据;我们使用长短期记忆网络lstm作为rnn单元,模型的隐藏状态h(t)和记忆状态c(t)在每个时间步更新如下:

47、h(t),c(t)=lstm(x(t),h(t-1),c(t-1))

48、其中,h(t-1)和c(t-1)是上一个时间步的隐藏状态和记忆状态;

49、然后将每个时间步的隐藏状态h(t)输入到输出层,以得到对目标物体的预测结果y(t)。它的预测结果的计算公式如下:

50、y(t)=outputlayer(h(t))

51、其中,输出层outputlayer为一个全连接层,用于将隐藏状态映射到预测结果的空间;

52、最后,pointnet模型用于处理激光雷达采集的点云数据;x={x_1,x_2,…,x_n}代表点云数据集,其中n代表点的数量,x_i中的i代表第i个点的特征向量;pointnet模型的设置如下:输入层:x点云数据将作为输入;pointnet模型将首先对每个点的特征进行编码,使用多层感知器(mlp)捕捉每个点的全局特征的点云数据,mlp的输出将作为每个点的局部特征,并对每个点的全局特征进行编码;

53、fmlp(xi)=relu(w1xi+b1)

54、其中,是w1和b1是mlp的权重系数和偏置参数;

55、接下来,对点云中的所有点的局部特征进行汇聚,对所有点的特征进行求和,以获得整个点云数据的全局特征表示,求和操作表示为:

56、

57、最后,将全局特征表示输入到分类器或分割器中,以进行点云的分类任务,分类器选用全连接神经网络,用于将全局特征映射到类别空间。

58、进一步,步骤3具体过程为:

59、根据不同的交通环境,利用规则引擎算法进行决策,具体优先级及决策规则如下:

60、紧急制动规则(高优先级):如果雷达数据检测到前方距离小于安全距离,则执行紧急制动;

61、行人避让规则(高优先级):如果摄像头数据检测到行人正在横穿马路,且雷达数据确认行人距离车辆很近,则执行行人避让;

62、车道保持规则(中优先级):如果摄像头数据检测到车辆偏离当前车道,且没有障碍物威胁,则执行车道保持操作,使车辆回到中央车道;

63、限速规则(中等优先级):摄像头数据可识别交通信号并显示道路上的当前限速,然后踩下刹车以遵守限速规定;

64、障碍物警告规则(中等优先级):雷达数据检测到前方有障碍物,但距离足够远,可避免紧急制动,并向驾驶员显示前方有障碍物的警告;

65、车距控制(中等优先级):当雷达数据检测到前方车辆与当前车辆的距离很近时,会控制车速以保持安全距离;

66、转弯警告规则(中优先级):当摄像头数据检测到交叉路口且导航系统显示即将转弯时,会在转弯时向驾驶员发出警告;

67、交通信号灯警告规则(低优先级):如果摄像头数据识别到交通信号灯变化情况(从红灯变为绿灯),则会向驾驶员显示交通信号灯警告;

68、前方车辆变道警告规则(低优先级):如果雷达数据检测到前方车辆正在变道,并可能影响当前车辆的车道,则会向驾驶员显示变道警告;

69、自适应巡航控制系统规则(低优先级):导航系统显示车辆即将进入高速公路,并启用自适应巡航控制系统;

70、驾驶员疲劳提醒规则(低优先级):如果摄像头数据检测到驾驶员面部表情疲劳或眼睛频繁闭合,则会向驾驶员发送疲劳提醒;

71、后方交通警报(低优先级):如果后雷达数据在车辆倒车时检测到障碍物,则会在倒车时向驾驶员发送警告信息;

72、远光灯控制规则(低优先级):如果摄像头数据检测到车辆在夜间环境中行驶,且没有迎面而来的车辆,则启用远光灯系统。

73、进一步,步骤4具体过程为:

74、首先,根据决策向驾驶员提供不同的hud操作显示:

75、1.紧急刹车规则

76、规则条件:dfront<dsafe

77、操作部分:brake():紧急刹车操作

78、hud操作显示:紧急刹车

79、条件部分:dfront:前方障碍物距离;dsafe:安全车距阈值

80、2.避让行人规则

81、规则条件:dpedestrian<dp_safe

82、操作部分:avoid_pedestrian():避让行人操作

83、hud操作显示:避让行人

84、条件部分:dpedestrian:行人与车辆的距离;dp_safe:安全避让距离阈值

85、3.车道保持规则

86、规则条件:|θlane|>θsafe

87、操作部分:lane_keeping():车道保持操作

88、hud操作显示:车道保持

89、条件部分:θlane:车辆偏离当前车道的角度;θsafe:安全车道偏离角度阈值

90、4.限速规则

91、规则条件:vcurrent>vlimit

92、操作部分:adjust_speed():刹车操作

93、hud操作显示:刹车操作

94、条件部分:vcurrent:当前车速,vlimit:当前道路限速

95、5.前方障碍物警示规则

96、规则条件:dfront<dalert

97、操作部分:display_warning():显示警示信息操作

98、hud操作显示:注意前方障碍物

99、条件部分:dfront:前方障碍物距离,dalert:警示距离阈值

100、6.车辆间距控制规则

101、规则条件:dfront_vehicle<dsafe

102、操作部分:control_distance():刹车操作

103、hud操作显示:注意控制车距

104、条件部分:dfront_vehicle:前方车辆与当前车辆的距离,dsafe:安全车距阈值

105、7.转弯警示规则

106、规则条件:intersection=true且turn_signal=none

107、操作部分:display_turn_warning():显示转弯警示信息操作

108、hud操作显示:转弯警示

109、条件部分:intersection:是否处于交叉口,turn_signal:转向灯状态

110、8.交通信号警示规则

111、规则条件:traffic_light_state=red

112、操作部分:display_traffic_light_warning():显示交通信号警示信息操作hud操作显示:交通信号警示

113、条件部分:traffic_light_state:交通信号灯状态

114、9.前方车辆变道警示规则

115、规则条件:front_vehicle_change_lane=true

116、且front_vehicle_change_lane_threat=high

117、操作部分:display_front_vehicle_change_lane_warning():显示前方车辆变道警示信息操作

118、hud操作显示:前方车辆变道

119、条件部分:front_vehicle_change_lane:前方车辆是否正在变道,front_vehicle_change_lane_threat:前方车辆变道对当前车辆的威胁程度

120、10.自适应巡航规则

121、规则条件:is_highway=true

122、操作部分:activate_highway_cruise_control():激活高速公路巡航控制操作

123、hud操作显示:自适应巡航

124、条件部分:is_highway:当前道路是否为高速公路

125、11.驾驶员疲劳提醒规则

126、规则条件:is_driver_fatigued=true

127、操作部分:display_fatigue_warning():显示疲劳提醒信息操作

128、hud操作显示:疲劳驾驶

129、条件部分:is_driver_fatigued:驾驶员是否处于疲劳状态

130、12.倒车警示规则

131、规则条件:drear<dalert

132、操作部分:display_reverse_warning():显示倒车警示信息操作

133、hud操作显示:倒车警示

134、条件部分:drear:后方障碍物距离,dalert:警示距离阈值

135、13.远光灯控制规则

136、规则条件:is_night=true

137、操作部分:activate_high_beam():激活远光灯操作

138、hud操作显示:激活远光灯

139、条件部分:is_night:当前是否为夜间驾驶

140、有益效果:将cnn、deep rnn、pointnet和规则引擎集成在一起可以解决自动驾驶系统中的多个技术问题,cnn、deep rnn和pointnet分别擅长处理图像、序列数据和点云数据,将它们结合在一起,可以提高自动驾驶系统的感知能力;cnn可以处理摄像头数据,deeprnn深度网络可以处理雷达数据,pointnet可以处理激光雷达数据,从而全面感知车辆周围的环境;自动驾驶系统需要在复杂的道路场景中行驶,包括城市道路、高速公路和建筑区。通过结合cnn、deep rnn和pointnet,可以更好地理解和分析各种复杂场景,并做出相应的驾驶决策;规则引擎可以提供基于先验知识和规则的决策能力,通过结合cnn、deep rnn和pointnet提供的感知能力,可以实现智能驾驶决策。自动驾驶系统在实际驾驶中会面临各种不确定因素,如天气变化、路况变化、其他车辆和行人的突然移动等。通过集成cnn、deeprnn和pointnet,系统可以更好地应对不确定性,提高系统的鲁棒性和安全性。

141、将cnn、deep rnn、pointnet和规则引擎结合,综合考虑上述规则的优先级和各个传感器响应速度相适应,提高了自动驾驶自主决策的安全性。

本文地址:https://www.jishuxx.com/zhuanli/20241120/333440.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表