一种用于视网膜色素变性分级的类别注意力网络构建方法

- 国知局

- 2024-12-06 12:51:57

本发明涉及图像处理,尤其涉及一种用于视网膜色素变性分级的类别注意力网络构建方法。

背景技术:

1、视网膜色素变性(retinitis pigmentosa,rp)是一种罕见的遗传性眼科疾病。视网膜色素变性主要由与光感受器相关的基因突变导致,受影响的感光细胞逐渐退化,进而导致视力障碍甚至失明。随着社会老龄化的加剧和遗传疾病研究的深入,视网膜色素变性相关的失明病例数量在全球范围内显著增加。在眼科领域,眼底彩照(color fundusphotography,cfp)是一种广泛使用的诊断技术。眼底彩照技术通过无创拍摄高分辨率的眼底彩色图像,帮助临床医生观察视网膜、视神经盘、黄斑及血管的细节变化,便于早期发现和管理各种眼科疾病,尤其在视网膜色素变性分级诊断中,具有重要作用。眼底彩照技术成本效益高,操作便捷,已被广泛应用于眼科疾病的筛查和诊断。医生通过观察视网膜色素沉积、血管结构和视神经盘的变化特征,确定视网膜色素变性的分期和病情发展,但仅依赖于医生的主观判断,使得对视网膜色素变性级别的判断存在一定的误差和不确定性。

2、近年来,基于深度学习(deep learning,dl)的方法广泛应用于医学影像处理与分析领域,卷积神经网络(convolutional neural network,cnn)和transformer在许多医学影像处理与分析任务中展现了巨大的应用潜力。随着这些技术的发展,医学影像处理与分析的准确性和效率得到了显著提高,它们在提高图像处理、分类、分割等任务的准确性和效率方面展现出巨大的潜力,推动了医学影像分析向自动化和智能化发展。通过这些技术,研究人员能够利用大规模的医学图像数据进行分析,极大地提升了眼科疾病的筛查与诊断效率。

3、尽管深度学习技术在多个医学领域中取得了巨大进展,但在视网膜色素变性自动分级方面的应用还处于相对初步的阶段。一方面,现有的自动化模型多基于大规模数据集进行训练,然而,由于视网膜色素变性是一种罕见病,相关的高质量数据集较为稀缺,由于数据量的限制,现有深度学习模型在训练过程中容易出现过拟合,进而影响模型的泛化能力,这使得模型在面对不同特征和不同类型的患者时表现不够稳定,导致模型的开发和优化面临挑战;另一方面,视网膜色素变性的不同分级在眼底彩照上表现出的特征差异明显,但类别分布极不均衡,由于中晚期视网膜色素变性患者的图像较少,现有模型在训练过程中往往过度学习样本量较大的类别特征,忽略了样本较少的类别,这种不平衡的数据分布问题使得模型在处理实际场景中的分级任务时,准确率受到很大影响,难以兼顾各个分级的表现,导致分级精度不高,难以充分适应不同阶段的视网膜色素变性患者;此外,医学影像分析领域对模型的实时性和部署灵活性有很高的要求,特别是在硬件资源受限的医疗设备中。现有的深度学习模型,尤其是大型卷积神经网络(convolutional neural network,cnn)或transformer模型,尽管在精度上表现出色,但由于其计算复杂度较高,无法直接在资源受限的设备上高效运行。因此,如何在保持模型准确性的前提下实现轻量化,是现有技术面临的一大挑战。

技术实现思路

1、为此,本发明所要解决的技术问题在于克服现有的视网膜色素变性数据集稀缺、类别不平衡以及视网膜色素变性模型无法直接在资源受限的设备上高效运行的缺陷。

2、为解决上述技术问题,本发明提供了一种用于视网膜色素变性分级的类别注意力网络构建方法,包括以下步骤:

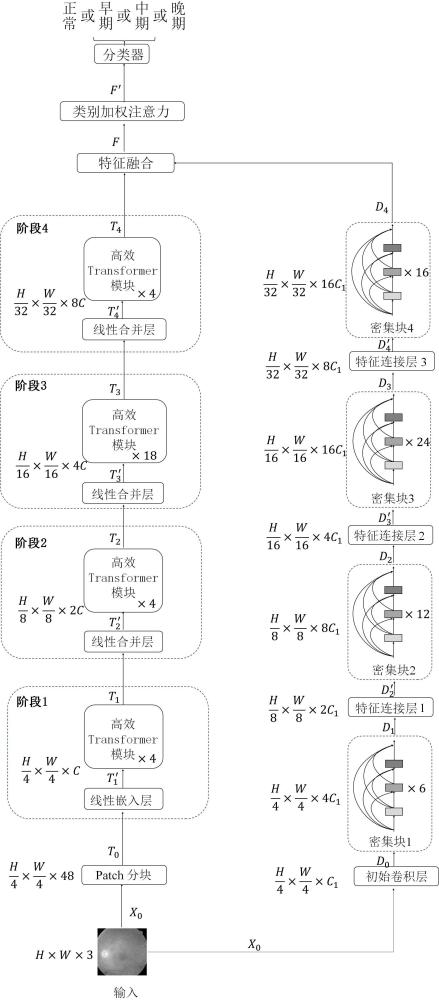

3、构建视网膜色素变性类别注意力网络,所述视网膜色素变性类别注意力网络包括:两条并行分支、类别加权注意力模块与分类器;两条并行分支包括:高效自注意力transformer支路与局部特征提取支路;

4、将眼底彩照图像输入高效自注意力transformer支路,捕捉全局信息,得到高效自注意力transformer支路的输出特征;

5、将眼底彩照图像输入局部特征提取支路,提取局部信息,得到局部特征提取支路的输出特征;

6、将高效自注意力transformer支路的输出特征与局部特征提取支路的输出特征沿通道维度进行拼接,得到融合特征;

7、将融合特征通过类别加权注意力模块,对不同类别分配不同权重,得到加权后的输出特征,包括:

8、将融合特征通过全局特征提取组件,提取通道权重和空间注意力权重,得到全局特征;

9、将全局特征通过类别加权组件,为每个类别分配独立的权重,得到加权后的输出特征,包括:

10、将全局特征经过1×1卷积层处理,将全局特征的通道数调整为;

11、将通道数调整后的特征图划分为个类别特征图,并计算每个类别特征图的权重得分,其中,为视网膜色素变性类别数,为每个类别特征图的通道数;

12、对个类别特征图分别进行平均池化,得到每个类别特征图对应的语义特征图;

13、将每个类别特征图的权重分数与其对应的语义特征图进行加权平均,得到类别加权注意力矩阵;

14、将全局特征与类别加权注意力矩阵逐元素相乘,得到加权后的输出特征;

15、将加权后的输出特征通过分类器,输出视网膜色素变性分级预测结果。

16、优选地,高效自注意力transformer支路包括:沿正向传播方向串联的一个patch分块模块、多个特征提取模块,其中,第一个特征提取模块包括:依次连接的一个线性嵌入层与一个高效transformer模块,除第一个特征提取模块外的其他特征提取模块均包括依次连接的一个线性合并层与一个高效transformer模块;

17、其中,通过将视觉转换器vit中的全局多头注意力机制替换为高效自注意机制,得到高效transformer模块,包括:沿正向传播方向依次连接的深度卷积层、层归一化、高效自注意力机制、层归一化、全连接层,将深度卷积层输出的特征与高效自注意力机制的输出特征进行残差连接。

18、优选地,所述将眼底彩照图像输入高效自注意力transformer支路,捕捉全局信息,得到高效自注意力transformer支路的输出特征,包括:

19、将眼底彩照图像通过patch分块模块进行分块处理,得到多个相同大小的特征图;

20、将每个特征图分别转化为其对应的一维序列后,将所有一维序列拼接得到第一特征提取模块的输入序列;

21、将第一特征提取模块的输入序列经过第一特征提取模块的线性嵌入层升维后,通过第一特征提取模块的高效transformer模块,提取第一输出特征;

22、将第一输出特征经过第二特征提取模块的线性合并层进行线性变换后,通过第二特征提取模块的高效transformer模块,捕捉全局信息,得到第二输出特征,并将第二输出特征作为下一特征提取模块的输入;

23、将最后一个特征提取模块的输出特征作为高效自注意力transformer支路的输出特征。

24、优选地,将高效transformer模块输入特征通过高效transformer模块,调整注意力权重,得到高效transformer模块输出特征,包括:

25、将高效transformer模块输入特征经过深度卷积层、层归一化处理后,通过高效自注意力机制处理,得到高效自注意力机制的输出特征,包括:

26、将层归一化处理后的特征图通过reshape操作进行重塑,得到重塑后的特征,其中,重塑后的特征包括个patch块,为层归一化处理后的特征图在高度或宽度上分成的patch块数量;

27、将重塑后的特征分别与三个不同线性投影层相乘,得到查询向量、键向量与值向量;

28、分别对查询向量、键向量中每个patch块进行平均操作,得到查询向量的平均特征、键向量的平均特征;

29、对查询向量的平均特征、键向量的平均特征进行注意力分数计算,得到特征关联图;

30、将特征关联图通过topk算法对特征进行选择,得到稀疏索引矩阵;

31、将键向量、值向量分别与稀疏索引矩阵进行合并,得到合并后的键向量与值向量;

32、将查询向量与合并后的键向量进行点积计算相似度后,将相似度除以键向量的维度的平方根,得到注意力权重;

33、将注意力权重通过softmax 操作进行归一化,得到注意力权重矩阵;

34、根据注意力权重矩阵对值向量加权求和,得到高效自注意力机制的输出特征;

35、将高效自注意力机制的输出特征与深度卷积层输出的特征进行残差连接后,依次经过层归一化、全连接层处理,得到高效transformer模块输出特征。

36、优选地,所述将融合特征通过全局特征提取组件,提取通道权重和空间注意力权重,得到全局特征,包括:

37、将融合特征通过通道加权单元,提取通道权重,得到中间特征图;

38、将中间特征图通过空间加权单元,提取空间注意力权重,得到全局特征。

39、优选地,所述将融合特征通过全局特征提取组件,提取通道权重和空间注意力权重,得到全局特征,包括:

40、通过全局平均池化操作对融合特征进行通道压缩,得到池化后的特征;

41、将池化后的特征经过1×1卷积核的卷积层后,通过sigmoid激活函数,得到通道权重;

42、将通道权重与融合特征逐元素相乘,得到中间特征图;

43、对中间特征图沿通道方向进行平均池化后,通过sigmoid激活函数,得到空间注意力权重;

44、将空间注意力权重与中间特征图逐元素相乘,得到全局特征。

45、优选地,所述将通道数调整后的特征图划分为个类别特征图,并计算每个类别特征图的权重得分,计算公式为:

46、,

47、所述对个类别特征图分别进行平均池化,得到每个类别特征图对应的语义特征图,计算公式为:

48、,

49、所述将每个类别特征图的权重分数与其对应的语义特征图进行加权平均,得到类别加权注意力矩阵,计算公式为:

50、,

51、所述将全局特征与类别加权注意力矩阵逐元素相乘,得到加权后的输出特征,计算公式为:

52、,

53、其中,表示第个类别特征图的权重得分,表示每个类别特征图的通道数,表示全局最大池化,表示第个类别特征图中第个通道的值,表示第个类别特征图对应的语义特征图,表示类别加权注意力矩阵,表示加权后的输出特征,表示全局特征,表示逐元素相乘。

54、优选地,局部特征提取支路为mobilenet卷积支路、googlenet卷积支路、densenet121卷积支路中任意一种。

55、优选地,将眼底彩照图像输入densenet121卷积支路,提取局部信息,得到densenet121卷积支路的输出特征;

56、其中,densenet121卷积支路包括:初始卷积层与个不同卷积层的密集块、个特征连接层,每个特征连接层均包括依次连接的1x1卷积与2x2平均池化层。

57、优选地,视网膜色素变性类别注意力网络的训练过程为:

58、获取眼底彩照数据集,对眼底彩照数据集数据扩增后,进行预处理,将预处理后的眼底彩照数据集划分为训练集、验证集和测试集;

59、利用训练集对视网膜色素变性类别注意力网络进行训练,并采用累进编码策略构建总损失函数对视网膜色素变性类别注意力网络进行优化,总损失函数包括:标准编码的损失函数与累进编码采用的累进损失函数;通过验证集对训练后的视网膜色素变性类别注意力网络进行验证,得到目标视网膜色素变性类别注意力网络;

60、总损失函数的公式为:

61、,

62、,

63、,

64、其中,表示总损失函数,表示标准编码的损失函数,表示累进编码采用的累进损失函数,表示当前批次的样本总数,表示第个样本的真实标签的one-hot编码,若第个样本属于第个视网膜色素变性类别,则为1,否则为0,表示视网膜色素变性类别注意力网络预测第个样本属于第个视网膜色素变性类别的概率,表示第个样本的累进编码标签。

65、本发明的上述技术方案相比现有技术具有以下有益效果:

66、本发明所述的一种用于视网膜色素变性分级的类别注意力网络构建方法,通过将高效自注意力transformer支路的输出特征与局部特征提取支路的输出特征沿通道维度进行拼接,得到融合特征;融合特征通过类别加权注意力模块的全局特征提取组件,提取通道权重和空间注意力权重,得到全局特征;将全局特征通过类别加权注意力模块的类别加权组件,为每个类别分配独立的权重,得到加权后的输出特征,加权后的输出特征通过分类器,输出视网膜色素变性分级预测结果。类别加权注意力模块通过提取通道权重和空间注意力权重,能够整合融合特征的全局信息,通过为全局特征中每个类别分配不同的权重,确保了视网膜色素变性类别注意力网络能够对不同类别的样本均衡关注,而不受样本数量的影响,提高了类别注意力网络对样本量较少的类别特征的识别能力。

67、此外,高效自注意力transformer支路通过patch分块模块对眼底彩照图像进行分块处理,便于后续的特征提取和学习,并通过多个特征提取模块,降低图像的空间分辨率,同时提取更加丰富的特征信息,逐步提升模型的特征提取能力,得到高效自注意力transformer支路的输出特征;高效自注意力transformer支路通过改进的高效自注意力机制,在保留视网膜色素变性类别注意力网络高准确率的同时,显著减少了视网膜色素变性类别注意力网络的参数量和计算量,保证了视网膜色素变性类别注意力网络的轻量化与高性能。

本文地址:https://www.jishuxx.com/zhuanli/20241204/342861.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表