一种基于多密钥同态加密和拉普拉斯差分的农业保险数据隐私保护方法

- 国知局

- 2025-01-10 13:31:22

本发明属于网络空间安全数据隐私保护,特别是涉及一种基于多密钥同态加密和拉普拉斯差分的农业保险数据隐私保护方法。

背景技术:

1、现如今,随着人工智能技术的逐渐发展,人工智能科技几乎在各行各业中大显身手,如2016年alphago在世界象棋比赛中打倒了人类所有的顶尖棋手,人类期待着类似于alphago这样的大数据驱动的人工智能技术尽早地在人们日常生活中显现。但是,现实世界的实际情况却令人有些沮丧:大部分的领域都只是有限的数据或质量不好的数据,这使得人工智能技术的实现远比人们所想象的要艰难的多,而传统的机器学习需要大量的数据来用于模型训练,这些数据中可能包含有用户的隐私数据,而隐私数据的泄漏会给用户带来极大的威胁,比如在医疗方面病人的患病历史、保险方面用户的收入等等,这使得用户不愿分享数据。同时,在各企业之间存在业务竞争等,各方也不愿意分享自身收集来的数据,这些因素导致了数据源之间存在壁垒,使得数据无法互通,导致在现如今大部分领域中的数据往往以孤岛的形态出现,产生了数据孤岛的现状与如今数据融合需求之间的矛盾,并且该种矛盾日益凸显。

2、而为了实现数据的安全共享且不会被对方查看到数据,和解决“数据孤岛”问题,技术人员提出了联邦学习技术(federated machine learning/federated learning),联邦学习是一种分布式学习算法,该技术不共享本地所存储的数据,而是分享其本地训练的模型参数。这使得各参与方在保证数据不出本地的前提下能够多方协同训练模型,帮助用户、企业、部门能够在不泄漏自身隐私数据的前提下,有效进行机器学习模型的训练。

3、联邦学习技术由于不交换数据而交换模型参数,所以大大降低了数据隐私泄漏的风险,但近几年来,随着该方面技术的深入研究与探索,技术人员发现联邦学习技术同样存在隐私数据泄漏的隐患,在进行模型参数更新的过程中,攻击者可以对参数进行截取捕获,并且能够从被截取的数据中推断出模型的信息甚至是原始数据的信息。因此,在联邦学习技术中加入隐私保护技术成为了迫切需要。

4、隐私保护技术能够为信息的隐私提供严格的保护,根据联邦学习对用户隐私性的要求,差分隐私、同态加密和安全多方计算是三种最常见的隐私保护技术。其中,同态加密和安全多方计算都属于密码学方法领域。这三种技术虽然都可以达到隐私保护的目的,但是它们在工作原理和目标上都有一些差别。

5、差分隐私在2006由dwork首先提出,它给出了一种数据信息理论安全保证,即函数的输入输出结果对数据集上的所有特殊记录均不敏感,所以差分隐私常被用来抵御成员的推理攻击性。而在联邦学习中比较常见的差分隐私分为本地差分隐私和中心差分隐私。本地差分隐私是指参与方在本地进行训练的过程中添加噪声来保护参与方本地数据安全,让服务器无法获得参与方的原始数据。中心差分隐私是指在服务器端对训练完成的模型参数添加噪声,来保护在联邦学习推理过程中的数据隐私。但该种方法同样存在缺陷,如果添加噪声量过大的话,会影响训练后的模型精度。

6、同态加密在1978年由rivest等人提出,它提供了一个能够对每个加密数据都加以管理的功能,是一个可以通过对密文进行计算操作而得到正确加密结果的加密技术。作为一种不需要将密文解密就可以处理密文的方法,同态加密是目前联邦学习系统里最常用的隐私保护机制。但该种方法也存在缺点,相比较于其他的隐私保护方法,同态加密的计算更加复杂,且如果密文的数据量较大会导致传输效率的下降,并且在基于单密钥的同态加密方法中,如果参与方之中的一方被攻击者成功攻击,或者参与方中存在恶意用户,则会使得系统安全性大大降低,存在较大的安全风险。

技术实现思路

1、本发明目的在于解决背景技术中提出的问题,提供一种基于多密钥同态加密和拉普拉斯差分的农业保险数据隐私保护方法,以保护各农业保险企业之间进行联邦学习时,各参与方的本地敏感数据信息的隐私性和安全性。

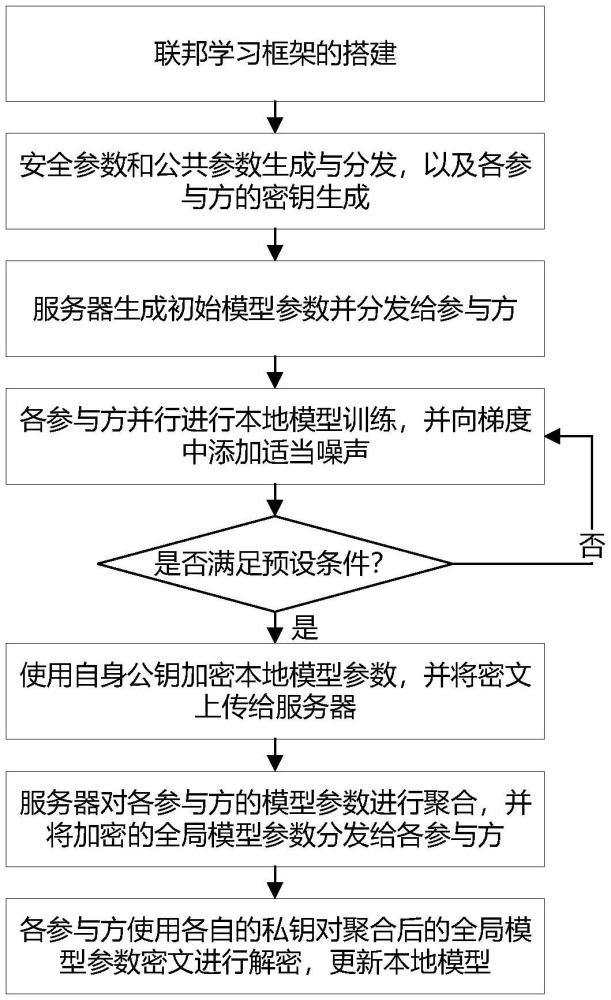

2、为了实现本发明目的,本发明公开了一种基于多密钥同态加密和拉普拉斯差分的农业保险数据隐私保护方法,包括以下步骤:

3、步骤1、联邦学习框架的搭建;由各农业保险企业、中心服务器、密钥生成中心来组成横向、纵向联邦学习框架;

4、步骤2、参数分发以及密钥生成;由密钥生成中心初始化多密钥同态加密安全参数和公共参数,并将参数发送给各个参与方,各个参与方通过公共参数生成不同的密钥对;

5、步骤3、服务器生成初始模型参数并发送给参与本轮训练的各参与方;

6、步骤4、各参与方并行进行本地模型训练;随机选取并利用本地数据集进行训练,并向训练梯度中添加满足差分隐私的噪声,保护本地模型参数并实现模型参数的更新;

7、步骤5、在训练出满足预设条件的模型后,各参与方将本地模型参数通过由步骤2得到的公钥进行加密,并将自身公钥与模型参数密文上传到服务器;

8、步骤6、服务器对各参与方的本地模型参数的密文进行聚合,得到由多密钥同态加密算法加密后的全局模型,并将加密的全局模型参数分发给各参与方;

9、步骤7、各参与方使用各自的私钥对聚合后已加密的全局模型进行解密,更新本地模型。

10、进一步地,步骤1中,各参与方之间、各参与方与中心服务器、各参与方与密钥生成中心建立可信传递通道;其中,各参与方与服务器之间的通道用于传递初始模型参数和训练好的模型参数;各参与方与密钥生成中心之间的通道用于传递各密钥对,服务器与密钥生成中心之间的通道用来传递经操作后的模型参数密文和乘积公钥pk。

11、进一步地,步骤2包括以下步骤:

12、步骤2.1、密钥生成中心确定安全参数λ,安全参数用来生成公共参数;

13、步骤2.2、选择一个λ位的模数n=pq,其中p=2p'+1,q=2q'+1,而p'、q'分别为不同的质数,再选择一个阶为pp'qq'的随机参数使得gp′q′(mod n2)=1+kn,其中k∈[1,n-1];明文空间为zn,误差分布φ∈r,r上的分布x=x(λ)为密钥分布,因此其公共参数pp=(n,k,g,φ,a),其中a为随机向量其中表示向量中元素属于zn的k维向量,以及生成主私钥mk=(p',q');

14、步骤2.3、密钥生成中心向各个参与方发送公共参数pp,各个参与方i通过公共参数pp生成不同的密钥对(pki,ski),其中,私钥ski=si,参数si为从随机选取,而公钥

15、进一步地,步骤3包括以下步骤:

16、步骤3.1、服务器初始化模型参数;

17、步骤3.2、服务器将初始模型参数发送给各个参与方。

18、进一步地,步骤4包括以下步骤:

19、步骤4.1、各参与方获得初始模型参数;

20、步骤4.2、各参与方随机选取参与训练的本地数据集;

21、其中,各参与方从各自所拥有的数据集中随机选取若干个数据集组成本轮批次参与训练的数据集;

22、步骤4.3、各参与方通过对初始模型参数与选取数据集执行梯度计算,并根据损失函数l得到梯度参数并对梯度参数进行裁剪得到裁剪梯度参数

23、步骤4.4、各参与方在得到所有数据对应的梯度值之后,对所有梯度值添加拉普拉斯噪声,并将经过差分隐私处理的梯度值进行求和并平均,得到该批次加噪后的本地模型平均梯度参数

24、步骤4.5、使用优化算法随机梯度下降法来对模型参数进行更新,其中,ω为步长或学习率,wi为各参与方持有的模型参数;

25、步骤4.6、各参与方重复执行步骤4.2至步骤4.6,直至训练出满足条件的本地模型参数。

26、进一步地,步骤5包括以下步骤:

27、步骤5.1、各参与方使用各自的公钥pki对本地模型参数wi进行加密,得到密文包含两个值(ai,bi),其中ai=gr(mod n2),bi=gr(1+mn)(mod n2),r为各参与方从zn中随机选择的数;

28、步骤5.2、各参与方将加密后的模型参数上传至服务器,服务器接收到所有参与方发送来的密文集合为其中,t为参与方数量。

29、进一步地,步骤6包括以下步骤:

30、步骤6.1、服务器在接收到所有参与方上传的本地模型参数w*后,将使用keyen算法将所有参与方发送的参数密文转换为乘积公钥pk加密下的密文encpk(wi),而不改变底层明文,其中,

31、

32、其中keyen算法具体来说,对于在参与方的公钥pki下加密的给定密文(ai,bi),服务器使用随机消息τi∈zn对密文进行盲化然后将和各参与方的公钥pki发送给密钥生成中心;

33、密钥生成中心计算乘积公钥并使用主私钥解密密文再使用乘积公钥加密盲化明文随后将(ci,di)发送回服务器;

34、其中,主私钥解密算法具体为:给定一个密文c=9a,b),然后算法通过mk、pk、pp解密c得到m,首先计算其中k-1表示k模n的逆,然后计算定义δ为p'q'模n的逆,令v=ar(mod n),得到明文

35、最后服务器利用加法同态的性质移除τi得到乘积公钥pk加密下的密文

36、步骤6.2、服务器执行聚合操作,其中°代表同态加密方案中的加法操作;

37、步骤6.3、服务器执行trandec算法,将聚合模型参数密文转换为t个使用参与方公钥pki加密的聚合模型参数密文

38、步骤6.4、服务器将聚合模型参数密文发送给所有参与方。

39、进一步地,步骤7包括以下步骤:

40、各参与方收到聚合模型参数密文后使用各自的私钥ski解密获得全局模型参数最后将用于更新本地模型;

41、其中,解密具体算法为:给定密文c=(a,b)和sk=a,通过公式得到明文m。

42、与现有技术相比,本发明的显著进步在于:1)在传统的联邦学习基础之上,引入了差分隐私技术,在本地模型训练过程中向所有数据对应的梯度值添加适当的拉普拉斯噪声,大大降低存在恶意参与方进行推断攻击的风险以及其他可能的隐私攻击手段;2)使用多密钥同态加密算法对训练过程中的模型参数进行加密,每一位参与方用自身的公钥加密自身本地训练的模型参数,相比于传统的单密钥同态加密算法,该算法保证了参与方之间互不泄露隐私的问题,并防止存在多个恶意的内部客户端联合攻击的情形,以及使得服务器等第三方无法获得全局模型参数,进一步增加了系统的安全性。

43、为更清楚说明本发明的功能特性以及结构参数,下面结合附图及具体实施方式进一步说明。

本文地址:https://www.jishuxx.com/zhuanli/20250110/353671.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表