多模态语音识别方法、装置、冰箱及存储介质与流程

- 国知局

- 2024-06-21 11:30:20

本发明涉及计算机,具体地涉及一种多模态语音识别方法、装置、冰箱及存储介质。

背景技术:

1、伴随多模态语音识别、图像识别技术、多模态神经网络的快速发展,目前多模态语音识别技术在智能家居如冰箱的应用场景日益广泛。目前多模态语音识别技术在智能家居如冰箱智能应用场景日益广泛及重要,比如“请看我手机上拍照的宫保鸡丁,冰箱是否有充裕的食材”,这句话就涉及到多模态语音识别技术。当前智能家居至少带有二个摄像头及麦克风阵列硬件,因此利用这些硬件或软件所采集到多模态数据进而降低多模态识别字错误率,但是现有技术发明专利都未涉及到多模态语音识别在智能家居比如智能冰箱人机交互或智能交互、信息获取分发等利用所采集到语音、音视频等多模态数据解决所述的问题。首先,有些方法仅仅所采集到多模态数据分离出语音数据进行识别,而忽视了多模态语音数据之间还存在语音特征或信号的关联;其次,虽然对多模态语音数据之间考虑到的关联关系,但是忽视了对多模态语音数据与多模态视频数据之间存在语音特征关系,导致比如输出端多模态语音识别准确率低等问题;再次,有些方法多模态语音数据识别后的文本存在语义关系,优化识别后的文本蕴含上下文关系等深层因素,这些方法都未提高识别准确率即存在局限性

2、因此有必要对多模态语音识别采用有效方法进而提升智能家居如智能冰箱人机交互的便捷沟通方式,以及降低多模态语音识别的字错误率的问题。

技术实现思路

1、本发明的目的在于提供一种多模态语音识别方法、装置、冰箱及存储介质。

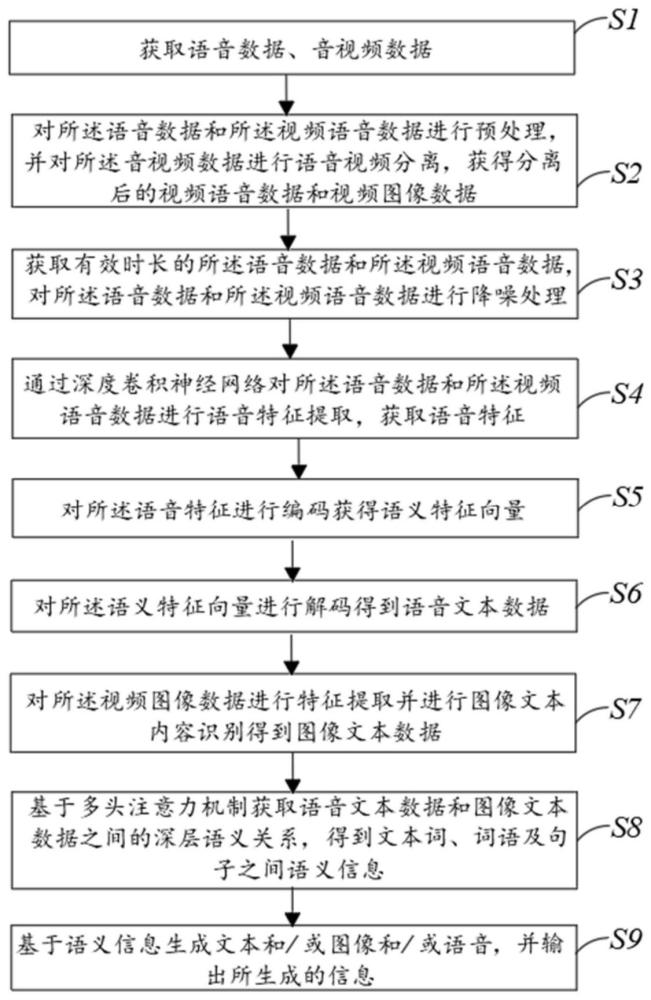

2、本发明提供一种多模态语音识别方法,其包括步骤:

3、获取语音数据、音视频数据;

4、对所述语音数据和所述音视频数据进行预处理,并对所述音视频数据进行语音视频分离,获得分离后的视频语音数据和视频图像数据;

5、获取有效时长的所述语音数据和所述视频语音数据,对所述语音数据和所述视频语音数据进行降噪处理;

6、通过深度卷积神经网络进行语音特征提取,获取语音特征;

7、对所述语音特征进行编码获得语义特征向量;

8、对所述语义特征向量进行解码得到语音文本数据;

9、对所述视频图像数据进行特征提取并进行图像文本内容识别得到图像文本数据;

10、基于多头注意力机制获取语音文本数据和图像文本数据之间的深层语义关系,得到文本词、词语及句子之间语义信息;

11、基于语义信息生成文本和/或图像和/或语音,并输出所生成的信息。

12、作为本发明的进一步改进,所述对所述语音数据和所述视频语音数据进行降噪处理,具体包括:

13、通过双向长短时记忆网络基于所述语音数据和所述视频语音数据前后序列关系和上下文信息消除所述视频语音数据的回声和噪声。

14、作为本发明的进一步改进,在处理后获取有效时长的所述语音数据和所述视频语音数据后,还包括:

15、对所述语音数据和所述视频语音数据进行过滤,筛除部分冗余语音信号。作为本发明的进一步改进,所述对所述语音特征进行编码获得语义特征向量,具体包括:

16、通过wav2vec模型将所述语音特征进行编码获得语义特征向量。

17、作为本发明的进一步改进,所述对所述语义特征向量进行解码得到语音文本数据,具体包括:

18、通过多层transformer深度网络模型对所述语义特征向量进行解码得到语音文本数据。

19、作为本发明的进一步改进,所述对所述视频图像数据进行特征提取并进行图像文本内容识别得到图像文本数据,具体包括:

20、将视频图像数据输入bert模型获取图像特征序列;

21、通过基于时空和长距离依赖特征的蒸馏扩散深度融合模型得到图像语义表示;

22、通过连接时序分类和全连接层将图像语义进行输出。

23、作为本发明的进一步改进,所述通过基于时空和长距离依赖特征的蒸馏扩散深度融合模型得到图像语义表示,具体包括:

24、蒸馏扩散深度融合模型训练好后,将教师模型引入一个时间和空间连续的学生模型,得到与教师模型具有相同参数的学生模型;

25、将蒸馏模型转为离散时间步且步数短的学生模型,重复进行上述步骤,直到将教师模型蒸馏为学生模型的一半步数即n/2。

26、作为本发明的进一步改进,所述对所述视频图像数据进行特征提取并进行图像文本内容识别得到图像文本数据,具体包括:

27、采用clip模型,将视频图像数据进行编解码得到文本信息。

28、作为本发明的进一步改进,所述基于多头注意力机制获取语音文本数据和图像文本数据之间的深层语义关系,具体包括:

29、基于transformer模型的多头注意力机制获取语音文本数据和图像文本数据之间的深层语义关系。

30、作为本发明的进一步改进,所述对所述语音数据和音视频数据进行预处理,包括:

31、对所述语音数据和音视频数据进行数据清洗、格式转化及存储任务。

32、作为本发明的进一步改进,所述基于语义信息生成文本和/或图像和/或语音具体包括:

33、基于语义信息生成文本,和/或

34、基于语义信息采用clip模型方法生成图像,和/或

35、基于语义信息采用波形拼接和端到端神经网络模型生成语音。

36、作为本发明的进一步改进,所述获取语音数据、音视频数据,具体包括:

37、获取语音采集装置所采集的所述语音数据,和/或

38、获取自客户终端传输的所述语音数据;

39、获取语音采集装置所采集的所述音视频数据,和/或

40、获取自客户终端传输的所述音视频数据。

41、作为本发明的进一步改进,所述输出所生成的信息,具体包括:

42、将所述生成的文本和/或图像和/或语音直接输出,和/或

43、将所述生成的文本和/或图像和/或语音传输至客户终端输出。

44、本发明还提供一种多模态语音识别装置,其包括:

45、数据获取模块,用于获取语音数据、音视频数据;

46、语音数据处理模块,用于对所述语音数据和所述音视频数据进行预处理,并对所述音视频数据进行语音视频分离,获得分离后的视频语音数据和视频图像数据;

47、编码模块,用于对所述语音特征进行编码获得语义特征向量;

48、解码模块,用于对所述语义特征向量进行解码得到语音文本数据;

49、视频图像数据处理模块,用于对所述视频图像数据进行特征提取并进行图像文本内容识别得到图像文本数据;

50、多头注意力机制模块,用于基于多头注意力机制获取语音文本数据和图像文本数据之间的深层语义关系,得到文本词、词语及句子之间语义信息;

51、结果生成和输出模块,基于语义信息生成文本和/或图像和/或语音,并输出所生成的信息。

52、作为本发明的进一步改进,所述语音数据处理模块通过双向长短时记忆网络基于所述语音数据和所述视频语音数据前后序列关系和上下文信息消除所述视频语音数据的回声和噪声。

53、作为本发明的进一步改进,所述编码模块通过wav2vec模型将所述语音特征进行编码获得语义特征向量。

54、作为本发明的进一步改进,所述解码模块通过多层transformer深度网络模型对所述语义特征向量进行解码得到语音文本数据。

55、作为本发明的进一步改进,所述结果生成和输出模块基于语义信息生成文本,和/或基于语义信息采用clip模型方法生成图像,和/或基于语义信息采用波形拼接和端到端神经网络模型生成语音。

56、本发明还提供一种冰箱,其包括:

57、存储器,用于存储可执行指令;

58、处理器,用于运行所述存储器存储的可执行指令时,实现上述的多模态语音识别方法。

59、本发明还提供一种计算机可读存储介质,其存储有可执行指令,所述可执行指令被处理器执行时实现上述的多模态语音识别方法。

60、本发明的有益效果是:本发明引入图像识别和文本理解,提取图像特征并生成文本信息,实现语音与图像间的有效联系。此外,采用多头注意力机制对文本进行深层语义关系建模,强化词、短语、句子间的语义联系。综合应用多模态信息、声音处理和深度学习,提高多模态语音识别准确性和智能家居交互效率。通过有效的声音分离、编码解码和深层语义建模,实现了更准确的语音识别结果和深度理解,从而大幅提升了语音识别的性能,增强了用户与智能设备的交互体验。

本文地址:https://www.jishuxx.com/zhuanli/20240618/21917.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。