声音定制方法、装置、设备及存储介质与流程

- 国知局

- 2024-06-21 11:52:53

本发明涉及声音处理,尤其涉及一种声音定制方法、装置、设备及存储介质。

背景技术:

1、目前,在数字播报领域,播报类数字人的声音定制已成为一项关键的技术挑战和研究热点。随着数字播报技术的进步和市场需求的迅速增长,用户不仅期望数字播报人物在视觉上逼真,更希望其声音能够提供丰富、个性化的听觉体验。这种需求促使研究人员开发出能够合成具有特定情感、语调和个性风格的高级语音系统。在播报类数字人的应用中,声音定制的研究不仅着眼于使合成语音更加自然真实,还关注于如何根据不同播报场景和用户的个性化需求调整声音属性。这一研究方向不仅对提升数字播报人物的交互质量和真实感至关重要,也对推动其在新闻、教育、娱乐和客户服务等领域的应用潜力具有重大影响。

2、语音合成技术作为声音定制的关键技术,然而中文语音合成面临着若干挑战。首先,中文的发音规则比英文复杂得多。作为一种四声调语言,中文的发音取决于声韵母和声调的结合,而且存在着众多的多音字、儿化音和变调现象。这些发音特点与句子的上下文和韵律结构紧密相连,要求语音合成模型能够有效地提取上下文和语义信息。其次,中文表达中的情感色彩更加丰富和多变。同一句话,根据不同的语气和情感色彩,可以传达出不同的含义,这就要求中文语音合成能够整合更加丰富的情感信息,以提升发音的自然度和表现力。此外,尽管英文语音合成领域已经积累了大量高质量的数据集,中文语音数据集却相对较少,规模更小,并且面临着方言多样性的挑战,这些因素都增加了中文语音合成模型的建模难度和复杂性。

3、因此,亟需一种声音定制方法,能够有效提高中文语音合成的自然度和合成效率。

技术实现思路

1、本发明的主要目的在于提供了一种声音定制方法、装置、设备及存储介质,旨在解决如何提高中文语音合成的自然度和合成效率的技术问题。

2、为实现上述目的,本发明提供了一种声音定制方法,所述方法包括以下步骤:

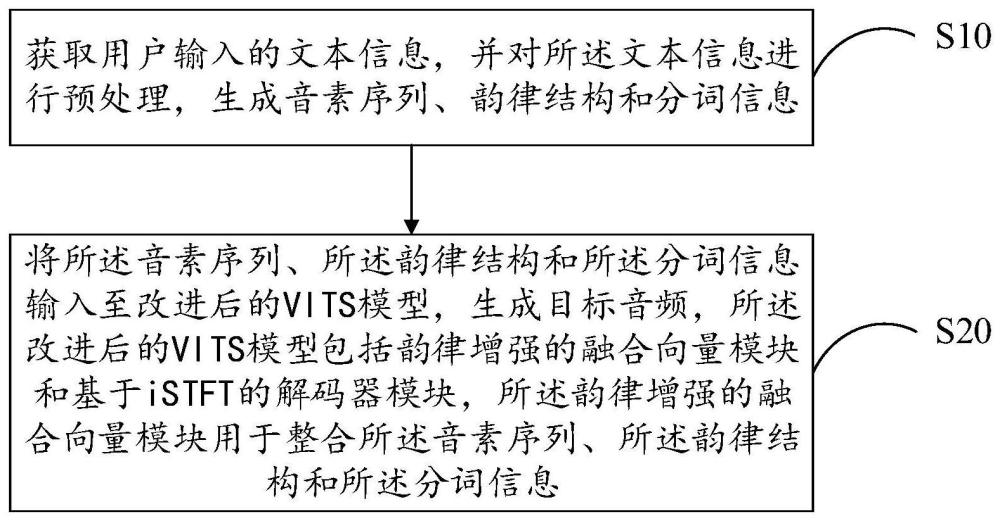

3、获取用户输入的文本信息,并对所述文本信息进行预处理,生成音素序列、韵律结构和分词信息;

4、将所述音素序列、所述韵律结构和所述分词信息输入至改进后的vits模型,生成目标音频,所述改进后的vits模型包括韵律增强的融合向量模块和基于istft的解码器模块,所述韵律增强的融合向量模块用于整合所述音素序列、所述韵律结构和所述分词信息。

5、可选地,所述分词信息包括分词文本和分词标签,所述对所述文本信息进行预处理,生成音素序列、韵律结构和分词信息的步骤,包括:

6、对所述文本信息进行分句处理,获得句子单元;

7、通过各所述句子单元进行分词处理,获得初始分词文本,并对各所述初始分词文本进行词性标注,生成初始分词标签;

8、将各所述初始分词文本和各所述初始分词标签进行特征符号转换和标准化处理,获得分词文本和分词标签;

9、根据所述分词文本和所述分词标签,通过韵律结构预测模型预测所述文本信息的韵律结构;

10、基于所述分词文本和所述分词标签,通过拼音音素转化器将所述文本信息转化为音素序列。

11、可选地,所述获取用户输入的文本信息,并对所述文本信息进行预处理,生成音素序列、韵律结构和分词信息的步骤之前,还包括:

12、构建vits模型,并对所述vits模型进行改进,获得初始vits模型;

13、对所述初始vits模型进行训练,获得改进后的vits模型;

14、相应地,所述构建vits模型,并对所述vits模型进行改进,获得初始vits模型的步骤,包括:

15、构建vits模型,在所述vits模型的基础上添加韵律增强的融合向量模块,所述韵律增强的融合向量模块用于将音素序列、韵律结构和分词信息输入至一文本编码器,生成融合向量;

16、在添加所述韵律增强的融合向量模块后,通过将istft模型替代hifi-gan中部分重复的网络层,并引入多子带并行生成策略,以实现将所述vits模型的解码器模块替换为基于istft的解码器模块,获得初始vits模型。

17、可选地,所述根据所述分词文本和所述分词标签,通过韵律结构预测模型预测所述文本信息的韵律结构的步骤之前,还包括:

18、获取语料数据,所述语料数据包括韵律特征、音素序列和音频数据,所述韵律特征包括时长、音高和音强;

19、将spanpsp模型作为初始韵律结构预测模型,并将所述语料数据输入至所述初始韵律结构预测模型中进行模型训练,获得训练结果;

20、基于所述训练结果,对所述初始韵律结构预测模型进行优化,获得韵律结构预测模型。

21、可选地,所述将各所述初始分词文本和各所述初始分词标签进行特征符号转换和标准化处理,获得分词文本和分词标签的步骤之后,还包括:

22、根据所述分词文本和所述分词标签,通过多音字消歧模型处理多音字问题,以确保正确的拼音转换。

23、可选地,所述对所述文本信息进行分句处理,获得句子单元的步骤之前,还包括:

24、基于所述文本信息,判断是否对所述文本信息进行分句处理;

25、若不需要对所述文本信息进行分句处理,则对所述文本信息进行分词处理,获得初始分词文本,并对各所述初始分词文本进行词性标注,生成初始分词标签;

26、相应地,若需要对所述文本信息进行分句处理,则执行所述对所述文本信息进行分句处理,获得句子单元的步骤。

27、可选地,所述将所述音素序列、所述韵律结构和所述分词信息输入至改进后的vits模型,生成目标音频的步骤之后,还包括:

28、基于所述目标音频,通过faceformer模型生成3d人脸动画;

29、根据用户操作指令,控制所述目标音频的播放展示和所述3d人脸动画的可视化展示。

30、此外,为实现上述目的,本发明还提出一种声音定制装置,所述声音定制装置包括:

31、信息获取模块,用于获取用户输入的文本信息,并对所述文本信息进行预处理,生成音素序列、韵律结构和分词信息;

32、音频生成模块,用于将所述音素序列、所述韵律结构和所述分词信息输入至改进后的vits模型,生成目标音频,所述改进后的vits模型包括韵律增强的融合向量模块和基于istft的解码器模块,所述韵律增强的融合向量模块用于整合所述音素序列、所述韵律结构和所述分词信息。

33、此外,为实现上述目的,本发明还提出一种声音定制设备,所述设备包括:存储器、处理器及存储在所述存储器上并可在所述处理器上运行的声音定制程序,所述声音定制程序配置为实现如上文所述的声音定制方法的步骤。

34、此外,为实现上述目的,本发明还提出一种存储介质,所述存储介质上存储有声音定制程序,所述声音定制程序被处理器执行时实现如上文所述的声音定制方法的步骤。

35、本发明通过获取用户输入的文本信息,并对所述文本信息进行预处理,生成音素序列、韵律结构和分词信息;将所述音素序列、所述韵律结构和所述分词信息输入至改进后的vits模型,生成目标音频,所述改进后的vits模型包括韵律增强的融合向量模块和基于istft的解码器模块,所述韵律增强的融合向量模块用于整合所述音素序列、所述韵律结构和所述分词信息。由于本发明通过韵律增强的融合向量模块整合音素序列、韵律结构和分词信息,并引入基于istft的解码器模块,相比于现有技术,本发明不仅提升了中文语音合成的自然度,还提升了中文语音合成的效率。

本文地址:https://www.jishuxx.com/zhuanli/20240618/24221.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表