基于改进YOLOv7的X光安检图像违禁物品检测方法

- 国知局

- 2024-07-31 23:10:52

本发明属于目标检测领域,涉及一种基于改进yolov7的x光安检图像违禁物品检测方法。

背景技术:

1、由于公共交通领域存在人流量大、半封闭性等特殊情况,其安全问题一直以来都是人们关注的重心。在对来往旅客的行李检查时,使用能发射x射线的安全检查仪器可以生成能显示物体内部结构和形状的安检图像,此时安检人员可以通过人工实时观察图像中是否含有违禁物品进行人工安检。

2、但随着科技的进步以及经济水平的提高,我国的交通系统规模不断扩大,乘客流量不断增加,如何在减轻安检人员工作量的情况下,经济高效地利用安检图像进行违禁物品自动检测成为了新的挑战和要求。

3、在深度学习和人工智能快速发展的今天,由机器辅助人工实现全自动化安检具有重要意义,然而安检图像中不但物品摆放混乱,而且物品特征模糊不清,极其不利于现有目标检测模型对违禁物品的自动识别定位,导致目前目标检测模型的检测精度还有待提高,而误检率和漏检率也有待降低。

技术实现思路

1、有鉴于此,本发明的目的在于提供一种基于改进yolov7的x光安检图像违禁物品检测方法,解决上述现有技术中存在的问题。

2、为达到上述目的,本发明提供如下技术方案:

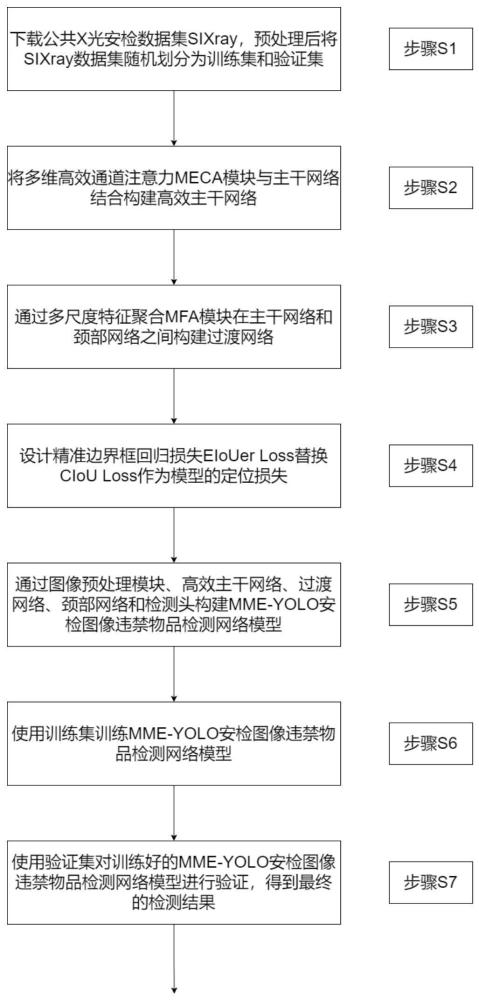

3、一种基于改进yolov7的x光安检图像违禁物品检测方法,包括以下步骤:

4、s1:对安检数据集进行预处理,并随机划分为训练集和验证集;

5、s2:将多维高效通道注意力模块meca与主干网络结合构建高效主干网络;

6、s3:通过多尺度特征聚合模块mfa在主干网络和颈部网络之间构建过渡网络;

7、s4:设计精准边界框回归损失eiouer loss替换ciou loss作为模型的定位损失;

8、s5:通过图像预处理模块、高效主干网络、过渡网络、颈部网络和检测头构建mme-yolo安检图像违禁物品检测网络模型;

9、s6:将训练集数据输入所述mme-yolo模型中并进行训练;

10、s7:将验证集数据输入训练好的mme-yolo模型中进行验证,得到最终的检测结果。

11、进一步,步骤s1所述预处理包括将安检数据集中只存在较少样本的锤子种类的图片去除,不参与模型的训练和验证。

12、进一步,所述高效主干网络由cbs模块、elan模块、mp模块和多维高效通道注意力模块meca组成;

13、所述cbs模块中集合卷积层、批归一化层和激活函数,用于提取目标特征;

14、所述elan模块中含有四个分支,第一分支中有1个cbs模块,第二分支中有1个cbs模块,第三分支中有2个cbs模块,第四分支中有2个cbs模块,不同分支间使用密集残差结构,通过叠加来自不同梯度路径的特征层使模型学习到更多的信息;

15、所述mp模块通过使用卷积和最大池化来最大限度在下采样的过程中保留下目标的特征信息;

16、所述多维高效通道注意力模块meca中,首先将输入特征图分别通过全局最大池化和全局平均池化得到对应的特征描述向量,随后将得到的最大池化特征描述向量和平均池化特征描述向量在维度上堆叠,最大化保存有效特征信息;然后通过一维卷积完成跨通道间的信息交互,卷积核大小通过自适应函数确定,卷积核自适应函数如下所示:

17、

18、其中,k表示卷积核大小,c表示通道数,b和γ用于改变通道数和卷积核之间的比例,odd表示卷积核大小,只能取奇数。

19、进一步,所述过渡网络由cbs模块、sppcspc模块和多尺度特征聚合模块mfa组成,设置在主干网络和颈部网络之间,用于将主干网络输出的特征图从维度和空间的角度上进行特征再聚合;

20、所述sppcspc模块使用空间金字塔池化使模型适应不同分辨率的图像,增大感受野;

21、所述多尺度特征聚合模块mfa通过结合空间金字塔池化spp模块和卷积块注意力模块cbam从多尺度的角度提高网络对违禁物品特征信息的关注度;其中,所述空间金字塔池化spp模块中设有多样的池化核心数量,特征图在经过不同大小的池化核之后,再重新将维度堆叠,并依次通过两个尺度不同的卷积层,捕获到违禁物品的全局上下文先验信息;

22、所述卷积块注意力模块cbam由通道注意力模块cam和空间注意力模块sam串联构成,先将输入特征图进行全局最大池化和全局平均池化聚合特征映射的空间信息,学习不同通道的重要程度,随后通过多层感知机捕捉到多个通道间特征信息的相互依赖关系,最后通过激活函数生成通道注意力图并与输入特征图相结合生成通道注意力特征图;

23、将通道注意力特征图输入到空间注意力模块sam中,分别在通道上提取平均值和最大值,将网络的重心置于特征图的某个局部,让违禁物品的特征信息更容易被网络所关注;

24、最后将输入特征图、空间金字塔池化spp模块输出的多尺度特征图和卷积块注意力模块cbam输出的注意力特征图结合在一起,并通过卷积层将不同维度上的特征进行深度融合,最终形成含有丰富感知场和特征信息的多尺度聚合特征。

25、进一步,精准边界框回归损失eiouer loss的构建首先是通过引入eiou loss替换yolov7中的边界框损失函数ciou loss,将宽损失与高损失分开计算;然后对eiou loss进行改进,定义一种仅与预测框和真实框的宽高值相关的宽高损失函数,并设计约束函数来限制宽损失和高损失的值,防止损失爆炸;具体由以下公式所示:

26、

27、

28、其中,b和bgt分别代表预测框与真实框的中心点,w和wgt分别代表预测框和真实框的宽,h和hgt分别代表预测框和真实框的高,ρ表示计算其中两个参数的欧氏距离,c代表包含预测框与真实框的最小外接矩形框的对角线长度,s(x)代表约束函数。

29、进一步,所述mme-yolo安检图像违禁物品检测网络模型由图像预处理模块、高效主干网络、过渡网络、颈部网络和检测头组成;

30、所述图像预处理模块将安检数据集sixray中所有图像调整为640*640的尺寸,并使用mosaic和mixup作为数据增强策略,将训练数据进行数据增强后输入高效主干网络对其特征进行提取;

31、所述高效主干网络负责从输入图像中捕获不同层次的特征,并逐渐减小特征图的分辨率;

32、所述过渡网络负责对主干网络输出的特征图进行特征重聚合,输出丰富感知场和特征信息的多尺度聚合特征;

33、所述颈部网络首先使用特征金字塔网络结构自底向上逐步上采样并融合过渡网络输出的多尺度聚合特征,接着使用路径聚合网络结构自顶向下逐步下采样并融合特征金字塔网络输出的特征图,最后将特征图分为三个不同尺度依次传入检测头中;

34、所述检测头包含三个针对不同目标尺寸的设计的检测头部,分别接收颈部网络传入的大尺寸特征、中尺寸特征和小尺寸特征,并使用精准边界框回归损失eiouer loss来度量模型预测结果与真实边界框之间的差异程度,最后输出检测结果。

35、本发明的有益效果在于:

36、第一,本发明通过将多维高效通道注意力meca模块与主干网络结合构建高效主干网络,在保持计算效率的同时加强了特征提取能力。

37、第二,本发明通过多尺度特征聚合mfa模块在主干网络和颈部网络之间构建过渡网络,增加了模型整体的特征提取能力。

38、第三,本发明通过设计精准边界框回归损失eiouer loss替换ciou loss作为模型的定位损失,提高了模型的收敛速度和收敛精度,提升了模型的检测效果。

39、第四,本发明的检测方法明显提高对x光安检图像中违禁物品的检测精度,预测框更加贴近目标物体,实现了更高的检测精度。

40、本发明的其他优点、目标和特征在某种程度上将在随后的说明书中进行阐述,并且在某种程度上,基于对下文的考察研究对本领域技术人员而言将是显而易见的,或者可以从本发明的实践中得到教导。本发明的目标和其他优点可以通过下面的说明书来实现和获得。

本文地址:https://www.jishuxx.com/zhuanli/20240730/196265.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。