一种面向多模态神经信号的上下文语义协同建模方法

- 国知局

- 2024-08-08 17:04:15

本发明属于语义分析,具体涉及一种面向多模态神经信号的上下文语义协同建模方法。

背景技术:

1、分析多模态神经信号(包括mri、dti、fmri、eeg等神经信号或神经影像)以辅助诊断和治疗神经疾病是一项复杂且不断发展的技术,不同模态神经信号通过测量大脑活动来提供有关神经系统功能的信息,这种技术在诊断多种神经疾病(如癫痫、睡眠障碍、大脑损伤等)方面非常有用。由于多模态神经信号间有着复杂的内隐关系,对这些联系的特征进行提取是分析问题的关键。

2、人工智能技术的发展让特征提取技术有了快速发展,在生物信息识别方面提供了许多帮助,例如使用特征选择、分析以及构造新特征的方法,从特征角度入手发掘语义信息,对抑郁症患者进行识别;使用三维卷积的形式对多模态语义进行分析,识别个性化感情交互;利用熵测度的方法分析神经信号,对听觉感知和选择性注意进行分析等。

3、尽管已有许多学者从不同角度对多模态神经信号进行研究分析,也取得了一些成效,但是现有精神健康的模型构建还无法满足实际需要,同时现有研究方法也存在一些问题亟需解决:1、非线性系统的准确描述能力有待提高。人工智能与情感计算的结合方向之一是将具有差异性的特征用人工智能方法进行表达,作为最复杂的非线性动力系统之一,大脑信号的准确表达模型一直在探究中,如何将多模态非线性信号进行准确地线性表达是研究的关键;2、特征表征能力不强。人脑活动具有复杂性、特异性的特点,作为最高级的生物组织活动,将多模态神经信号反映的问题进行完整的表征存在着一定挑战,目前的特征提取、特征选择大多提取的是表层特征,而其深层次特征往往更能代表大脑活动的本质,挖掘方法有待开发。3、小样本条件下方法普适性有待提高。现有的研究大多针对小样本,超过百人的研究比较少,同时,现有的脑电研究都借助了深度学习的手段,但是使用的许多方法无法很恰当地迁移到小样本上,普适性较低,即研究同一问题无法适应人群的变化。

4、为了克服这些缺陷,需要开发更高效的数据处理和语义分析方法,改进多模态神经信号概括模型和多层次特征提取算法,开发更优的分类方法,便于精神疾病的辅助诊断。

技术实现思路

1、根据以上现有技术中的不足,本发明提供了一种面向多模态神经信号的上下文语义协同建模方法,可以在小样本条件下构建对多模态神经信号进行准确表达的模型,抽取出来的特征能够准确表达数据的本质属性,构建出的模型具有较强的识别能力和泛化效果,能够更好的应用于精神疾病的辅助诊断。

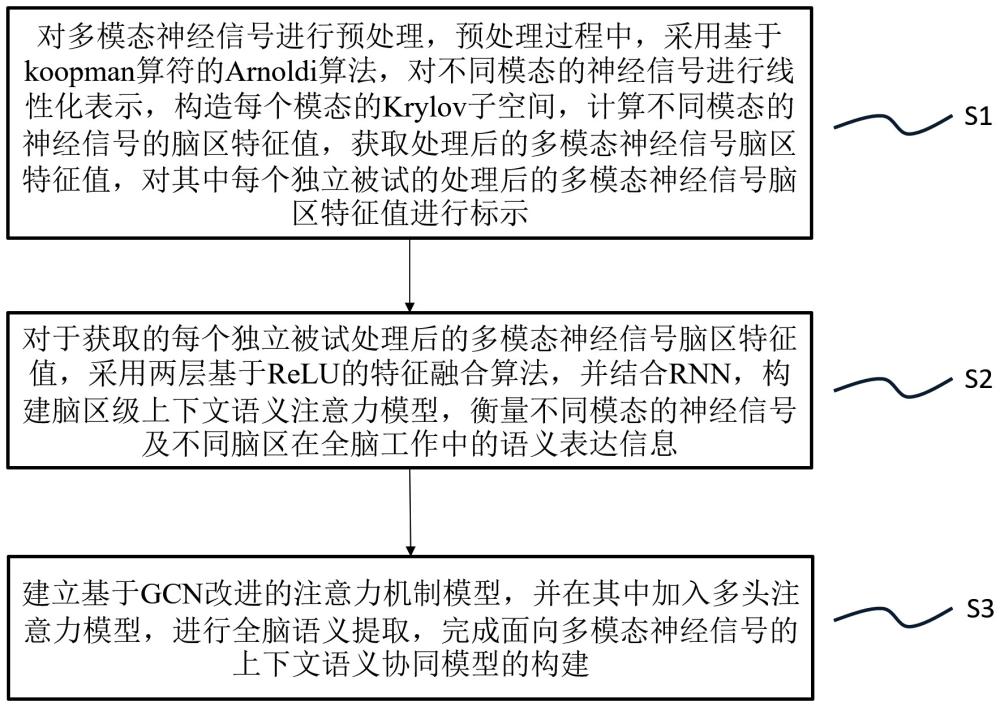

2、为达到以上目的,本发明提供了一种面向多模态神经信号的上下文语义协同建模方法,包括以下步骤:

3、s1、对多模态神经信号进行预处理,预处理过程中,采用基于koopman算符的arnoldi算法,对不同模态的神经信号进行线性化表示,构造每个模态的krylov子空间,计算不同模态的神经信号的脑区特征值,获取处理后的多模态神经信号脑区特征值,对其中每个独立被试的处理后的多模态神经信号脑区特征值进行标示;

4、s2、对于获取的每个独立被试处理后的多模态神经信号脑区特征值,采用两层基于relu的特征融合算法,并结合rnn,构建脑区级上下文语义注意力模型,衡量不同模态的神经信号及不同脑区在全脑工作中的语义表达信息;

5、s3、建立基于gcn改进的注意力机制模型,并在其中加入多头注意力模型,进行全脑语义提取,完成面向多模态神经信号的上下文语义协同模型的构建。

6、所述的s1中,计算不同模态的神经信号的脑区特征值步骤为:

7、s11、假设多模态神经信号使用线性映射来近似,表示为:

8、(1);

9、式中,,是包含时空关系的上一状态的多模态神经信号;是由得到的下一个状态的多模态神经信号;a是的矩阵特征值;r是实数;n是从0至r的整数;

10、由于神经信号是非线性动力系统,则这种近似等同于时空轨道的线性切线逼近,定义数据矩阵:

11、(2);

12、(3);

13、式中,k是krylov子空间;

14、构造krylov子空间时,还可以考虑数据特点进行构造,数据特点指的是不同数据包括时间和空间信息,比如eeg和fmri包括时间信息,mri、dti包括全脑结构信息等,不同模态信息有着不同的特点;

15、s12、将n次迭代后的写成数据点的线性组合形式:

16、(4);

17、(5);

18、式中,r为残差;是通过最小二乘法算出的组合系数;代表转置;c为中间变量;

19、s13、定义c为友矩阵:

20、(6);

21、进而,忽略r,则ak=ck,因此c的矩阵特征值与a相同;且对于c的特征向量α,cα=λα;v=kα是a的特征向量,则:

22、(7);

23、式中,λ表示特征值;v是求得的koopman模式;

24、s14、定义c的矩阵特征值为t,则可计算,则t的逆矩阵每一列分别对应的本征向量:

25、(8);

26、式中,是不同模态的神经信号的脑区特征值;

27、s15、根据式(7)可得,v=kt-1,则k表示为:

28、(9);

29、式中,,是不同模态的koopman模式的集合;

30、将式(9)展开,得到:

31、(10);

32、式中,vk是koopman模式v中的展开项;是不同模态的神经信号的脑区特征值的范德蒙行列式。

33、所述的s2中,构建脑区级上下文语义的注意力模型的步骤为:

34、s21、对于每个独立被试的处理后的多模态神经信号脑区特征值,通过式(8)获取对应的特征矩阵,得到不同被试的特征矩阵,随后对x进行bn操作,并在bn操作中间加入两层基于relu的特征融合算法对特征矩阵进行融合优化,获得优化后的特征矩阵;

35、s22、脑区级上下文语义注意力模型的权重定义为,表示为:

36、(11);

37、式中,表示模型的训练参数;表示relu激活函数;表示激活函数;

38、s23、为增加约束,表示为:

39、(12);

40、式中,f表示约束函数;i是单位矩阵;下标f表示弗罗贝尼乌斯范数;此处的上标t为转置;

41、s24、利用式(12)进行约束优化后,合成全脑信息,表示为:

42、(13);

43、式中,d是全脑信息;

44、通过式(13),脑区级上下文语义注意力模型将全脑中的脑区权重表示为二维矩阵,二维矩阵中的每一行用于表示全脑在不同角度的信息表达。

45、所述的s21中,融合优化的过程分为preceding relu和following relu两层,具体为:

46、s211、在preceding relu和following relu层,利用relu激活函数将输入h转化为;

47、s212、定义preceding relu和following relu两层的零分数比率,用于表示给定的特征矩阵中bn操作的重要程度:

48、(14);

49、式中,、分别是preceding relu和following relu的z分数;

50、s213、用表示或,z分数的计算表示为:

51、(15);

52、(16);

53、式中,n是自然数;是总的特征值;;h表示特征维度值;表示每一列特征值的占比;

54、s214、计算出后,依据衡量多模态信号不同脑区在全脑中的作用,并以此对特征矩阵进行融合优化,优化后的特征矩阵。

55、所述的s3中,基于gcn改进的注意力机制模型表示为:

56、(17);

57、式中,wp表示gcn第p层的权重系数;和分别表示gcn第p层的关注节点及其邻居节点;表示图的节点数量;u是其他节点;是当前已经遍历过的节点;q表示节点;是节点对应的注意力系数;是gcn中的激活函数。

58、preceding relu和following relu分别指的是在relu激活函数之前的层或操作,以及在relu激活函数之后的层或操作。

59、所述的s3中,将多头注意力机制加入基于gcn改进的注意力机制模型中,表示为:

60、(18);

61、式中,,为第j个自注意力头的计算结果;w是注意力权重;concact表示连接;表示多头注意力机制,用于衡量多模态及不同脑区间的协同工作机制;是被查询数据与序列的集合;表示注意力机制;m是自注意力头的个数;表示多头注意力每个自注意力头对应的被查询数据与序列的集合。

62、加入多头注意力机制后的式(17)表示为:

63、(19);

64、式中,是gcn输入层的权重;表示gcn第z层的权重系数;和分别表示gcn第z层的关注节点及其邻居节点;

65、将gcn的损失函数定义为:

66、(20);

67、式中,w是加入了多头注意力机制的gcn的权重系数;表示损失函数;θ是用于控制惩罚项的权重;是正则项编码。

68、本发明涉及的算法可以通过电子设备执行,电子设备包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,通过处理器执行软件实现上述的算法。

69、本发明所具有的有益效果是:

70、本发明通过构造多模态神经信号中每个模态的krylov子空间,并构建脑区级上下文语义注意力模型,建立基于gcn改进的注意力机制模型,并在其中加入多头注意力模型,进行全脑语义提取,可以在小样本条件下构建对多模态神经信号进行准确表达的模型,抽取出来的特征能够准确表达数据的本质属性,构建出的模型具有较强的识别能力和泛化效果,能够更好的应用于精神疾病的辅助诊断。

本文地址:https://www.jishuxx.com/zhuanli/20240808/272173.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。