基于时空融合的视频中工业文本端到端检测识别方法及装置

- 国知局

- 2024-08-22 14:22:53

本发明涉及文本检测识别,尤其涉及一种基于时空融合的视频中工业文本端到端检测识别方法及装置。

背景技术:

1、在工业环境中,通常会对运行或生产过程中的工业装备进行视频监控,从而实时观测装备的运行状态。在生产生活中,存在各类型工业文本数据(如设备标识、标号等),且其形态多样,如水平、弯曲、波浪等,甚至文本方向也各不同。现有技术中通常是人工对上述工业文本数据进行核查、校对,但费时费力,还易发生误、漏检。如果能够自动获取并理解监控视频数据中的文本,则可以有效推进生产智能化和自动化,降低人工和资源成本。

2、针对于视频文本检测,现有技术通常是采用基于单帧图像处理的方式,即每次提取出一帧图像,使用文本检测算法对提取的图像进行文本位置检测。但是该类方法由于是采用单帧处理方式,会丢失时间上下文信息,当出现目标遮挡、成像、噪声等不完整数据时会导致检测识别错误,因而仅适用于目标清晰可辨的场景。而工业环境通常较为复杂,难以确保所有的文本目标清晰可辨。且现有技术中基于深度学习的文本识别方法大多为基于字典依赖的算法,即识别精度依赖于网络训练时见过的字符串字典大小,而工业环境中工业文本数据通常是唯一不重复的(例如生产标识码),需要识别的字符串通常都在字典之外,导致字典依赖的识别算法效果不能满足工业要求。另外,一般基于深度学习的文本检测和识别算法不仅内存占用较大,且在常规的硬件平台上运行效率不高,不便于工业环境的部署和实施。

3、综上,现有技术中视频文本检测识别方法并不满足对工业环境的视频中工业文本的检测识别要求,因而亟需提供一种适用于视频工业文本的检测识别端到端方法,以实现工业环境下工业文本检测的精度、效率,同时还能够降低实现复杂度、减少所需占用的内存以便于部署和实施。

技术实现思路

1、本发明要解决的技术问题就在于:针对现有技术存在的技术问题,本发明提供一种实现方法简单、成本低、所需占用内存小且检测精度以及效率高的基于时空融合的视频中工业文本端到端检测识别方法及装置,能够轻量、快速、鲁棒且准确的实现视频中工业文本数据端到端检测识别。

2、为解决上述技术问题,本发明提出的技术方案为:

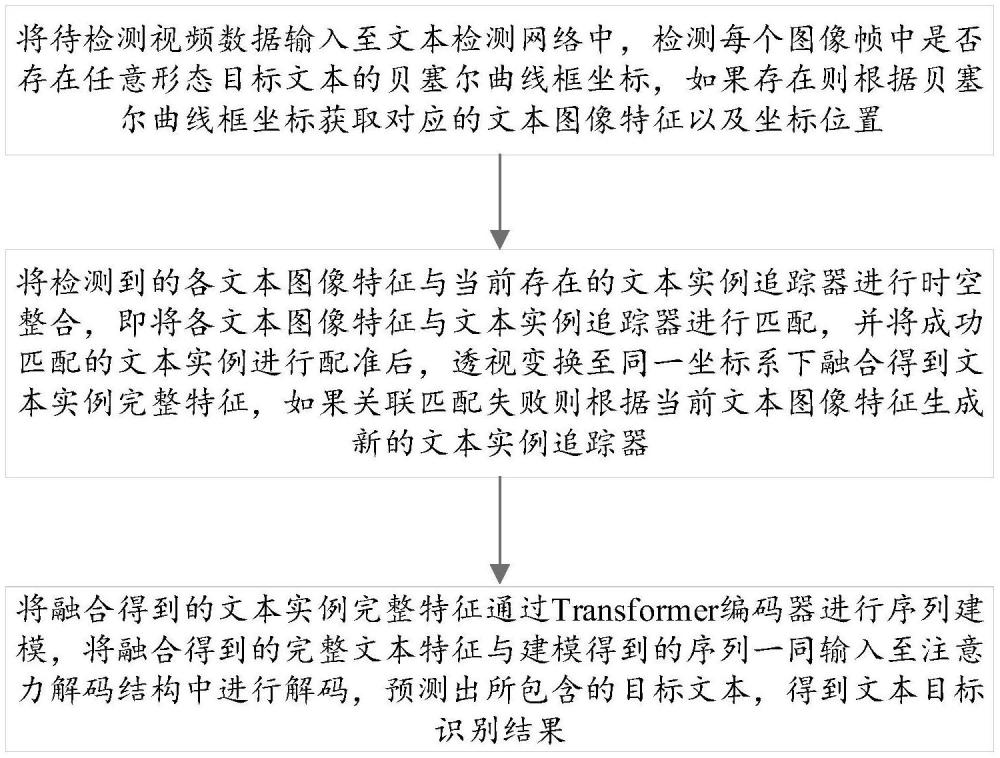

3、一种基于时空融合的视频中工业文本端到端检测识别方法,步骤包括:

4、步骤s01.多形态文本快速检测:将待检测视频数据输入至文本检测网络中,检测每个图像帧中是否存在任意形态目标文本的贝塞尔曲线框坐标,如果存在则根据贝塞尔曲线框坐标获取对应的文本图像特征以及坐标位置;

5、步骤s02.整合时空信息的文本追踪:将检测到的各文本图像特征与当前存在的文本实例追踪器进行时空整合,即将各文本图像特征与文本实例追踪器进行匹配,并将成功匹配的文本实例进行配准后,透视变换至同一坐标系下融合得到文本实例完整特征,如果关联匹配失败则根据当前文本图像特征生成新的文本实例追踪器;

6、步骤s03.无字典依赖的不定长文本识别:将融合得到的所述文本实例完整特征通过transformer编码器进行序列建模,再将阅读序编码向量与建模得到的序列一同输入至全局注意力解码结构中进行解码,预测出所包含的目标文本,得到文本目标识别结果。

7、进一步的,步骤s01的步骤包括:

8、步骤s101.将待检测视频数据帧输入至轻量骨干网络进行特征提取,得到多尺度层级特征图;

9、步骤s102.选择部分不同尺度的特征图经过带有特征增强结构的金字塔,得到增强后特征图,对所述增强后特征图进行卷积计算得到多种尺度特征图;

10、步骤s103.使用同一个检测头对当前得到的各尺度特征图进行检测,得到文本目标的贝塞尔曲线框坐标位置。

11、步骤s104.根据所述贝塞尔曲线框坐标位置从目标文本区域提取出文本图像特征输出。

12、进一步的,步骤s02的步骤包括:

13、步骤s201.遍历当前帧中每一个检测到的文本图像特征,遍历过程中使用外形特征以及语义特征为当前遍历的文本图像特征生成对应的描述子,根据所述描述子将当前遍历的文本图像特征与当前存在的文本实例追踪器进行匹配关联,确定出与当前遍历的文本图像特征最佳匹配的文本实例追踪器,如果关联匹配失败则保留当前描述子为一个新的文本实例追踪器以用于下一帧文本实例的匹配;

14、步骤s202.以特征点为单位将完成匹配的各文本图像特征与匹配的文本实例追踪器的特征进行配准,并透视变换至同一坐标系下融合得到所述文本实例完整特征。

15、进一步的,所述步骤s201中,通过将文本图像特征投影成高维向量形成对应的描述子,将各文本图像特征对应的描述子与各文本实例追踪器进行互相关操作得出距离矩阵,根据所述距离矩阵确定出与当前遍历的文本图像特征最佳匹配的文本实例追踪器。

16、进一步的,步骤s202包括:

17、步骤s221.计算待配对的文本图像特征与文本实例追踪器之间点特征的距离矩阵;

18、步骤s222.根据各点特征的距离矩阵获取待配对的文本图像特征与文本实例追踪器之间的对应同名点;

19、步骤s223.根据得到的同名点计算出单应性矩阵h;

20、步骤s224.将第t帧追踪描述子的文本特征,即t-1帧增强的文本特征,按照透视变换至当前时刻的图像坐标系下,得到与当前帧文本图像特征对齐的特征图

21、

22、步骤s225.将得到的与当前帧文本图像特征对齐的所述特征图与当前帧文本图像特征xt进行加权融合得到当前时刻完整文本特征。

23、进一步的,所述步骤s225中,按照下式将得到的所述特征图与当前帧文本图像特征xt进行加权融合,得到当前时刻完整文本特征

24、

25、其中,为第t帧追踪文本图像特征对齐后的特征图,w为权重值,xt为第t帧的文本特征图,为第t帧融合增强后的文本特征图。

26、进一步的,步骤s03的步骤包括:

27、步骤s301.由transformer编码器将融合后的图像特征通过拉直变换成高维向量后进行位置编码,将位置编码后的值经过两层transformer编码层进行图像序列建模,得到key值、value值输出;

28、步骤s302.将字符阅读序经过嵌入和位置编码后的值作为query值与所述key值、value值输入至全局注意力解码结构,采用基于全局注意力的阅读序查询方法预测每个阅读序上每个字符类别的概率值,取最大概率类别的字符得到目标文本。

29、进一步的,所述步骤s302中,所述全局注意力解码结构按照下式得到解码输出:

30、

31、其中,score为注意力分数图,q为查询阅读序,k与v分别为编码器输出的key值、value值序列,wa、wc为可学习权重,softmax与tanh均为激活函数,output为解码输出。

32、一种基于时空融合的视频中工业文本端到端检测识别装置,包括:

33、多形态文本快速检测模块,用于将待检测视频数据输入至多形态文本检测网络中,判断每个图像数据帧中是否有文本目标,如果有则获取对应的文本图像特征以及坐标位置;

34、整合时空信息的文本追踪模块,用于将检测到的各文本图像特征与当前存在的文本实例追踪器进行时空整合,即将各文本图像特征与文本实例追踪器进行匹配,并将成功匹配的文本实例进行配准后,透视变换至同一坐标系下融合得到文本实例完整特征,如果关联匹配失败则根据当前文本图像特征生成新的文本实例追踪器;

35、无字典依赖的不定长文本识别模块,用于将融合得到的所述文本实例完整特征通过transformer编码器进行序列建模,再将阅读序编码向量与建模得到的序列一同输入至全局注意力解码结构中进行解码,预测出所包含的目标文本,得到文本目标识别结果。

36、一种存储有计算机程序的计算机可读存储介质,所述计算机程序被处理器执行时实现如上述方法。

37、与现有技术相比,本发明的优点在于:本发明通过构建形成一个轻量快速的端到端文本检测识别网络,对连续视频数据先采用多形态文本快速检测网络对不同形态文本进行检测,对于检测到的文本目标采用将文本示例特征与文本实例追踪器进行关联匹配,以利用时序上下文信息进行文本追踪,若成功配对则将当前帧文本实例特征与匹配的文本实例追踪特征进行融合得到新的文本完整特征,最终基于注意力编解码机制的识别网络对不定长度的文本实例特征,采用先序列建模、后解码的方式预测特征所包含的文本内容,能够实现鲁棒检测多方向、多形态文本的端到端检测识别,还能够充分利用时间上下文信息降低对目标图像的成像质量要求,使得即使目标在移动过程中出现抖动、光照变化、遮挡等导致文本模糊或部分缺失的情况,也能够稳定连续地进行检测识别,且采用纯注意力编解码方式还能够降低对字典的依赖,同时采取的全局注意力形式能够有效、精确地完成不定长工业文本识别,在确保检测精度、效率的同时也能够尽可能降低整体架构的占用内存与访存比,从而构造形成轻量、快速、鲁棒、准确、便于工业实施的时空融合的视频文本端到端检测识别方法。

本文地址:https://www.jishuxx.com/zhuanli/20240822/278455.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。