一种基于面部视频序列的抑郁障碍识别方法及系统

- 国知局

- 2024-10-09 14:37:54

本技术涉及图像处理,尤其涉及基于面部视频序列的抑郁障碍识别方法及系统。

背景技术:

1、抑郁症作为现代社会最常见的心理疾病之一,其临床症状为长时间明显的情感失落。而且,人们常常对他们的心理健康问题也难以启齿;相比身体疾病,精神障碍更难被发现。此外,诸如社会舆论、经济成本和治疗缺位等又加剧了精神健康的负担。

2、在临床实践中,医生主要通过面对面临床问诊来判断并甄别抑郁症的严重程度,这种方式有效但是非常依赖临床经验。另一方面,现有的精神科医生无法满足实际的需求,许多人得不到准确的抑郁症诊断而错失了在早期阶段的最佳治疗。

3、面部表情在人们的交流中起着非常重要的作用,能够传达语言难以表达的微妙信息,通过观察表情的微小变化就可以判断人的心情。有研究表明,抑郁症患者的状态可以通过一些视觉特征表现出来,比如面部表情、身体姿势,而且面部表情是抑郁状态的有效外在表现。

技术实现思路

1、本技术旨在至少在一定程度上解决相关技术中的技术问题之一。

2、为此,本技术的第一个目的在于提出一种基于面部视频序列的抑郁障碍识别方法,能够基于面部视频识别抑郁情绪。

3、本技术的第二个目的在于提出一种基于面部视频序列的抑郁障碍识别系统。

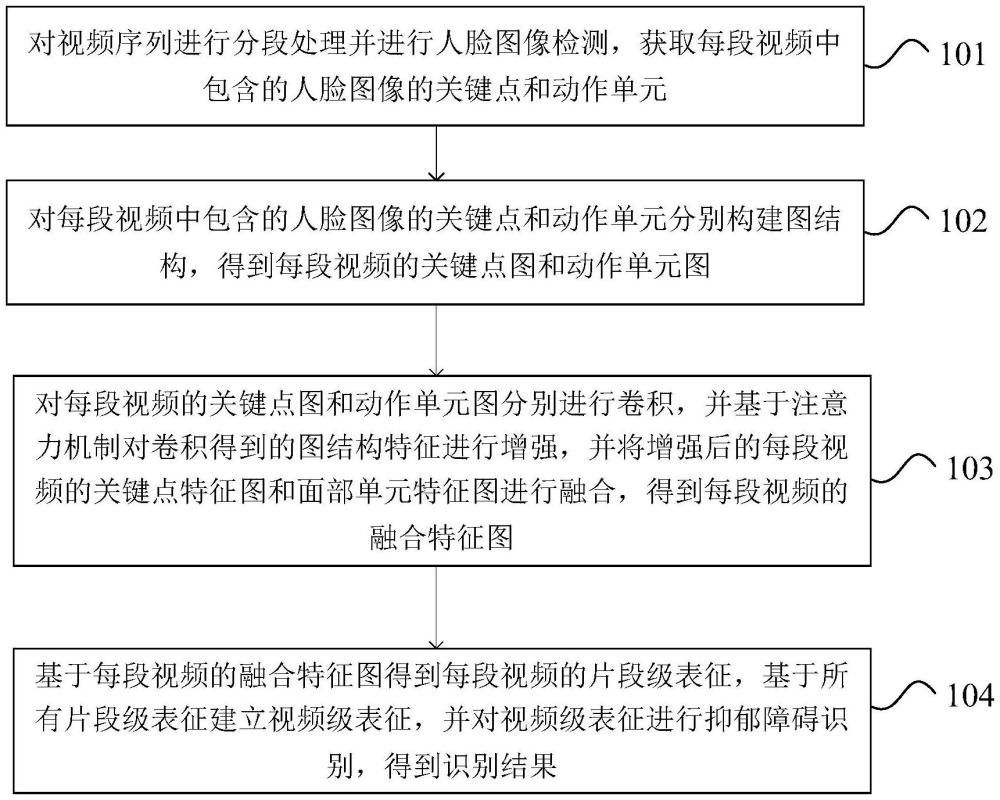

4、为达上述目的,本技术第一方面实施例提出了一种基于面部视频序列的抑郁障碍识别方法,包括:对视频序列进行分段处理并进行人脸图像检测,获取每段视频中包含的人脸图像的关键点和动作单元;对每段视频中包含的人脸图像的关键点和动作单元分别构建图结构,得到每段视频的关键点图和动作单元图;对每段视频的关键点图和动作单元图分别进行卷积,并基于注意力机制对卷积得到的图结构特征进行增强,并将增强后的每段视频的关键点特征图和面部单元特征图进行融合,得到每段视频的融合特征图;基于每段视频的融合特征图得到每段视频的片段级表征,基于所有片段级表征建立视频级表征,并对视频级表征进行抑郁障碍识别,得到识别结果。

5、本技术实施例的基于面部视频序列的抑郁障碍识别方法,首先将整段视频序列进行分割,围绕面部图像构建关键点坐标图和动作单元图;然后分别经过编码器进行时空特征聚合和融合;最后,通过片段级视频表征进行抑郁症的识别,本实施例能够客观、精准的抑郁障碍自动识别,从而促进抑郁障碍的早发现、早治疗、早干预。

6、可选地,在本技术的一个实施例中,给定关键点序列{cl,n,t}分别表示坐标维度、关键点个数和帧数,设定相对位置集合每个相对位置的表达式为:

7、

8、其中,表示第t帧中鼻尖位置的坐标,ht表示两眼左右内眼角的距离;

9、关键点图表示为:

10、gl=(vl,el)

11、其中,vl=r为结点的几何,边集合描述了每一帧内部结点间的连接。

12、可选地,在本技术的一个实施例中,对关键点图和动作单元图分别进行卷积,包括:

13、将关键点图和动作单元图分别输入到独立的时空图卷积模块中进行图卷积,其中,每个时空卷积模块包含对图的空间结构进行建模的图卷积gcn和建模时序信息的时序卷积tcn,时序卷积tcn以沿时间维度的普通2d卷积操作实现,图卷积gcn的实现过程包括:

14、由节点集合v和边集合e构成的图g=(v,e)的图卷积定义为:

15、

16、其中,a表示可学习的邻接矩阵,a以全一矩阵初始化并在训练中更新,i为单位矩阵,d为度矩阵,d的对角线元素dii是归一化邻接矩阵第i行的和,xin是输入的特征矩阵,w是用于线性变换的可学习权重矩阵,relu表示激活函数,xout是输出的特征矩阵。

17、可选地,在本技术的一个实施例中,基于注意力机制对卷积得到的图结构特征进行增强,包括:

18、通过空间注意力和时间注意力对特征图进行增强,

19、其中,空间注意力以图结构特征为输入,表示为:

20、

21、其中,xout为图结构特征,c′表示空间维度,n表示关键点个数,t表示帧数;

22、通过空间注意力对特征图进行增强,包括:

23、计算每个结点在时间和通道维度上的平均值,并通过全连接层和sigmoid函数计算每个结点的注意力得分,并将其与sin相乘;

24、空间注意力以时序卷积的输出为输入,并计算每一帧在结点和通道维度上的平均值;

25、上述方法还包括:

26、通过残差层对增强的特征图进行处理。

27、可选地,在本技术的一个实施例中,将增强后的每段视频的关键点特征图和面部单元特征图进行融合,得到每段视频的融合特征图,包括:

28、通过交叉注意力获得动作单元特征图在关键点特征图上的投影,并将其与关键点特征相拼接,得到融合特征;

29、基于融合特征构建融合特征图。

30、可选地,在本技术的一个实施例中,基于每段视频的融合特征图得到每段视频的片段级表征,包括:

31、将每段视频的融合特征图通过至少一个堆叠的时空卷积模块,并通过全局平均池化,得到每段视频的片段级表征;

32、基于所有片段级表征建立视频级表征,包括:

33、将所有片段级表征拼接,并利用自注意力捕捉片段间关系,形成视频级表征;

34、对视频级表征进行抑郁障碍识别,得到识别结果,包括:

35、将视频级表征输入到全连接层,输出识别结果,其中,识别结果包括是否具有抑郁倾向及其严重程度。

36、为达上述目的,本发明第二方面实施例提出了一种基于面部视频序列的抑郁障碍识别系统,包括:

37、视频处理模块,用于对视频序列进行分段处理并进行人脸图像检测,获取每段视频中包含的人脸图像的关键点和动作单元;

38、图构建模块,用于对每段视频中包含的人脸图像的关键点和动作单元分别构建图结构,得到每段视频的关键点图和动作单元图;

39、图处理模块,用于对每段视频的关键点图和动作单元图分别进行卷积,并基于注意力机制对卷积得到的图结构特征进行增强,并将增强后的每段视频的关键点特征图和面部单元特征图进行融合,得到每段视频的融合特征图;

40、识别模块,用于基于每段视频的融合特征图得到对应的片段级表征,基于所有片段级表征建立视频级表征,并对视频级表征进行抑郁障碍识别,得到识别结果。

41、可选地,在本技术的一个实施例中,给定关键点序列{cl,n,t}分别表示坐标维度、关键点个数和帧数,设定相对位置集合每个相对位置的表达式为:

42、

43、其中,表示第t帧中鼻尖位置的坐标,ht表示两眼左右内眼角的距离;

44、关键点图表示为:

45、gl=(vl,el)

46、其中,vl=r为结点的几何,边集合描述了每一帧内部结点间的连接。

47、可选地,在本技术的一个实施例中,对关键点图和动作单元图分别进行卷积,包括:

48、将关键点图和动作单元图分别输入到独立的时空图卷积模块中进行图卷积,其中,每个时空卷积模块包含对图的空间结构进行建模的图卷积gcn和建模时序信息的时序卷积tcn,时序卷积tcn以沿时间维度的普通2d卷积操作实现,图卷积gcn的实现过程包括:

49、由节点集合v和边集合e构成的图g=(v,e)的图卷积定义为:

50、

51、其中,a表示可学习的邻接矩阵,a以全一矩阵初始化并在训练中更新,i为单位矩阵,d为度矩阵,d的对角线元素dii是归一化邻接矩阵第i行的和,xin是输入的特征矩阵,w是用于线性变换的可学习权重矩阵,relu表示激活函数,xout是输出的特征矩阵。

52、可选地,在本技术的一个实施例中,基于注意力机制对卷积得到的图结构特征进行增强,包括:

53、通过空间注意力和时间注意力对特征图进行增强,

54、其中,空间注意力以图结构特征为输入,表示为:

55、

56、其中,xout为图结构特征,c′表示空间维度,n表示关键点个数,t表示帧数;

57、通过空间注意力对特征图进行增强,包括:

58、计算每个结点在时间和通道维度上的平均值,并通过全连接层和sigmoid函数计算每个结点的注意力得分,并将其与sin相乘;

59、空间注意力以时序卷积的输出为输入,并计算每一帧在结点和通道维度上的平均值;

60、上述系统还包括残差处理模块,具体用于:

61、通过残差层对增强的特征图进行处理。

62、本技术附加的方面和优点将在下面的描述中部分给出,部分将从下面的描述中变得明显,或通过本技术的实践了解到。

本文地址:https://www.jishuxx.com/zhuanli/20241009/305911.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表