一种联邦学习模型训练方法及装置与流程

- 国知局

- 2024-10-15 09:21:55

本技术涉及机器学习领域,尤其涉及一种联邦学习模型训练方法及装置。

背景技术:

1、联邦学习是一种基于隐私保护的分布式机器学习建模方法。与传统的集中式建模方法相比,联邦学习中的服务器与终端设备可以在不共享数据的前提下,通过共享初始模型的方式在终端设备进行分布式训练,从而生成联邦学习模型。联邦学习能够满足用户隐私法规要求,然而,由于终端设备的数据通常是非独立同分布(non independentidentically distributed,non-iid)的数据,因此联邦学习模型可能会比集中式建模的模型的精度更低,甚至是不收敛。

2、在此基础上,服务器需要在算法工程师的辅助下,与终端设备进行交互,通过反复进行初始模型的模型参数的设置和调整,从而实现前述联邦学习模型的优化。这样的方法需要占用较多终端设备的存储资源和计算资源,无法满足终端设备对应的用户的需求。

技术实现思路

1、本技术实施例提供一种联邦学习模型训练方法及装置,用于构建仿真数据集,使得服务器可以基于仿真数据集进行联邦学习,从而提高联邦学习模型的准确性,减少终端设备的存储资源和计算资源的浪费。

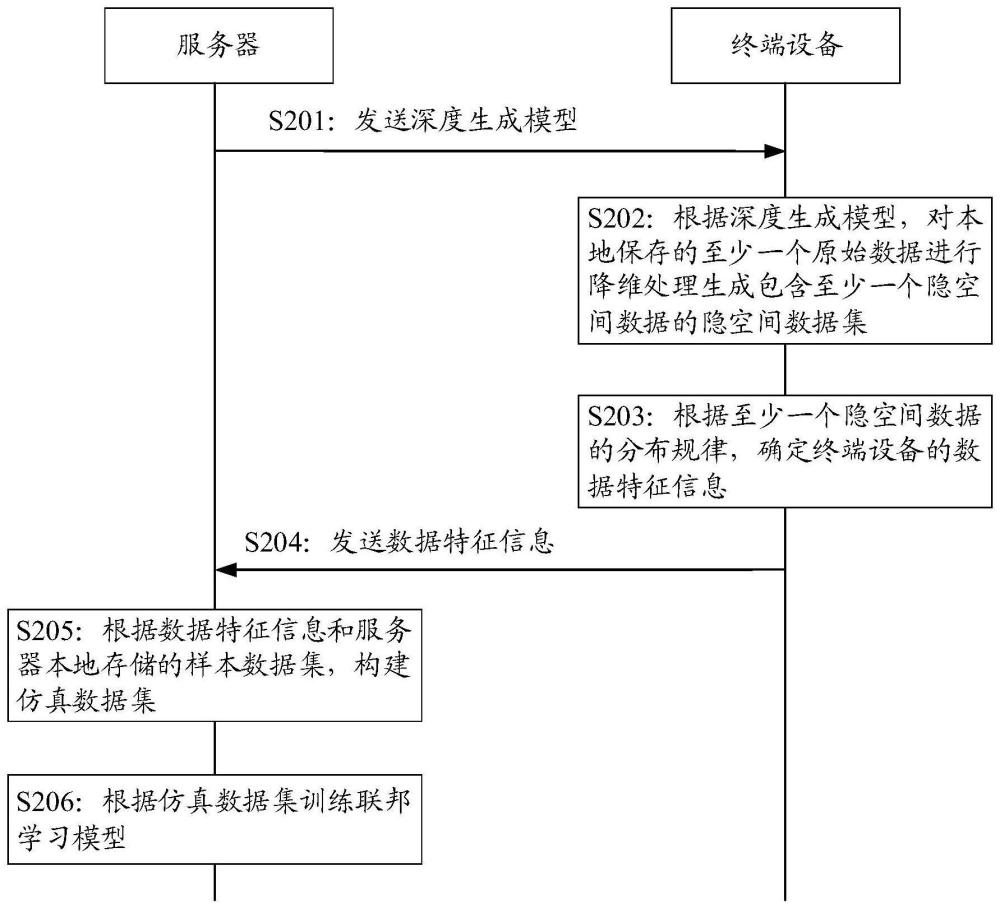

2、第一方面,本技术实施例提供一种联邦学习模型训练方法,该方法包括:服务器向至少一个终端设备发送深度生成模型,深度生成模型用于至少一个终端设备对各自保存的至少一个原始数据进行降维处理生成包含至少一个隐空间数据的隐空间数据集;服务器接收来自至少一个终端设备的数据特征信息;任一个终端设备的数据特征信息用于反映终端设备的隐空间数据集包含的至少一个隐空间数据的分布规律;服务器根据至少一个终端设备的数据特征信息和服务器本地存储的样本数据集,构建仿真数据集;服务器根据仿真数据集训练联邦学习模型。

3、采用该方法,服务器可以在不涉及终端设备的原始数据的前提下,构建满足终端设备的原始数据的数据特征的仿真数据集,以供后续联邦学习模型的训练,从而在保证原始数据隐私性的同时提高联邦学习模型的准确性。

4、在一种可能的设计中,该方法还包括:服务器根据样本数据集,训练生成深度生成模型。

5、采用该设计,由于采集的样本数据集与终端设备的原始数据的内容不相关,也就不会泄露原始数据,提高了数据安全性;同时,由于样本数据集与终端设备的原始数据具有较高相似性,服务器在该样本数据集上训练生成的深度生成模型可以应用到终端设备的原始数据上,并且能够产生较好的性能表现,即能够提高深度生成模型的准确性,从而提高终端设备进行降维处理的准确性,进一步能够提高联邦学习模型确定的准确性。

6、在一种可能的设计中,服务器可以通过以下方法构建仿真数据集:服务器通过深度生成模型对样本数据集中的多个样本数据进行降维处理,确定多个样本数据的隐空间坐标;服务器根据多个样本数据的隐空间坐标和至少一个终端设备的数据特征信息,在多个样本数据中选择该至少一个终端设备的目标样本数据;服务器根据至少一个终端设备的目标样本数据,构建仿真数据集。

7、采用该设计,目标样本数据即为与隐空间数据集的数据特征相似度较高的数据,且由于目标样本数据与原始数据的内容不相关,因此该目标样本数据可以在不涉及终端设备的隐私的前提下,构建满足原始数据的数据特征的仿真数据集,以供后续联邦学习模型的训练,从而提高联邦学习模型的准确性。

8、在一种可能的设计中,至少一个终端设备包括第一终端设备,服务器可以通过以下方法在多个样本数据中选择目标样本数据:服务器根据多个样本数据的隐空间坐标和空间划分规则确定多个样本数据各自所属的网格;其中,空间划分规则用于将第一终端设备的隐空间数据集包含的至少一个隐空间数据所在的坐标空间划分为n个网格;第一终端设备的数据特征信息由n个网格对应的张量组成;n个网格中每个网格对应的张量是根据至少一个隐空间数据的隐空间坐标和数据类别确定的;服务器对n个网格中的每个网格执行以下操作:服务器在多个样本数据中,选择属于第一网格的备选样本数据;服务器根据第一网格的张量和备选样本数据的数据类别,确定第一网格对应的样本数据;第一网格为n个网格中的任一个;服务器将n个网格中每个网络对应的样本数据,作为第一终端设备的目标样本数据。

9、采用该设计,服务器能够根据空间划分规则有效的将隐空间数据集进行量化分割,以使服务器可以基于每个网格的张量确定隐空间数据的相似数据,作为目标样本数据,因此能够在不涉及终端设备的数据隐私的前提下,选择具备与原始数据相似特征的样本数据,从而构建符合原始数据的数据特征的仿真数据集。

10、在一种可能的设计中,属于第一网格的隐空间数据的数量与第一网格对应的样本数据的数量相同。

11、采用该设计,提高了仿真数据集的仿真效果,从而提高了联邦学习算法的准确性。

12、第二方面,本技术实施例提供一种联邦学习模型训练方法,该方法包括:终端设备接收来自服务器的深度生成模型;终端设备根据深度生成模型,对本地保存的至少一个原始数据进行降维处理生成包含至少一个隐空间数据的隐空间数据集;终端设备根据至少一个隐空间数据的分布规律,确定终端设备的数据特征信息;终端设备向服务器发送数据特征信息;数据特征信息用于服务器根据本地存储的样本数据集构建仿真数据集;仿真数据集用于训练联邦学习模型。

13、在一种可能的设计中,深度生成模型是根据样本数据集训练生成的。

14、在一种可能的设计中,终端设备可以通过以下方法确定终端设备的数据特征信息:终端设备根据空间划分规则将至少一个隐空间数据所在的坐标空间划分为n个网格;其中,每个网格对应一个或多个隐空间数据;n为正整数;终端设备根据至少一个隐空间数据的隐空间坐标和数据类别,确定n个网格中每个网格对应的张量;其中,n个网格对应的张量为终端设备的数据特征信息。

15、采用该设计,终端设备能够忽略同一个网格中的隐空间数据之间的差异,根据空间划分规则有效的将隐空间数据集进行量化分割,针对同一个网格仅计算一个张量,降低了隐空间数据集的复杂度,从而降低了服务器的计算开销。

16、第三方面,本技术实施例提供了一种联邦学习模型训练装置,包括用于执行以上第一方面中各个步骤的模块。可选的,联邦学习模型训练装置包括通信模块和处理模块;其中,通信模块,用于接收和发送数据;处理模块,用于基于前述通信模块执行以上第一方面或第二方面提供的方法。示例性的,联邦学习模型训练装置可以应用于前述服务器或终端设备。通信模块与处理模块的具体功能可以参考以上第一方面中的相关描述,此处不再赘述。

17、第四方面,本技术实施例提供了一种联邦学习模型训练设备,包括通信接口,存储器和处理器;其中,通信接口,用于接收和发送数据;存储器,用于存储程序指令和数据;处理器,用于读取存储器中的程序指令和数据,实现以上第一方面或第二方面提供的方法。示例性的,联邦学习模型训练设备可以为前述服务器或终端设备。

18、第五方面,本技术实施例提供了一种联邦学习模型训练设备,包括至少一个处理元件和至少一个存储元件,其中该至少一个存储元件用于存储程序和数据,该至少一个处理元件用于执行本技术以上第一方面或第二方面提供的方法。示例性的,联邦学习模型训练设备可以为前述服务器或终端设备。

19、第六方面,本技术实施例还提供了一种计算机程序,当计算机程序在计算机上运行时,使得计算机执行上述第一方面或第二方面提供的方法。可选的,计算机可以为前述服务器或终端设备;或者为以上联邦学习模型训练装置或联邦学习模型训练设备。

20、第七方面,本技术实施例还提供了一种计算机可读存储介质,该计算机可读存储介质中存储有计算机程序,当计算机程序被计算机执行时,使得计算机执行上述第一方面或第二方面提供的方法。可选的,计算机可以为前述服务器或终端设备;或者为以上联邦学习模型训练装置或联邦学习模型训练设备。

21、第八方面,本技术实施例还提供了一种芯片,芯片用于读取存储器中存储的计算机程序,执行上述第一方面或第二方面提供的方法。可选的,芯片中可以包括处理器和存储器,处理器与存储器耦合,用于读取存储器中存储的计算机程序,实现以上第一方面提供的方法。

22、第九方面,本技术实施例还提供了一种芯片系统,该芯片系统包括处理器,用于支持计算机装置实现上述第一方面或第二方面提供的方法。在一种可能的设计中,芯片系统还包括存储器,存储器用于保存该计算机装置必要的程序和数据。该芯片系统可以由芯片构成,也可以包含芯片和其他分立器件。

23、上述第二方面至第九方面中任一方面可以达到的技术效果可以参照上述第一方面中任一种可能设计可以达到的技术效果说明,重复之处不予论述。

本文地址:https://www.jishuxx.com/zhuanli/20241015/313909.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表