基于双通道视觉信号交互与融合的结构动态位移监测方法

- 国知局

- 2024-11-19 09:59:49

本发明属于结构健康监测,特别涉及一种基于双通道视觉信号交互与融合的结构动态位移监测方法。

背景技术:

1、动态位移监测是结构健康监测的重要组成部分,可为了解土木工程结构的性能和安全性提供重要依据。在早期阶段,主要采用加速度计等接触式传感器来完成监测任务。然而,这些接触式传感器在实际应用中受到很大限制,如测量点稀疏、必须接触被测结构、耗费人力物力等。相比之下,扫描激光多普勒测振仪和全球定位系统等非接触式方法的出现缓解了上述问题。但仍然存在明显的缺点,如测量距离有限、价格昂贵和操作复杂等。

2、近年来,视觉监测方法由于具有灵活性强、效率高和测量空间分辨率高等优点受到了更多的关注。然而,现有方法在面对实际场景下的结构动态监测时,都难以克服自身固有缺陷。如:数字图像相关算法严重依赖于被测结构表面的高质量人工散斑;模板匹配算法仅能提供整像素精度的位移测量,导致测量结果精度难以满足,且存在锯齿现象;光流算法虽然能够提供较为准确的亚像素精度速度测量,但获取动态过程中的积分运算会导致误差累积和严重的运动漂移现象。

技术实现思路

1、为了克服上述现有结构动态位移监测方法的缺点,解决目前单一视觉算法难以克服自身固有缺陷的问题,本发明的目的在于提出一种基于双通道视觉信号交互与融合的结构动态位移监测方法。该方法有效结合了双通道视觉信号,具有测量精度高、噪声鲁棒性好、无需表面人工标记等优势。

2、为了实现上述目的,本发明采用的技术方案是:

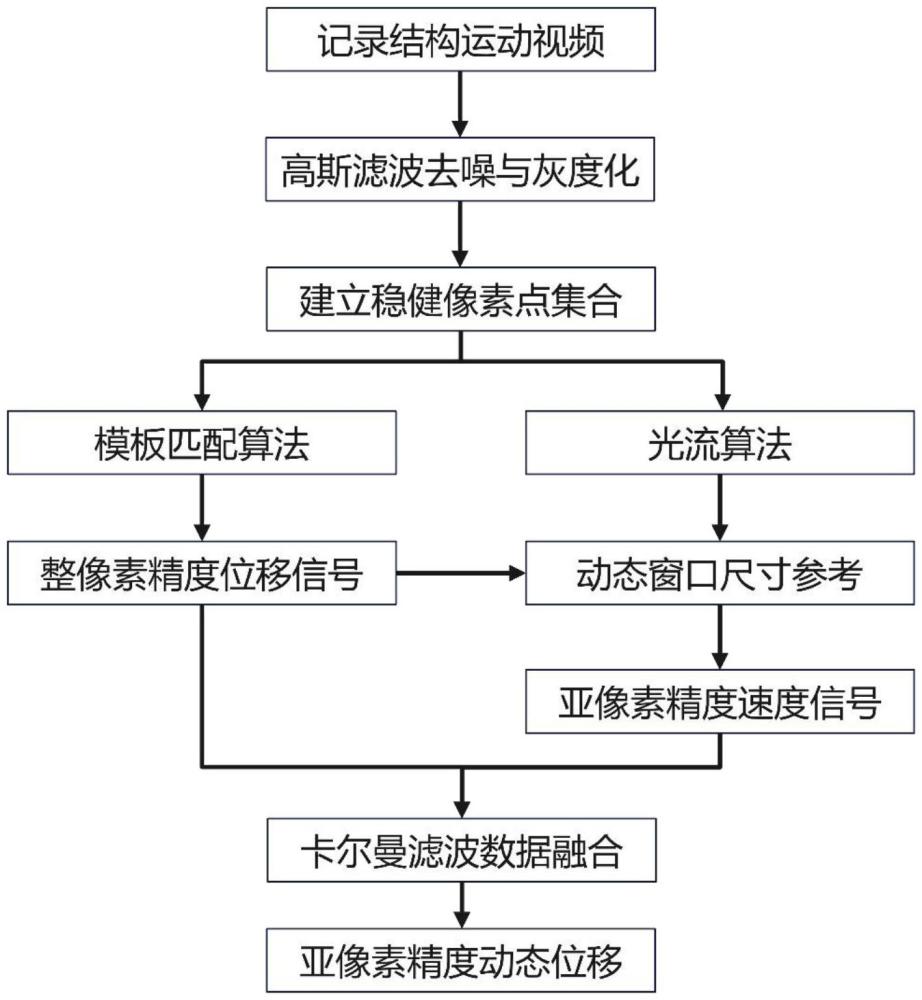

3、一种基于双通道视觉信号交互与融合的结构动态位移监测方法,包括以下步骤:

4、步骤1:采用工业相机实时记录结构的运动视频,并逐帧进行高斯滤波去噪与灰度化处理;

5、步骤2:综合小波幅值筛选和角点响应因子筛选,建立具有测量稳健性的像素点集合,并对监测点进行选择;

6、步骤3:采用模板匹配算法对整像素精度的位移进行测量,作为视觉通道一的位移信号,并将该信号作为动态窗口尺寸参考值与视觉通道二进行交互,采用光流算法对亚像素精度的速度进行测量,作为视觉通道二的速度信号;

7、步骤4:基于卡尔曼滤波算法对视觉通道一的位移信号和视觉通道二的速度信号进行数据融合,从而获取亚像素精度的结构动态位移信号。

8、与现有结构动态位移监测方法相比,本发明的优点体现在:

9、(1)本发明通过建立小波幅值和角点响应筛选准则,对全场像素点的纹理信息和角点特性进行自动化筛选,从而提供了可靠监测点集合,无需在被测结构表面进行人工标记提供监测点。

10、(2)本发明通过对运动视频实施双通道处理并进行信号的交互与融合,有效结合了模板匹配算法和光流算法的优势,能够在保证计算稳定性和抗噪性的同时,提高动态位移监测的精度,克服了单一视觉算法的自身固有缺陷。

11、(3)本发明的实施仅需要工业相机与计算机,所采用的监测系统简单高效,在实际工业应用场景中的适用性好。

技术特征:1.一种基于双通道视觉信号交互与融合的结构动态位移监测方法,其特征在于,包括以下步骤:

2.根据权利要求1所述的基于双通道视觉信号交互与融合的结构动态位移监测方法,其特征在于,所述步骤2中,综合小波幅值筛选和角点响应因子筛选,建立具有测量稳健性的像素点集合,并对监测点进行选择,具体如下:

3.根据权利要求1所述的基于双通道视觉信号交互与融合的结构动态位移监测方法,其特征在于,所述步骤3中,采用模板匹配算法对整像素精度的位移进行测量,作为视觉通道一的位移信号,并将该信号作为动态窗口尺寸参考值与视觉通道二进行交互,采用光流算法对亚像素精度的速度进行测量,作为视觉通道二的速度信号,具体如下:

4.根据权利要求1所述的基于双通道视觉信号交互与融合的结构动态位移监测方法,其特征在于,所述步骤4中,基于卡尔曼滤波算法对视觉通道一的位移信号和视觉通道二的速度信号进行数据融合,从而获取亚像素精度的结构动态位移信号,具体如下:

技术总结本发明公开一种基于双通道视觉信号交互与融合的结构动态位移监测方法,首先,采用工业相机实时记录结构的运动视频,并逐帧进行高斯滤波去噪与灰度化处理;其次,综合小波幅值筛选和角点响应因子筛选,建立具有测量稳健性的像素点集合,并对监测点进行选择;然后,采用模板匹配算法对整像素精度的位移进行测量,作为视觉通道一的位移信号,并将该信号作为动态窗口尺寸参考值与视觉通道二进行交互,采用光流算法对亚像素精度的速度进行测量,作为视觉通道二的速度信号;最后,基于卡尔曼滤波算法对视觉通道一的位移信号和视觉通道二的速度信号进行数据融合,从而获取亚像素精度的结构动态位移信号。本发明有效结合了双通道视觉信号的优势,能够实现高精度的非接触式结构动态位移监测,且无需在结构表面喷洒人工标记,实用性好。技术研发人员:张一鸣,徐自力,李广受保护的技术使用者:西安交通大学技术研发日:技术公布日:2024/11/14本文地址:https://www.jishuxx.com/zhuanli/20241118/331030.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。