一种基于Transformer变体的工业缺陷检测方法

- 国知局

- 2024-11-21 11:37:26

本发明属于缺陷检测,具体涉及一种基于transformer变体的工业缺陷检测方法。

背景技术:

1、随着中国制造业的快速发展,工业产品的数量和种类与日俱增,同时消费者与企业对产品质量要求的更高,工业缺陷检测成为了确保产品质量、提升市场竞争力的关键环节。

2、近年来,由于深度学习技术的快速发展,尤其是卷积神经网络(cnn)在图像处理领域的突破,为工业缺陷检测提供了新的思路和工具。基于cnn的目标检测技术已经在多个领域展现出了卓越的性能,但面对工业场景下的特殊需求,如实时性、复杂环境下的鲁棒性、以及对多样化缺陷类型的识别能力等,现有技术仍存在一定的局限性,难以达到实际应用的需求。

3、目前transformer在计算机视觉领域展现了的出色表现,使得越来越多的研究者开始探索将这一技术用于工业缺陷检测。vision transformer通过将图像分割成多个小块(patches),并利用自注意力机制捕捉全局上下文信息,已经在多个视觉任务中显示出了与传统的卷积神经网络(cnn)相媲美甚至更优的性能。

4、然而,在工业缺陷检测中,传统cnn模型存在局部特征提取不足和难以建模长距离依赖关系的缺点。另一方面,使用transformer模型则面临计算复杂度高和参数数量庞大的问题,影响实时性和部署效率。

技术实现思路

1、针对上述问题,本发明提出一种基于transformer变体的工业缺陷检测方法,该方法利用swin transformer作为一种新型的深度学习模型,它结合了transformer架构的优势和卷积神经网络的特点,能够有效地捕捉图像中的全局和局部特征,提高缺陷检测的准确性和鲁棒性,旨在克服现有技术的局限性,满足工业场景下,对工业产品缺陷检测的准确性与实时性。

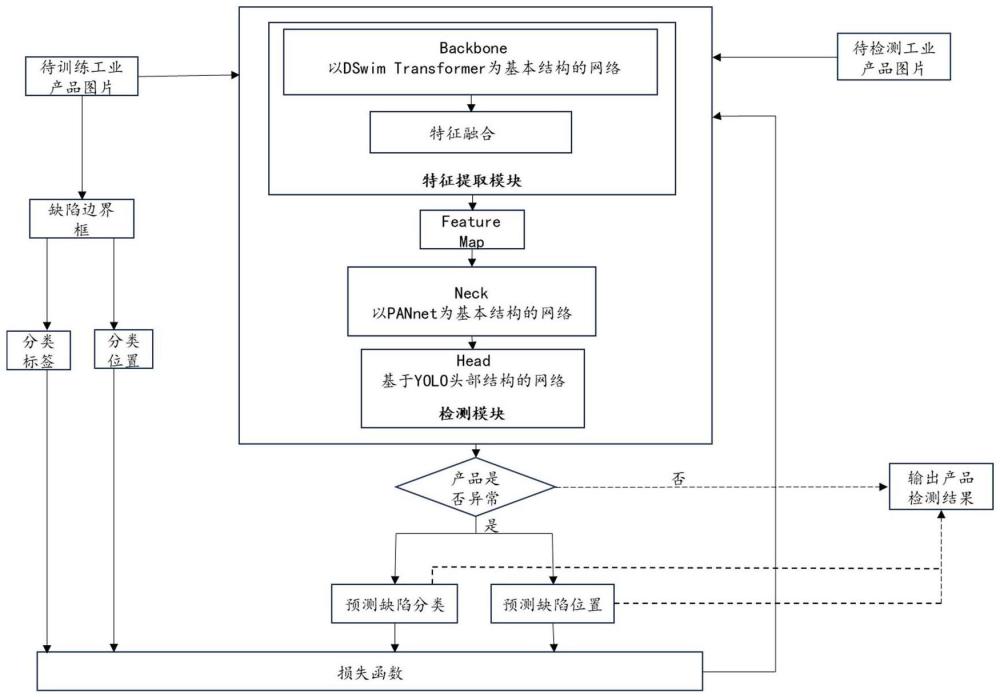

2、本发明采用的技术方案是:一种基于transformer变体的工业缺陷检测方法,该方法包括如下步骤:

3、步骤s1:获取工业产品图像,包括无损图像或缺陷图像,进行各类缺陷标注,建立标准数据集;

4、步骤s2:将上述数据集进行预处理,按比例划分;

5、步骤s3:构建基于transformer变体的骨干网络,并基于所述的网络构建工业缺陷检测网络模型,对所述工业缺陷检测网络模型进行训练优化;

6、步骤s4:获取待检测工业产品的图像,将所述待检测工业产品图像进行预处理后输入所述训练好的工业缺陷检测网络模型中进行检测;

7、步骤s5:根据所述工业缺陷检测网络模型的输出,确定待检测工业产品是否存在缺陷,缺陷类型集及缺陷位置。

8、步骤s1中,使用工业相机对工业产品表面进行拍摄,捕获不同角度和光照条件下的工业产品表面无损和缺陷图像;并分类型标签为无损图像、缺陷图像和缺陷类型,以及对图像中的缺陷部分用边界框进行标注,得到标准数据集。

9、步骤s2中,对数据集进行预处理包括:随机将所有图像分组,采用数据增强方法扩增数据集;按照比例划分为训练集,验证集和测试集;所述训练集用于迭代训练模型,验证集用于验证模型精度和测试集用于测试。

10、步骤s3中,构建基于transformer变体的工业缺陷检测网络模型包括如下步骤:

11、步骤s31:构建基于transformer变体的骨干网络,该网络基于u型的dswimtransformer网络模型,使用u型对称编码-解码器结构网络,同时添加跳跃连接;

12、步骤s32:基于构建transformer变体的骨干网络、pan颈部网络和yolo检测头,构建端到端的基于transformer变体的工业缺陷检测模型;所述transformer变体的骨干网络用于提取深层图像特征;所述pan颈部网络从低分辨率特征图向上逐级采样,从高分辨率特征图向下逐级采样,并连接;采样过程中融合相邻层特征并级联,用于避免信息损失、提高检测精度;所述yolo检测头,用于输出每个候选框的位置信息和对应的目标类别,实现目标的准确检测和分类;

13、步骤s33:定义损失函数和训练参数,对模型进行迭代训练以及优化,保存预训练模型。

14、步骤s31中,u型的dswim transformer网络模型包括编码器模块、瓶颈阶段、解码器模块、跳跃连接;其中,所述的编码器模块和解码器模块呈u型对称结构;

15、所述的编码器模块具体包括以下三个步骤stage:

16、stage1,卷积嵌入层:基于卷积嵌入模块构建卷积嵌入层,用于提取图像中的patch特征,并将预处理后的待检测工业产品图像投影到所需维度c,得到的第一特征图像;

17、stage2,采样层:包括2个dswim transformer block层和一个attention patchmerging层;dswim transformer block层用于进行局部特征与全局的特征的学习;attention patch merging层用于下采样,降低图像分辨率,同时将通道维度扩大为原来的两倍,得到第二特征图像;

18、stage3,再次重复步骤stage2三次,分别得到第三特征图、第四特征图、第五特征图;

19、上述的五个特征图均为浅层特征图;

20、所述的瓶颈阶段包括2个dswim transformer block层,用于对第五特征图进行深层特征信息学习,得到第六特征图,为深层特征图;

21、所述的解码器具体包括以下3个步骤stage:

22、stage1,采样层:包括2个dswim transformer block层和一个attention patchexpanding层;dswim transformer block层用于进行局部特征与全局的特征的学习;attention patch expanding层用于上采样,提高图像分辨率,将第六特征图像的分辨率还原为第五特征图分辨率,得到第七特征图;

23、stage2,重复stage1所述采样层3次,分别得到第八特征图、第九特征图、第十特征图;

24、stage3,attention patch expanding层:用于将第十特征图的通道数转换为所需通道数,得到第十一特征图;

25、上述的五个特征图均为深层特征图;

26、所述的跳跃连接模块位于编码器模块与解码器模块之间,用于对所提取的浅层特征信息和深层特征信息进行融合,得到融合后的特征信息。

27、所述的dswim transformer block层,在mlp中添加卷积运算,设计depth mlp模块,用于有效结合cnn和swin transformer的能力,提高模型的表示能力;

28、基于depth mlp模块,构建的dswim transformer模块由两个dswim transformerblock组成,其公式如下表示:

29、in+1=dmlp(ln(wmsa(ln(in))+in))+wmsa(ln(in))+in)

30、in+2=dmlp(ln(swmsa(ln(in+1))+in+1))+swmsa(ln(in+1))+in+1)

31、其中,in表示输入的特征图,in+1表示经过第一个dswin

32、transformer block后的特征图,in+2表示经过连续两个dswin

33、transformer block后的特征图,ln表示为层归一化操作,wmsa表示为基于窗口的多头自注意力,swmsa表示为移位窗口的多头自注意力,dmlp表示为depth mlp模块。

34、所述的attention patch merging模块,包括如下具体步骤stage:

35、stage1,第一次卷积操作:对输入特征图进行卷积操作,通过卷积操作将特征图的通道数扩展为原来的4倍,分辨率减少为原来的1/2;

36、stage2,通道注意力机制模块:通过se模块加强特征图的通道注意力,在通道维度上进行加权以突出重要特征,特征图分辨率与通道数保持不变;

37、stage3,第二次卷积和最大池化操作:对输入的原始特征图再进行一次卷积操作,然后进行最大池化,将其尺寸变为与se模块增强后的特征图一致,将其与将se模块增强后的特征图相加叠加;

38、stage4,第三次卷积:将叠加后的特征图,通过卷积操作,使其通道数降为stage1中特征图的1/2,即输入的原始特征图的2倍;

39、上述四个阶段公式表示如下:

40、x=ln(conv(δ(se(conv(x))+maxpool(conv(x)))))

41、其中,se表示通道注意senet,δ表示sigmoid激活函数,ln表示层归一化。

42、attention patch expanding模块,包括如下具体步骤stage:

43、stage1,第一次卷积操作:对输入特征图进行卷积操作,通过卷积操作将特征图的通道数扩展为原来的4倍,分辨率不改变,使其在更高维度的特征空间中学习和表达更多的信息;

44、stage2,通道注意力机制模块:利用senet增强不同通道之间的信息,在通道维度上进行加权以突出重要特征;

45、stage3,对通过stage2增强的特征图进行反卷积操作,将特征图的分辨率扩大为原来的2倍,通道数减为stage1特征图的1/4,即原始特征图的通道数;

46、stage4,对原始特征图进行卷积操作,将其分辨率扩大为原来的2倍,通道位数不变;将得到的特征图与stage3中得到的特征图进行加法叠加,进行特征融合,并使用sigmoid激活函数激活;

47、stage5,卷积和层归一化,通过卷积操作将通道数减少一半,对进行卷积后的特征图进行层归一化,最终得到分辨率为原来2倍,通道数为原来1/2的特征图;

48、上述五个阶段公式表示如下:

49、x=ln(conv(δ(deconv(se(conv(x)))+conv(x))))

50、其中,se表示通道注意senet,δ表示relu激活函数,ln表示层归一化,deconv表示为转置卷积。

51、一种基于transformer变体的工业缺陷检测装置,包括:设于工业生产环境的图像采集设备、云端服务器、上位机;

52、图像采集设备,包括工业相机和光源;所述工业相机视野朝向被测工件,用于拍摄工件表面无损图像或缺陷图像上传给云端服务器;光源用于辅助调节拍摄光线;

53、云端服务器,设有存储器和处理器,存储器中存储有程序,用于实时或定时接收上传的工业图像,按照如上所述的方法步骤进行训练,实时或定时优化检测模型;

54、上位机,设有界面前端和控制后台;界面前端用于人机交互和可视化显示检测结果;控制后台根据用户指令下达命令,控制设于工业生产环境的工业相机采集工业图像、控制云端服务器训练优化模型,以及调用训练完毕的模型对实时采集的工业图像进行检测,输出检测结果;所述检测结果为判断是否为无损图像或缺陷图像,并显示缺陷类型和位置回归框。

55、本发明具有以下有益效果及优点:

56、1、本发明提出的一种基于transformer变体的工业缺陷检测算法,利用swintransformer处理全局上下文的能力,同时在swin transformer block中的mlp添加深度可分离卷积运算,提取局部特征,结合全局和局部特征,有效提取图像的重要信息,提高检测精度。

57、2、本发明在patch merging层和patch expanding层添加注意力机制,使其能够灵活选择和聚合重要特征,进行动态的特征选择,注意力机制自适应调整不同尺度特征的权重,有效融合多尺度信息,提升检测不同大小缺陷的能力,同时减少信息丢失,提高检测精度。

58、3、本发明利用u型架构通过编码器-解码器结构提取和融合多尺度特征,增强对不同尺寸缺陷的检测能力,利用pan作为颈部网络能够高效融合不同层次的特征,提升对复杂背景下对小目标的检测能力,同时结合yolo head的单阶段检测方法,具备实时处理图像的能力,能够高效应对各种工业场景下的缺陷检测需求。

本文地址:https://www.jishuxx.com/zhuanli/20241120/332072.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表