时序图表示学习方法、装置、电子设备及可读存储介质

- 国知局

- 2024-07-31 22:39:34

本发明属于一种时序图表示学习方法,具体是涉及到一种时序图表示学习方法、装置、电子设备及可读存储介质。

背景技术:

1、时序图表示学习在机器学习领域越来越受欢迎,因为它在许多实际应用中具有巨大潜力。时序图模型需要捕捉图的演化模式,并学习每个节点在特定时间点的表示,其质量将通过节点/边属性预测任务的性能来评判。根据图的构造方式,现有的动态网络表示学习研究可分为离散时间方法和连续时间方法两大类。离散时间方法将时间图视为一系列随时间变化的图快照,并采用静态图技术作为主干。然而,这些方法容易受到不合适观测频率的影响,并且难以对细粒度的节点交互进行建模。连续时间方法使用带有时间戳的事件列表来对图进行建模,其中事件表示节点和边的出现或消失。

2、现有的连续时间方法致力于设计先进的神经结构来编码节点之间的历史交互,研究可根据其关注的行为模式进行划分。最初的方法旨在获取节点的长期行为模式,该模式通过循环神经网络将节点的历史交互嵌入为记忆向量。此外,随着图神经网络的兴起,部分研究提出利用图机制来学习邻域信息,从而能够捕获节点所展示的空间行为模式。此外,部分方法侧重于学习短期行为模式,其只集成最近的邻居信息来表示节点当前的进化偏好。虽然这些方法已经显示出令人满意的结果,但它们仍然有一些局限性。

3、例如,在如图1所示的社交网络动态图实例中,节点v1表示一个用户在很长一段时间内与他们的朋友保持定期联系。在可预见的将来,该用户极有可能继续表现出长期的行为偏好,例如联系节点v2。相反,像节点v3这样经常改变社交关系的用户更倾向于与新认识的人互动。此外,对于接触对象和记录有限的用户(如节点v4),其社交圈相对狭窄,其接触的对象很可能是其现有朋友的熟人。

4、由此可知,图中的不同节点可能表现出不同的演化偏好,然而现有的时序图表示学习方法大多集中在单一行为模式建模上,这导致最终得到的节点表征结果准确度较差。

技术实现思路

1、本发明要解决的技术问题是现有的时序图表示学习方法大多集中在单一行为模式建模上,这导致最终得到的节点表征结果准确度较差,为了解决上述问题,本发明提供一种时序图表示学习方法、装置、电子设备及可读存储介质。

2、本发明的内容包括:

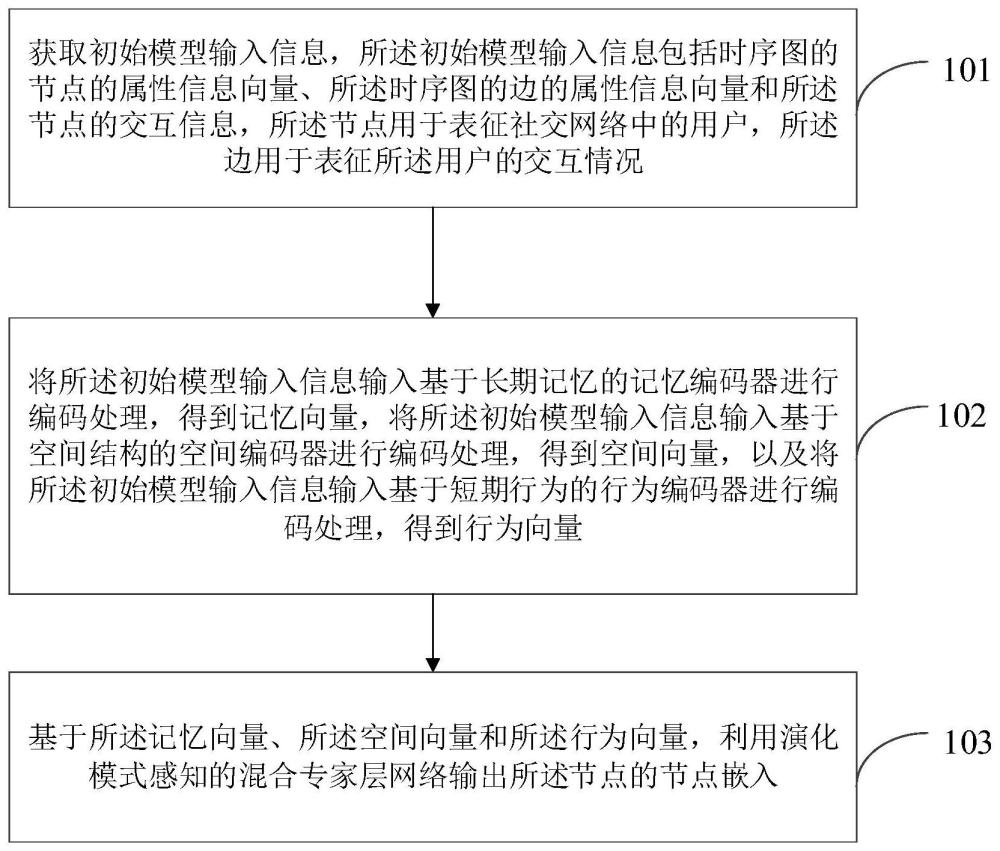

3、第一方面,本发明实施例提供了一种时序图表示学习方法,包括:

4、获取初始模型输入信息,所述初始模型输入信息包括时序图的节点的属性信息向量、所述时序图的边的属性信息向量和所述节点的交互信息,所述节点用于表征社交网络中的用户,所述边用于表征所述用户的交互情况;

5、将所述初始模型输入信息输入基于长期记忆的记忆编码器进行编码处理,得到记忆向量,将所述初始模型输入信息输入基于空间结构的空间编码器进行编码处理,得到空间向量,以及将所述初始模型输入信息输入基于短期行为的行为编码器进行编码处理,得到行为向量;

6、基于所述记忆向量、所述空间向量和所述行为向量,利用演化模式感知的混合专家层网络输出所述节点的节点嵌入。

7、可选地,所述将所述初始模型输入信息输入基于长期记忆的记忆编码器进行编码处理,得到记忆向量,包括:

8、为所述时序图的节点计算对应的消息向量,对于任一个节点i,所述消息向量mi,j(t),mj,i(t)满足:

9、

10、

11、其中,符号||表示拼接操作,si(t-)和sj(t-)分别是时间t之前节点i和节点j的最新记忆向量,是节点i和j在t时刻边的属性向量,φ(·)是一个不可训练的时间函数,用于将时间间隔嵌入到d维向量中;

12、将所述节点的所述消息向量进行合并,得到消息信息,对于节点i,所述消息信息mi(t)满足:

13、

14、其中,mean()表示平均池化操作,表示当前批次中节点i的交互对象集合;

15、使用共享的gru网络,通过引入所述消息信息计算得到所述节点的所述记忆向量,对于任一个节点i,所述记忆向量si(t)满足:

16、si(t)=gru(si(t-),mi(t))。

17、可选地,所述将所述初始模型输入信息输入基于空间结构的空间编码器进行编码处理,得到空间向量,包括:

18、将所述节点的记忆向量、所述节点的属性信息向量、所述边的记忆向量和所述边的属性信息向量输入所述空间编码器进行编码,得到所述空间向量,所述空间编码器采用tgat作为基本编码器,对于任一个节点i,所述空间向量zi(t)满足;

19、

20、其中,表示0到t时间内节点i的时态邻居集合,k是邻居节点的跳数,表示节点i对应的属性信息向量,表示节点j对应的属性信息向量,表示节点i和j边对应的属性信息向量。

21、可选地,所述将所述节点的记忆向量、所述节点的属性信息向量、所述边的记忆向量和所述边的属性信息向量输入所述空间编码器进行编码,得到所述空间向量之后,所述方法还包括:

22、通过自适应度量器将度信息注入到所述节点的空间向量中,更新所述空间向量,对于任一个节点i,更新后的所述记忆向量zi(t)满足:

23、

24、其中,di是节点i的度,γ1、γ2是可学习的权重,⊙表示逐元素相乘的运算,表示所述tgat模型的第l层的输入。

25、可选地,所述将所述初始模型输入信息输入基于短期行为的行为编码器进行编码处理,得到行为向量,包括:

26、构建所述节点在时间t处的临时消息矩阵,对于任一个节点i,所述临时消息矩阵hi(t)满足:

27、

28、将所述临时消息矩阵输入到1层mlp-mixer中,提取标记级别和通道级别的特征,对于任一个节点i,所述标记级别和通道级别的特征满足:

29、

30、

31、其中,layernorm表示层归一化操作,是用于行嵌入和列嵌入融合的权重矩阵;

32、对行进行平均池化操作,得到所述行为向量,对于任一个节点i,所述行为向量bi(t)满足:

33、

34、可选地,所述基于所述记忆向量、所述空间向量和所述行为向量,利用演化模式感知的混合专家层网络输出所述节点的节点嵌入,包括:

35、基于所述记忆向量、所述空间向量和所述行为向量生成节点的时序动态特征向量,对于任一个节点i,所述时序动态特征向量xi(t)满足:

36、

37、其中,是哈达玛积,用于进行逐元素乘法;

38、将所述时序动态特征向量与所述节点的初始静态特征向量相结合,利用基于softmax的路由机制计算专家的概率分布gi(t):

39、

40、其中,wg,wm是权重矩阵,keeptopk表示基于top-k启发式算法,可以输出前k个值,并将其余值设置为-∞;

41、通过对来自不同图编码器的时态表示进行加权,计算节点嵌入,对于任一个节点i,所述节点嵌入χi(t)满足:

42、

43、其中,η是编码器的总数量,χi是节点i对应于各自的编码器的相关输入,所述编码器包括所述记忆编码器、空间编码器和所述行为编码器。

44、可选地,所述方法还包括:

45、利用链接预测作为监督任务对时态图模型进行迭代训练,所述时态图模型包括所述记忆编码器、所述空间编码器、所述行为编码器和所述演化模式感知的混合专家层网络;

46、其中,所述迭代训练的损失函数包括二元交叉熵损失、重要性损失和加载损失;

47、所述二元交叉熵损失满足:

48、

49、其中,pij(t0)是使用基于mlp的链接解码器计算得到的节点i和节点j之间存在链接的概率,yij(t0)是实际的真实值;

50、所述重要性损失满足:

51、

52、

53、其中,lmp(x)为专家的重要值集合,mean和std分别为平均值和标准差;

54、所述加载损失满足:

55、

56、

57、其中,load(x)为专家的加载值集合,px[i]是专家i被样本x选中的概率。

58、第二方面,本发明实施例提供了一种时序图表示学习装置,包括:

59、获取模块,用于获取初始模型输入信息,所述初始模型输入信息包括时序图的节点的属性信息向量、所述时序图的边的属性信息向量和所述节点的交互信息,所述节点用于表征社交网络中的用户,所述边用于表征所述用户的交互情况;

60、处理模块,用于将所述初始模型输入信息输入基于长期记忆的记忆编码器进行编码处理,得到记忆向量,将所述初始模型输入信息输入基于空间结构的空间编码器进行编码处理,得到空间向量,以及将所述初始模型输入信息输入基于短期行为的行为编码器进行编码处理,得到行为向量;

61、输出模块,用于基于所述记忆向量、所述空间向量和所述行为向量,利用演化模式感知的混合专家层网络输出所述节点的节点嵌入。

62、第三方面,本发明实施例提供一种电子设备,包括:存储器、处理器及存储在所述存储器上并可在所述处理器上运行的程序;所述处理器,用于读取存储器中的程序实现如第一方面所述的时序图表示学习方法中的步骤。

63、第四方面,本发明实施例提供一种可读存储介质,用于存储程序,所述程序被处理器执行时实现如第一方面所述的时序图表示学习方法中的步骤。

64、在本发明实施例中,提出了一种新的框架用于时序图表示学习,称为演化模式感知的混合专家方法(ep-moe),它由具有不同架构的多个专家网络组成。本实施例中采用基于门控循环单元的专家来编码节点的长期记忆信息,采用基于时序图注意力单元的专家来捕获高阶邻域特征,以及采用基于多层感知器的专家来编码短期行为信息。对于每个节点,使用特定模式的专家来学习它们的表示,从而提高输出的节点嵌入的准确度。

本文地址:https://www.jishuxx.com/zhuanli/20240730/194042.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表