面向遥感图像的跨语言描述生成方法

- 国知局

- 2024-10-09 15:20:58

本发明属于自然语言处理,具体涉及一种面向遥感图像的跨语言描述生成方法。

背景技术:

1、图像描述生成是一个涵盖计算机视觉、自然语言处理和深度学习的跨模态任务,目的是识别给定图像的语义信息,图像语义信息通常包括图像中的物体,物体属性,以及各物体间的从属关系,并通过结合计算机视觉、自然语言处理技术生成描述性文本。遥感图像是指包含卫星、飞机、无人机等从高空捕获的地理信息的图像。遥感图像描述生成是上述两个概念的组合,即为遥感图像生成自然语言文本描述,描述遥感图像中的场景和地面对象,以及它们的属性和关系。这一研究方向在应用方面具有非常高的潜力,例如为无人机在战争、侦察、交通指挥和救援场景中拍摄的照片生成实时文本或语音描述,还可以为地表环境变化,森林草地覆盖监测提供参考性文本描述。

2、虽然自然图像描述生成研究中的许多方法可以应用于遥感图像描述生成研究,但该领域需要解决一些独特的挑战。从天空的角度拍摄的遥感图像没有固定的观看方向,图像旋转后也不会影响图片内容的观看,这种现象被称作遥感图像的旋转模糊性;遥感图像中物体的尺度变化很大,导致同一物体在不同的图像中具有完全不同的尺寸和外观,比如一片绿色的植被,如果图像占比较小,则可能是草坪,如果图像占比较大,则可能是草原,这种现象被称作遥感图像的尺寸模糊性;一张遥感图像中可能会包含许多的复杂的内容,比如机场附近的场景可能包含标记线,汽车,航站楼和飞机等目标,不能简单地使用飞机场来描述该图像中的内容。

3、常见的遥感图像描述生成方法遵循编码器-解码器架构,编码器提取图像特征,解码器建立图像特征与文本的关系,生成文本描述。wang等人在文献“wang q,huang w,zhangx,et al.word-sentence framework for remote sensing image captioning[j].ieeetransactions on geoscience and remote sensing,2021:10532-10543.”提出了一个单词-句子框架,包括一个单词提取器和一个句子生成器,以提高遥感图像描述生成方法的可解释性。sumbul g等人在文献“sumbul g,nayak s,demir b.sd-rsic:summarization-driven deep remote sensing image captioning[j].ieee transactions ongeoscience and remote sensing,2021:6922-6934.”提出了一种新的摘要驱动的遥感图像描述生成方法,首先预训练指针生成器网络进行总结,然后将标准文本与摘要文本相结合以生成图像的全面描述。li等人在文献“li y,zhang x,gu j,et al.recurrentattention and semantic gate for remote sensing image captioning[j].ieeetransactions on geoscience and remote sensing,2022:1-16.”提出了一种循环注意机制,将输入图像编码为上下文感知的特征表示。

4、这些研究中使用的数据集都是使用英文描述的,导致算法无法生成中文描述,限制了遥感图像描述生成算法在国内的应用。并且中文和英文在语言结构、文字形式、语法规则等方面存在明显的差异。中文中词序的灵活性较高,而英文中词序对语义影响较大,中文中没有明确的词形变化来表示时态、数或性别,在英文标注中,同一个单词的单复数形式会表达出不同的语义信息,比如“building”描述房屋,楼房等目标信息,而“buildings”则描述居民区,住宅区等场景信息。可以利用上述差异作为补充信息,从而提高算法性能。虽然可以使用翻译软件将英文描述翻译为中文描述,或者将模型输出的英文结果再翻译中文,这两种方法在实践过程中经常会出现多义词和语法结构导致的歧义甚至错误的现象。

技术实现思路

1、为了克服现有技术的不足,本发明提供了一种面向遥感图像的跨语言描述生成方法,将英文遥感数据集和中文遥感数据集同时输入,利用中文和英文的差异化表示进行联合训练,从而提高遥感图像描述生成的准确性。同时,利用英文数据集和中文数据集联合训练,模型可以同时生成英文描述和中文描述,满足实际应用需求。本发明根据模型的当前输出和经验知识引导模型关注视觉特征重要区域,从而有效提高了图像描述的准确性。

2、本发明解决其技术问题所采用的技术方案如下:

3、步骤1:中文数据集构建;

4、获取公开的具有英文文本描述的遥感图像数据集,将英文描述作为参考,对其中的遥感图像按照中文标注的要求进行人工标注;

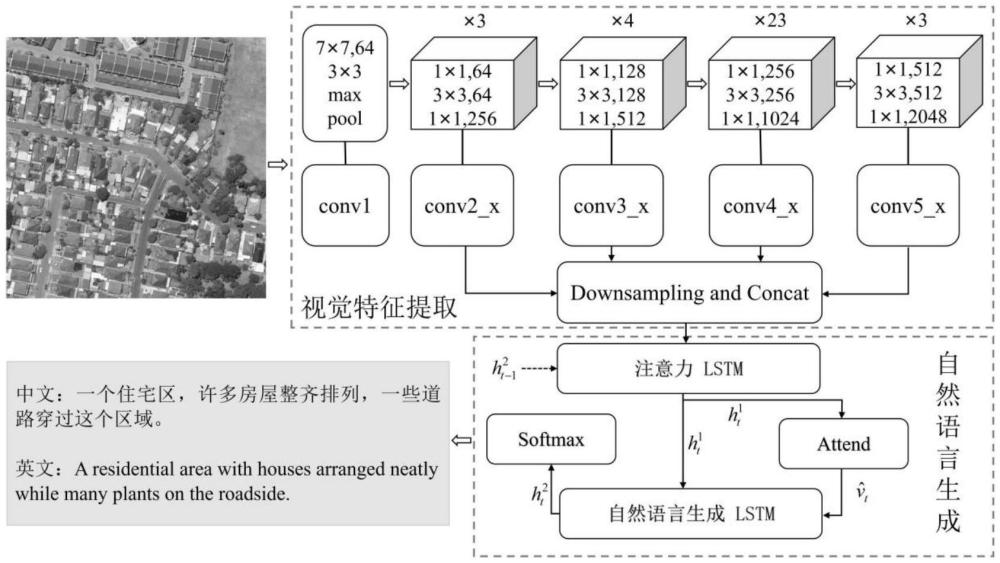

5、步骤2:视觉特征提取;

6、使用在imagenet数据集上预训练的卷积神经网络提取遥感图像视觉特征;

7、步骤3:自然语言解码;

8、通过双层循环神经网络建立遥感图像视觉特征与文本特征之间的映射并解码,并在该过程中引入注意力机制;

9、首先,将每个视觉特征进行加权输入到初始状态中,使用模型现有经验和知识引导注意力的分配,根据注意力判断信息的重要性,并优先处理重要性高的信息;随后,在每个时间步,模型生成一个概率分布,用来表示当前时间步下一个生成的单词或者单词序列;生成过程会迭代进行,直至生成一个特殊的结束符号或者达到预设的最大生成长度。

10、优选地,所述步骤1中,在进行人工标注时:

11、1)明确遥感图像中目标,场景及从属关系等信息,在进行标注时确保这些信息包含在标注文本中;

12、2)标注文本符合书面用语习惯,保证中文描述文本成分的完整性,避免倒装、成分省略发生;

13、3)避免冗余;

14、4)确保使用词汇准确、统一和规范化;

15、5)一个描述文本至少需要包含六个字词;

16、6)对标注完成的文本进行检查和修正。

17、优选地,所述步骤2具体为:

18、步骤2-1:去除预训练的卷积神经网络最后的平均池化层和全连接层;

19、步骤2-2:冻结预训练模型的前三阶段的全部参数,后两阶段的参数在训练过程中进行微调学习;

20、步骤2-3:获取编码器e中不同阶段的遥感图像特征vn进行融合,得到具有全局和局部语义信息的视觉融合特征v;

21、给定一张遥感图像输入i∈c×h×w,利用预训练的编码器e提取不同尺度的遥感图像视觉特征vn:

22、vn=en(i,wfine-tune,wfrozen)

23、其中,n表示编码器的阶段,wfine-tune是编码器中需要微调的参数,由梯度下降算法更新,wfrozen是编码器中冻结的参数,在训练过程中不会更新;编码器e由多个阶段组成,每个层由数量不等的残差块构成,每个残差块由卷积层和跳跃连接构成;

24、得到不同尺度的视觉特征vn后,将特征进行融合,为了满足模型维度要求,需要对得到的特征进行下采样,再将采样后的特征融合:

25、

26、其中,downsampling是下采样操作,concat表示张量拼接操作。

27、优选地,所述步骤3具体为:

28、对于步骤2提取到的视觉融合特征v,利用双层lstm解码器将其解码为遥感图像的英文和中文自然语言描述;

29、步骤3-1:对英文和中文文本标注进行处理,生成词汇表σ,使用one-hot编码方式对文本进行编码;在第一层lstm中引入注意力机制,将第二层lstm的前一时间步的隐藏状态图像融合特征v和先前生成的文本的编码向量连接后作为第一层lstm的输入,计算注意力权重,计算方式如下:

30、

31、αt=softmax(at)

32、其中we∈re×|σ|是词汇表σ的词嵌入,∏t是时刻t输入词的one-hot编码。wva∈rh×v,wha∈rh×m和ωa是可学习参数。

33、步骤3-2:根据注意力权重计算注意力特征将与连接后输入到第二层lstm中进行解码,使用符号y1:t来代表词元序列(y1,y2,…,yt),在每个时刻t,可能输出词元的条件概率分布由下式给出:

34、

35、其中wp∈r|∑|×m和bp∈r|∑|是可学习的参数和偏置项;

36、步骤3-3:给定一个目标真实标签序列和一个参数为θ的图像描述生成模型,训练过程中最小化以下交叉熵损失函数:

37、

38、其中,表示真实标签序列中的第t个标签,表示前t-1个标签序列,t表示真实标签的长度,p0表示以为条件,预测结果为的条件概率。

39、本发明的有益效果如下:

40、本发明提出的遥感图像跨语言描述生成方法充分利用了预训练的卷积神经网络提取的浅层特征和深层特征的特点,进而提升了模型对遥感图像的描述生成的质量。利用中文数据集和英文数据集进行联合训练,两者的差异化信息可以为模型提供更丰富的语义信息,在编码器中引入注意力机制,根据模型的当前输出和经验知识引导模型关注视觉特征重要区域,从而有效提高了图像描述的准确性。

本文地址:https://www.jishuxx.com/zhuanli/20241009/308447.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表