基于联邦图神经网络的虚假评论检测模型训练方法、检测方法及设备

- 国知局

- 2024-10-21 14:56:41

本发明涉及虚假评论检测,尤其涉及一种基于联邦图神经网络的虚假评论检测模型训练方法、检测方法及设备。

背景技术:

1、虚假评论检测就是判断一条评论真实与虚假的可能性。目前,常用的虚假评论检测算法主要有基于语言特征与行为特征的虚假评论检测算法、基于表示学习的虚假评论检测算法和基于图结构的虚假评论检测算法三类。相应的,现有的虚假评论检测技术方案有bert模型、deepwalk、fedgars等。

2、bert模型中,为了获得包含文本上下文语义信息的词向量以及文本特征,bert模型预先通过大量无标签的数据集预训练一个网络模型,通过“双向transformer”的方式来实现双向连接。但由于不同的数据集会有不同的稀疏程度,bert模型在模型训练前对数据的预处理会比较耗时,同时,数据集涉及的领域、文本的表述以及评论关注的重点也会对模型的检测效果产生较大影响。

3、deepwalk的核心思想是将随机游走和skip-gram模型结合来学习网络节点表示,通过随机游走得到节点的序列之后,将其输入到word2vec算法中的skip-gram模型中,采用随机梯度和反向传播进行优化,最终得到网络中节点的向量表示,并最终应用到下游的虚假评论检测任务中。但deepwalk对于复杂数据关系的处理能力和对异质信息的平衡能力有限。

4、fedgars首先为每个评论者提取内容和行为特征,然后利用欺诈者和普通用户的关系性质构造一个图,接着通过两层图卷积神经网络的方式为图中的评论节点聚合其邻居的特征,在增强自身的特征表示后将这些特征输入到神经网络中,训练成一个分类器,最后对评论数据进行分类。但该算法在模型训练过程中需要用到图结构的信息与图中节点的特征表示,但大多数数据集中包含的数据信息是有限的,这使得模型在为用户节点和商品节点构建特征的过程中只能用到少量的信息。

技术实现思路

1、鉴于此,本发明实施例提供了一种基于联邦图神经网络的虚假评论检测模型训练方法、检测方法及设备,以消除或改善现有技术中存在的一个或更多个缺陷,解决现有的虚假评论检测模型特征表示能力有限、检测精度低的问题。

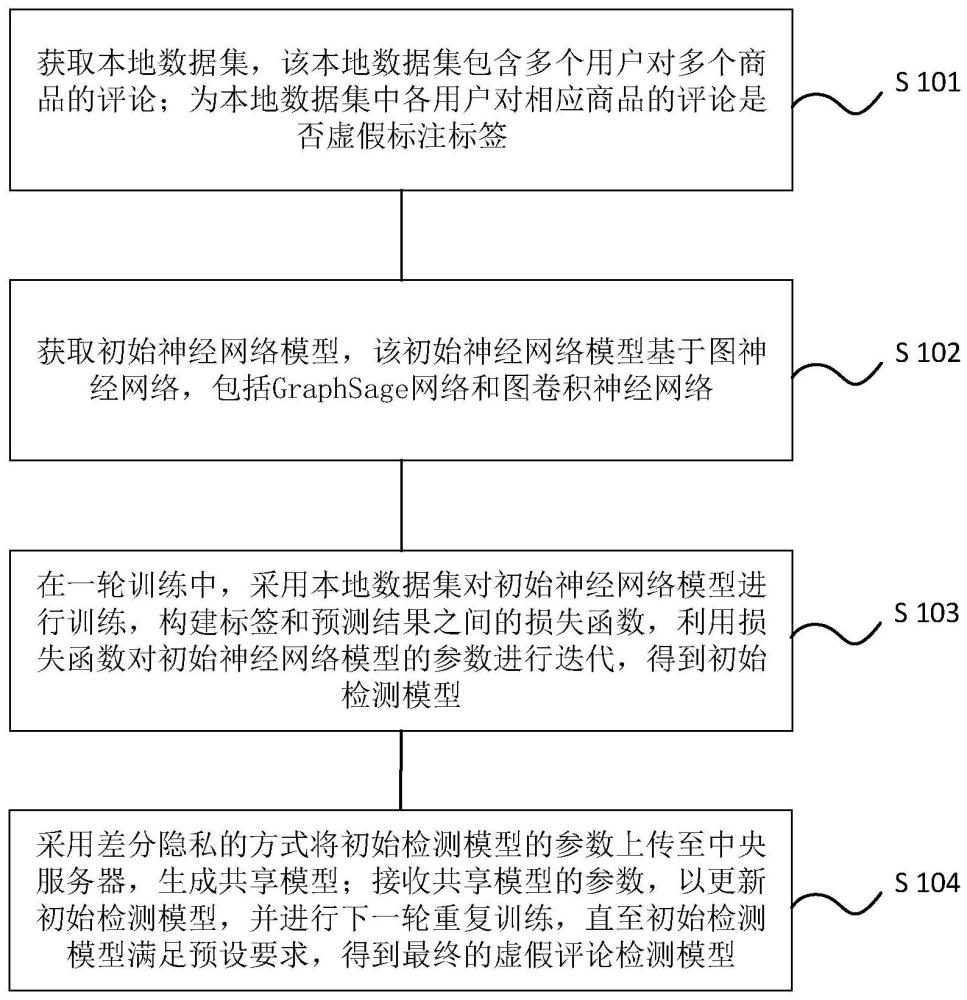

2、一方面,本发明提供一种基于联邦图神经网络的虚假评论检测模型训练方法,其特征在于,所述方法在各客户端执行,各客户端包含对齐的用户实体和商品实体,包括以下步骤:

3、获取本地数据集,所述本地数据集包含多个用户对多个商品的评论;为所述本地数据集中各用户对相应商品的评论是否虚假标注标签;

4、获取初始神经网络模型;所述初始神经网络模型基于图神经网络,包括graphsage网络和图卷积神经网络;将所述本地数据集输入所述初始神经网络模型,对用户节点、商品节点和评论节点进行特征提取,得到第一用户特征、第一商品特征和第一评论特征;采用差分隐私的方式与其他客户端互相交换提取的第一用户特征和第一商品特征,以增强特征表示,得到第二用户特征和第二商品特征;采用graphsage算法将所述第一评论特征聚合其邻居用户节点、邻居商品节点对应的第二用户特征和第二商品特征,得到聚合评论特征;将所述本地数据集通过预设数量个不同元路径构建出预设数量张评论节点的同质图;在每张同质图中,采用所述图卷积神经网络聚合所述评论节点的特征,得到第二评论特征;基于注意力机制融合多张同质图得到的第二评论特征,得到融合评论特征;将所述聚合评论特征与所述融合评论特征进行拼接,得到最终特征向量;将每一条评论的最终特征向量输入预设分类器中,得到每一条评论的预测结果;

5、在一轮训练中,采用所述本地数据集对所述初始神经网络模型进行训练,构建所述标签和所述预测结果之间的损失函数,利用所述损失函数对所述初始神经网络模型的参数进行迭代,得到初始检测模型;

6、采用差分隐私的方式将所述初始检测模型的参数上传至中央服务器,生成共享模型;所述共享模型由所述中央服务器根据各客户端初始检测模型的参数聚合得到;接收所述共享模型的参数,以更新所述初始检测模型,并进行下一轮重复训练,直至所述初始检测模型满足预设要求,得到最终的虚假评论检测模型。

7、在本发明的一些实施例中,采用差分隐私的方式与其他客户端互相交换提取的第一用户特征和第一商品特征,还包括:

8、定义第一数据集和第二数据集为相邻数据集,所述第一数据集和所述第二数据集应满足:

9、

10、其中,x表示所述第一数据集;x'表示所述第二数据集;x表示所述第一数据集x中的一条数据;

11、定义一种随机扰动算法对所述相邻数据集满足差分隐私,其对应的查询函数应满足:

12、pr[m(x)∈o]≤e’εpr[m(x')∈o]+δ;

13、其中,m(·)表示所述随机扰动算法;pr[·]表示查询函数;x表示所述第一数据集;x'表示所述第二数据集;e’表示自然对数的底数;ε表示隐私预算;o表示查询结果;δ表示阈值;

14、基于上述定义,裁剪具有所述阈值的本地梯度l2范数,并应用平均噪声的拉普拉斯差分隐私机制,对所述本地数据集进行隐私保护,计算式为:

15、gi=clip(gi,δ)+laplace(0,λ);

16、其中,gi表示各客户端需互相交换的第一用户特征和第一商品特征;clip(·)表示裁剪函数;δ表示所述阈值;laplace(·)表示拉普拉斯;λ表示噪声强度。

17、在本发明的一些实施例中,采用graphsage算法将所述第一评论特征聚合其邻居用户节点、邻居商品节点对应的第二用户特征和第二商品特征,得到聚合评论特征,还包括:

18、在所述graphsage网络中,每一层得到的聚合评论特征计算式为:

19、

20、其中,表示第l层得到的聚合评论特征;w表示待训练的矩阵;e表示所述评论节点;agg(·)表示聚合函数;表示第l-1层的第一评论特征;表示第l-1层的邻居用户节点的第二用户特征;表示第l-1层的邻居商品节点的第二商品特征。。

21、在本发明的一些实施例中,将所述本地数据集的原始异质图通过预设数量个不同元路径构建出预设数量张评论节点的同质图,所述元路径至少包括两条评论是同一位用户所发表和两条评论均属于同一商品。

22、在本发明的一些实施例中,在每张同质图中,采用所述图卷积神经网络聚合所述评论节点的特征,得到第二评论特征,所述第二评论特征的计算式为:

23、

24、其中,表示第n张同质图在所述图卷积神经网络第l+1层得到的第二评论特征;σ(·)表示激活函数;a表示评论的邻接矩阵;和用于将所述邻接矩阵归一化;表示第n张同质图在所述图卷积神经网络第l层得到的第二评论特征;wl表示所述图卷积神经网络第l层的权重矩阵。

25、在本发明的一些实施例中,基于注意力机制融合多张同质图得到第二评论特征,得到融合评论特征,其中,所述评论节点在各元路径下的注意力权重计算式为:

26、

27、其中,αe,n表示评论节点e在元路径n下的注意力权重;zn表示在元路径n下的注意力向量;表示评论节点e的特征向量在所有元路径下的连接;

28、基于所述注意力权重,计算所述融合评论特征,计算式为:

29、

30、其中,e表示所述融合评论特征;αe,n表示评论节点e在元路径n下的注意力权重;表示评论节点e在元路径n下的特征向量。

31、在本发明的一些实施例中,构建所述标签和所述预测结果的损失函数,所述损失函数计算式为:

32、

33、其中,l表示所述损失函数;k表示评论的数量;表示所述标签;yr,k表示所述预测结果。

34、在本发明的一些实施例中,所述中央服务器采用联邦平均算法对各客户端上传的参数进行加权平均处理,计算式为:

35、

36、其中,rt+1表示所述客户端第t+1轮迭代的参数;m表示所述客户端的数量;rt表示所述客户端第t轮迭代的参数;wi表示客户端i的权重。

37、另一方面,本发明提供一种基于联邦图神经网络的虚假评论检测方法,其特征在于,该方法在客户端执行,包括以下步骤:

38、获取待检测数据;所述待检测数据包含至少一位用户对至少一个商品的评论;

39、将所述待检测数据输入如上文中任一项所述基于联邦图神经网络的虚假评论检测模型训练方法得到的虚假评论检测模型,以确定所述待检测数据中相应的评论是否为虚假评论。

40、另一方面,本发明还提供一种计算机可读存储介质,其上存储有计算机程序,该程序被处理器执行时实现如上文中提及的任意一项所述方法的步骤。

41、本发明的有益效果至少是:

42、本发明提供一种基于联邦图神经网络的虚假评论检测模型训练方法、检测方法及设备,基于图神经网络设计虚假评论检测模型,该模型首先采用graphsage网络聚合评论节点邻居的用户节点和商品节点的特征,得到聚合评论特征;然后通过设计不同元路径从本地数据集的异质图中构建多张同质图,在每张同质图中采用图卷积神经网络聚合每条评论的特征,并引入注意力机制融合多张同质图中聚合得到的评论特征,得到融合评论特征;最终达到增强评论特征表示、提高检测精度的效果。同时,本发明设计了基于联邦学习的虚假评论检测框架,该框架首先将各客户端通过差分隐私的方式交换用户节点、商品节点在不同维度上的特征;然后每个客户端在本地训练一个初始检测模型,并将模型参数上传至中央服务器进行聚合,聚合结果再通过差分隐私的方式返回各客户端;最终达到丰富各客户端本地数据集信息、基于联邦训练提高检测精度的效果。

43、本发明的附加优点、目的,以及特征将在下面的描述中将部分地加以阐述,且将对于本领域普通技术人员在研究下文后部分地变得明显,或者可以根据本发明的实践而获知。本发明的目的和其它优点可以通过在说明书以及附图中具体指出的结构实现到并获得。

44、本领域技术人员将会理解的是,能够用本发明实现的目的和优点不限于以上具体所述,并且根据以下详细说明将更清楚地理解本发明能够实现的上述和其他目的。

本文地址:https://www.jishuxx.com/zhuanli/20241021/319880.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。