联邦学习隐私保护方法、装置、设备及存储介质与流程

- 国知局

- 2024-11-06 14:25:41

本技术涉及模型训练,尤其涉及联邦学习隐私保护方法、装置、设备及存储介质。

背景技术:

1、近些年来,随着物联网、人工智能和大数据相关技术的广泛应用至各个领域,各行各业开始进入万物互联时代。尤其是工业领域,海量的工业设备对工业现场采集大量数据,以数据驱动工业行业向工业智能新范式转变。然而,海量工业数据通常会包含一些隐私信息,例如工业生产人脸数据、设备运维记录、生成操作记录、工业生产日志等,攻击者根据这些隐私信息可能会发起违法犯罪行为,造成生命和财产损失。

2、联邦学习本质上是一种分布式学习框架,可很好的解决工业互联网的数据隐私问题,使其在工业信息安全方面大显身手。在联邦学习的基本原理中,在每轮训练学习中,被选中的联邦学习节点接收服务器广播的全局模型,利用本地样本数据进行局部模型训练,仅上传模型参数至服务器。服务器收集所有节点最新的局部模型参数后,根据设计好的聚合算法生成新的全局模型参数,并将更新后的模型参数在下一轮广播至选中的联邦学习节点,迭代训练至模型收敛或模型性能达到预先设置的阈值。这种模型训练方式可以将原始样本数据保留在本地,提高数据的隐私性。由于联邦学习具有良好的隐私保护性,目前已经被广泛应用至多个领域。

3、然而,现有的联邦学习端节点上传的模型参数通常学习到隐私数据的特征,攻击者通过模型反推攻击(依据模型参数,反推出原始端侧隐私数据)可以还原出原始样本,从而造成隐私信息的泄露,导致模型训练安全性较低。

技术实现思路

1、本技术的主要目的在于提供一种联邦学习隐私保护方法、装置、设备及存储介质,旨在解决联邦学习模型训练安全性较低的技术问题。

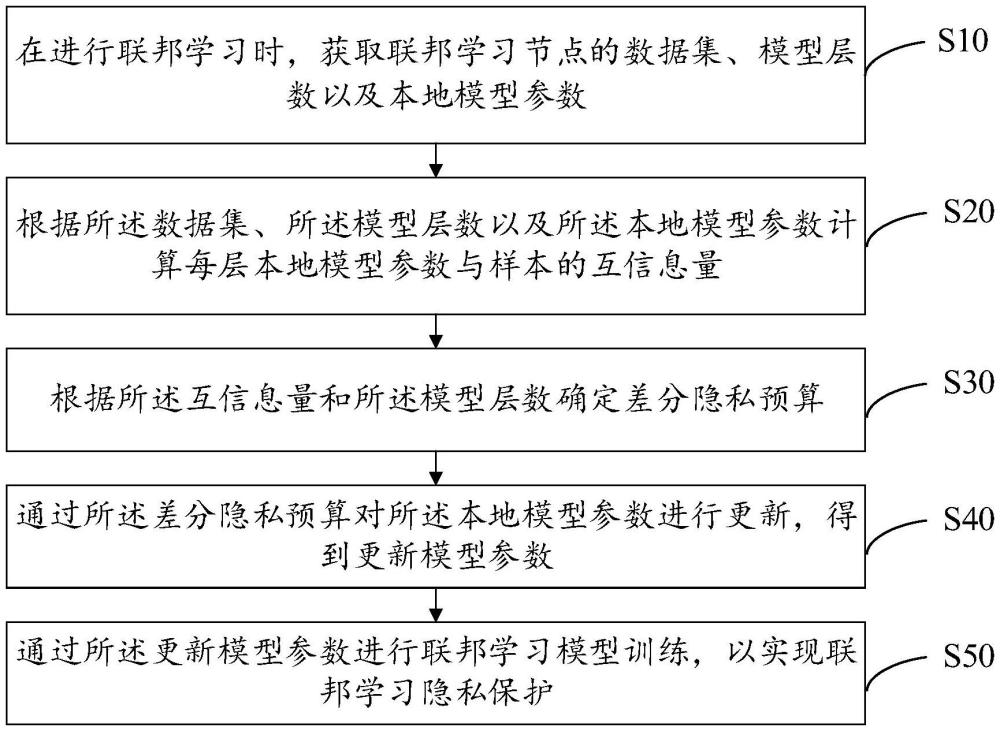

2、为实现上述目的,本技术提出一种联邦学习隐私保护方法,所述联邦学习隐私保护方法包括:

3、在进行联邦学习时,获取联邦学习节点的数据集、模型层数以及本地模型参数;

4、根据所述数据集、所述模型层数以及所述本地模型参数计算每层本地模型参数与样本的互信息量;

5、根据所述互信息量和所述模型层数确定差分隐私预算;

6、通过所述差分隐私预算对所述本地模型参数进行更新,得到更新模型参数;

7、通过所述更新模型参数进行联邦学习模型训练,以实现联邦学习隐私保护。

8、在一实施例中,根据所述数据集、所述模型层数以及所述本地模型参数计算每层本地模型参数与样本的互信息量的步骤包括:

9、根据所述数据集得到本地样本训练集;

10、根据所述模型层数和所述本地模型参数得到所有模型层数的本地模型参数数据;

11、将所述本地模型参数数据和所述本地样本训练集输入至互信息量确定模块,得到每层本地模型参数与样本的互信息量,所述互信息量确定模块包括多个卷积神经网络、全连接层以及互信息量确定神经网络。

12、在一实施例中,多个卷积神经网络包括第一卷积神经网络和第二卷积神经网络,所述第一卷积神经网络和所述第二卷积神经网络中分别包括多个高维变量映射模块;

13、所述将所述本地模型参数数据和所述本地样本训练集输入至互信息量确定模块,得到每层本地模型参数与样本的互信息量的步骤包括:

14、将所述本地样本训练集输入至所述第一卷积神经网络中的多个高维变量映射模块进行卷积,得到样本训练集特征;

15、将所述本地模型参数数据输入至所述第二卷积神经网络中的多个高维变量映射模块进行卷积,得到本地模型参数特征;

16、将所述样本训练集特征和所述本地模型参数特征进行相加后输入至所述互信息量确定模块中的全连接层,得到融合特征;

17、通过所述融合特征对所述互信息量确定模块中的互信息量确定神经网络进行训练,并在所述互信息量确定神经网络收敛后,得到每层本地模型参数与样本的互信息量。

18、在一实施例中,所述根据所述互信息量和所述模型层数确定差分隐私预算的步骤包括:

19、获取总隐私预算和模型的训练次数;

20、根据所述总隐私预算、所述训练次数、所述互信息量以及所述模型层数计算每一层模型参数的隐私预算,得到差分隐私预算。

21、在一实施例中,所述通过所述差分隐私预算对所述本地模型参数进行更新,得到更新模型参数的步骤包括:

22、获取本地模型参数的敏感度和差分隐私的松弛度;

23、根据所述敏感度、所述松弛度以及所述差分隐私预算计算高斯噪声方差;

24、根据所述高斯噪声方差对所述本地模型参数进行更新,得到更新模型参数。

25、在一实施例中,所述根据所述高斯噪声方差对所述本地模型参数进行更新,得到更新模型参数的步骤包括:

26、根据所述高斯噪声方差得到对应的高斯噪声;

27、将所述高斯噪声添加至所述本地模型参数中,得到受隐私保护的模型参数;

28、将受隐私保护的模型参数作为更新模型参数。

29、在一实施例中,所述在进行联邦学习时,获取联邦学习节点的数据集、模型层数以及本地模型参数的步骤包括:

30、在进行联邦学习时,获取联邦学习节点的全局模型参数、数据集以及模型层数;

31、根据所述数据集得到本地样本训练集;

32、通过所述本地训练样本集使用所述全局模型参数进行模型训练,得到本地模型参数。

33、此外,为实现上述目的,本技术还提出一种联邦学习隐私保护装置,所述联邦学习隐私保护装置包括:

34、获取模块,用于在进行联邦学习时,获取联邦学习节点的数据集、模型层数以及本地模型参数;

35、计算模块,用于根据所述数据集、所述模型层数以及所述本地模型参数计算每层本地模型参数与样本的互信息量;

36、确定模块,用于根据所述互信息量和所述模型层数确定差分隐私预算;

37、更新模块,用于通过所述差分隐私预算对所述本地模型参数进行更新,得到更新模型参数;

38、训练模块,用于通过所述更新模型参数进行联邦学习模型训练,以实现联邦学习隐私保护。

39、此外,为实现上述目的,本技术还提出一种联邦学习隐私保护设备,所述设备包括:存储器、处理器及存储在所述存储器上并可在所述处理器上运行的计算机程序,所述计算机程序配置为实现如上文所述的联邦学习隐私保护方法的步骤。

40、此外,为实现上述目的,本技术还提出一种存储介质,所述存储介质为计算机可读存储介质,所述存储介质上存储有计算机程序,所述计算机程序被处理器执行时实现如上文所述的联邦学习隐私保护方法的步骤。

41、此外,为实现上述目的,本技术还提供一种计算机程序产品,所述计算机程序产品包括计算机程序,所述计算机程序被处理器执行时实现如上文所述的联邦学习隐私保护方法的步骤。

42、本技术提出的一个或多个技术方案,在进行联邦学习时,获取联邦学习节点的数据集、模型层数以及本地模型参数;根据所述数据集、所述模型层数以及所述本地模型参数计算每层本地模型参数与样本的互信息量;根据所述互信息量和所述模型层数确定差分隐私预算;通过所述差分隐私预算对所述本地模型参数进行更新,得到更新模型参数;通过所述更新模型参数进行联邦学习模型训练,以实现联邦学习隐私保护,通过计算得到互信息量来动态分配隐私预算,提高联邦学习模型训练时的隐私保护效果,且对于文本类等多种模态数据以及多种模型均适用,提高隐私保护的通用性。

本文地址:https://www.jishuxx.com/zhuanli/20241106/322014.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。