基于好奇心驱动的多无人艇协同目标探索方法、电子设备和存储介质

- 国知局

- 2024-07-31 23:59:01

本发明属于无人艇,具体涉及基于好奇心驱动的多无人艇协同目标探索方法、电子设备和存储介质。

背景技术:

1、无人智能系统一直是当前研究的热点,相比于无人机和无人车,无人艇的工作环境更加复杂多变,因此对于无人艇控制器性能的要求也更高。在水上目标搜索领域,多无人艇协同搜捕往往比单无人艇的效率更高,但是对于多无人艇协同搜捕,如何进行无人艇之间的通讯和合作是较难解决的问题。

2、在传统的无人艇控制算法中,无人艇的控制分为两步,首先需要根据无人艇的位置和目标点的位置进行路径规划,其次通过路径跟踪算法保证无人艇能够准确循迹。但是传统控制算法的精度取决于建立数学模型的准确性,对于无人艇来说,建立准确的数学模型难度很大,一是因为无人艇属于典型的欠驱动和非线性系统,二是水面环境很不稳定,风浪、水流等因素的影响会导致数学模型的参数在运行过程中发生变化。随着人工智能的发展,强化学习算法应用到许多控制领域中,并且取得了令人满意的效果。相对于传统算法,强化学习不需要人工建立数学模型,它可以通过与环境交互的过程中进行神经网络的拟合,解决了无人艇数学模型建立困难的问题。

3、在水上目标搜索领域,目前已有的算法很难对环境进行充分的探索,导致目标搜索的效率很低,有一部分研究选择采用多无人艇协同工作,但是如何高效地进行无人艇之间的合作往往难以解决,因此,在水上目标搜索的技术问题中,如何加强多无人艇之间的合作关系并充分对环境进行探索是当前急需解决的问题。

技术实现思路

1、针对现有技术中存在的问题和不足,本发明的目的旨在提供一种基于好奇心驱动的多无人艇协同目标探索方法、电子设备和存储介质。

2、为实现发明目的,本发明采用的技术方案如下:

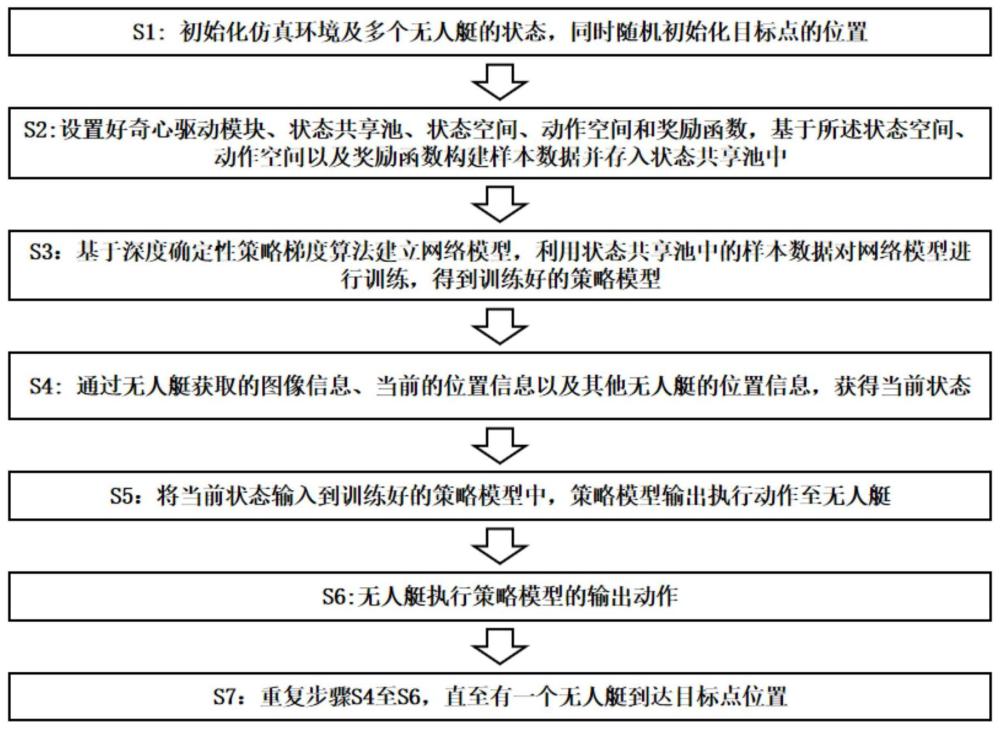

3、本发明第一方面提供一种基于好奇心驱动的多无人艇协同目标探索方法包括以下步骤:

4、s1、初始化仿真环境及多个无人艇的状态,同时随机初始化目标点的位置;

5、s2、设置好奇心驱动模块、状态共享池、状态空间、动作空间和奖励函数,基于所述状态空间、动作空间以及奖励函数构建样本数据并存入状态共享池中;

6、s3、基于深度确定性策略梯度算法建立网络模型,利用状态共享池中的样本数据对网络模型进行训练,得到训练好的策略模型;

7、s4、通过无人艇获取的图像信息、当前的位置信息以及其他无人艇的位置信息,获得当前状态;

8、s5、将当前状态输入到训练好的策略模型中,策略模型输出执行动作至无人艇;

9、s6、无人艇执行策略模型的输出动作;

10、s7:重复步骤s4至s6,直至有一个无人艇到达目标点位置。

11、根据上述基于好奇心驱动的多无人艇协同目标探索方法,优选地,步骤s1中所述目标的位置表示为bb=(xb,yb),式中xb为目标点的横坐标,yb为目标点的纵坐标。

12、根据上述基于好奇心驱动的多无人艇协同目标探索方法,优选地,步骤s2中,状态共享池表示为d={(st,at,rt,st+1)ⅰ,(st,at,rt,st+1)ⅱ,...,(st,at,rt,st+1)j},其中{(st,at,rt,st+1)ⅰ表示ⅰ号无人艇的采样数据,(st,at,rt,st+1)ⅱ表示ⅱ号无人艇的采样数据,其中j=ⅰ,ⅱ,ⅲ...。

13、根据上述基于好奇心驱动的多无人艇协同目标探索方法,优选地,步骤s2中所述状态空间表示为:

14、

15、式中,imaget为图像信息,表示无人艇的位置信息,表示其他无人艇的位置信息,其中i=1,2,3...。

16、根据上述基于好奇心驱动的多无人艇协同目标探索方法,优选地,步骤s2中所述奖励函数表示为:

17、

18、式中,r′t为好奇心奖励。

19、根据上述基于好奇心驱动的多无人艇协同目标探索方法,优选地,步骤s2中所述动作空间表示为式中表示左螺旋桨的转速,表示右螺旋桨的转速。

20、根据上述基于好奇心驱动的多无人艇协同目标探索方法,优选地,步骤s3中,好奇心驱动模块由神经网络和差分模块组成,所述神经网络的输入为当前时刻的状态st、当前时刻的动作at,所述神经网络的输出为预测的下一个时刻的状态s′t+1;所述差分模块的输入为s′t+1和下一时刻的状态st+1,做差分计算后输出好奇心奖励r′t,s′t+1和st+1差异越大好奇心奖励r′t就越大。

21、根据上述基于好奇心驱动的多无人艇协同目标探索方法,优选地,步骤s3中所述深度确定性策略梯度算法包含四个网络,分别为动作网络μ、目标动作网络μ’、评价网络q、目标评价网络q’,其中动作网络μ的参数表示为θμ,目标动作网络μ’的参数表示为θμ′,评价网络q的参数表示为θq,目标评价网络q’的参数表示为θq′。

22、根据上述基于好奇心驱动的多无人艇协同目标探索方法,优选地,步骤s3中所述深度确定性策略梯度算法中的动作网络参数θμ和评价网络参数θq采用随机初始化的方式生成,目标动作网络参数θμ′复制θμ的参数,目标评价网络参数θq′复制θq的参数,表示如下:

23、θμ'←θμ

24、θq'←θq。

25、根据上述基于好奇心驱动的多无人艇协同目标探索方法,优选地,为提高策略动作选择的泛化能力,在动作网络μ输出的动作at上加入噪声,表示为:

26、at=μ(st|θμ)+νt

27、式中,nt表示高斯噪声。

28、根据上述基于好奇心驱动的多无人艇协同目标探索方法,优选地,神经网络更新时从状态共享池采集n个样本,样本表示为(st,at,rt,st+1),神经网络更新的目标值表示为:

29、yt+1=rt+γq'(st+1,μ'(st+1|θμ')|θq')

30、式中,γ是一个超参数。

31、根据上述基于好奇心驱动的多无人艇协同目标探索方法,优选地,神经网络的损失函数表示为:

32、

33、式中,n为样本的个数。

34、根据上述基于好奇心驱动的多无人艇协同目标探索方法,优选地,所述动作网络参数更新的梯度表示为:

35、

36、根据上述基于好奇心驱动的多无人艇协同目标探索方法,优选地,所述目标网络参数采用软更新的方式,表示为:

37、θq'=τθq+(1-τ)θq'

38、θμ'=τθμ+(1-τ)θμ'

39、式中τ是一个超参数。

40、本发明第二方面提供了一种电子设备,包括存储器及处理器,所述存储器上存储有计算机程序,所述处理器执行所述计算机程序时实现如第一方面所述的基于好奇心驱动的多无人艇协同目标探索方法中的任一步骤。

41、本发明第三方面提供了一种计算机可读存储介质,其特征在于,所述计算机可读存储介质上存储有计算机程序,所述计算机程序经计算机处理器执行时实现如第一方面所述基于好奇心驱动的多无人艇协同目标探索方法中的任一步骤。

42、与现有技术相比,本发明的有益效果如下:

43、1.本发明通过设置状态共享池,将无人艇在探索过程中采集到的样本储存在经验共享池中,使无人艇之间可以共享经验,减少重复探索的情况发生,大大提高探索效率,增强了无人艇之间的合作性。

44、2.本发明通过设置好奇心驱动模块,提高无人艇对未知领域的探索兴趣,提高对环境的探索程度,从而提高目标探索的效率。

45、3.本发明无人艇的运动采用深度强化学习算法控制,不需要人工建立无人艇的数学模型,通过在与环境的交互的过程中进行神经网络的拟合,解决了无人艇数学模型建立困难的问题。

本文地址:https://www.jishuxx.com/zhuanli/20240730/199451.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表