一种基于增强现实的视障人群寻路交互方法及装置

- 国知局

- 2024-08-22 14:19:56

本发明涉及一种视障人群寻路交互方法及装置,尤其涉及一种基于增强现实的视障人群寻路交互方法及装置,属于寻路交互。

背景技术:

1、在目前的社会环境中,我国眼科疾病患者数占比逐年上涨,视觉障碍使得获取空间信息困难、活动不便,同时视觉障碍还会使人更易感到孤立,与其他重病患者相比,视障人群在幸福感评估中的分数也相对较低;在拥挤的公共场所,低视力人群可能会感到不安、恐惧和无助,因为他们无法准确感知周围环境,还可能遭受他人的干扰或误解。

2、近年来增强现实的技术得到了长足的进步,其技术提升使得增强现实技术与更多学科研究结合成为了可能,包括医学教育、学前教育、工业设计和城市规划等学科。

3、在建筑设计行业,增强现实应用并不广泛,虽然在寻路领域中增强现实技术已经有一定程度的应用,但是多用于导航系统开发和为寻路者提供导航信息,上述研究的重点是帮助实验对象明确一个人或一个物体在空间中的位置,更倾向于空间认知信息;目前类似的研究成果已经充分运用于城市环境的导航,室内由于信号的局限和精确度的限制,室内导航的研究还在持续进行中,现有技术中对于视障人群的针对性不强,没有结合视障人群的生理和心理特点、进行差异化的视觉设计与多模态交互搭建而形成的寻路方法。

4、综上所述,需要一种适用于视障人群的、可以实现多模态交互的寻路方法及装置。

技术实现思路

1、在下文中给出了关于本发明的简要概述,以便提供关于本发明的某些方面的基本理解。应当理解,这个概述并不是关于本发明的穷举性概述。它并不是意图确定本发明的关键或重要部分,也不是意图限定本发明的范围。其目的仅仅是以简化的形式给出某些概念,以此作为稍后论述的更详细描述的前序。

2、鉴于此,为解决现有技术中传统的基于增强现实技术的寻路方法不适用于视障人群的问题,本发明提供一种基于增强现实的视障人群寻路交互方法及装置。

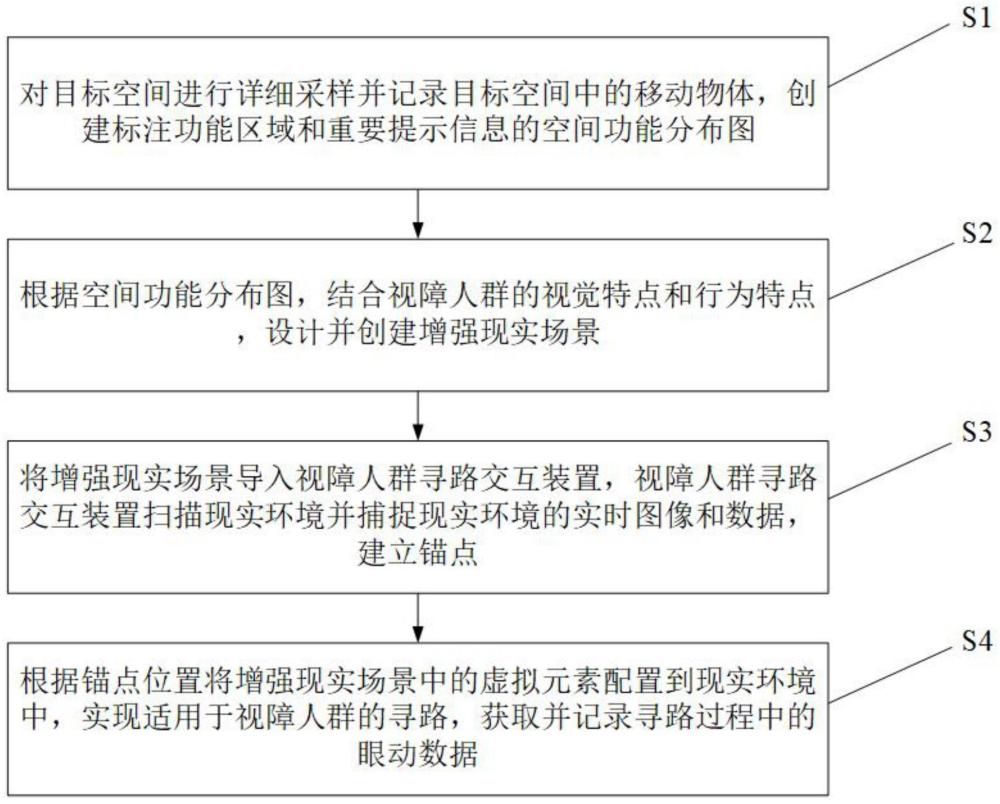

3、技术方案一如下:一种基于增强现实的视障人群寻路交互方法,包括以下步骤:

4、s1.对目标空间进行详细采样并记录目标空间中的移动物体,创建标注功能区域和重要提示信息的空间功能分布图;

5、s2.根据空间功能分布图,结合视障人群的视觉特点和行为特点,设计并创建增强现实场景;

6、s3.将增强现实场景导入视障人群寻路交互装置,视障人群寻路交互装置扫描现实环境并捕捉现实环境的实时图像和数据,建立锚点;

7、s4.根据锚点位置将增强现实场景中的虚拟元素配置到现实环境中,实现适用于视障人群的寻路,获取并记录寻路过程中的眼动数据。

8、进一步地,所述s1中,结合分析采样内容和移动物体,即可得到空间功能分布图,采样内容包括测量目标空间的尺寸和识别目标空间中的固定结构,功能区域包括等待区、工作区和交通区域,重要提示信息包括紧急出口、楼梯、电梯和卫生间的位置以及设置的视障人群特殊标识。

9、进一步地,所述s2中,增强现实场景的设计内容包括虚拟元素和听觉反馈,虚拟元素包括颜色标识、指示牌和导航箭头,听觉反馈包括语音指示和环境声音。

10、进一步地,所述s3中,所述的建立锚点包括以下步骤:

11、检查worldanchormanager的anchorstore是否为空,如果anchorstore不为空,则遍历games列表中的每个元素,对于每个元素,调用add方法,将当前元素作为参数传递,取消之前调用的invoke;

12、接受一个类型为gameobject的参数data,用于输出信息“添加锚”,然后调用worldanchormanager的attachanchor方法,将传入的data对象附加到世界锚点上;

13、接受一个类型为gameobject的参数data,用于输出信息"删除锚点",然后调用worldanchormanager的removeanchor方法,从世界锚点中移除传入的data对象;

14、预设在每一帧都会被调用的update,且update为空没有实际功能,当需要在每一帧执行逻辑时,在update中添加相应的代码。

15、进一步地,所述s4中,所述的获取并记录寻路过程中的眼动数据包括以下步骤:

16、预设在每一帧都会被调用的update,在update内部执行下述操作,获取眼动提供者过程中,确定一个名为eyegazeprovider的变量,其使用了c#的空条件运算符来获取混合现实工具包中的eyegazeprovider即眼动提供者,如果eyegazeprovider不为空即眼动提供者可用,进行设置gameobject的位置操作;

17、设置gameobject的位置过程中,将gameobject即当前脚本所附加的游戏对象的位置设置为用户的眼动起点位置和用户的眼动方向的规范化向量乘以默认距离后的位置,使gameobject跟随用户的眼动并保持在设定距离内,随后检查眼动跟踪目标;

18、检查眼动跟踪目标过程中,定义一个名为lookedateyetarget的变量,其表示用户正在看的眼动跟踪目标,如果lookedateyetarget不为空,根据目标位置更新gameobject位置;

19、更新gameobject位置过程中,如果目标的eyecursorsnaptotargetcenter属性为真,创建一条从相机到目标中心的射线,使用物理射线投射函数获取射线与目标的交点信息,将gameobject的位置设置为交点的位置,否则,将gameobject的位置设置为用户的眼动射线与目标的击中位置,如果没有目标被击中,将gameobject的位置设置为沿着眼动射线的默认距离处。

20、技术方案二如下:一种基于增强现实的视障人群寻路交互装置,用于实现技术方案一所述的基于增强现实的视障人群寻路交互方法,包括眼镜式显示装置、手部追踪模块、眼动追踪模块、空间映射模块和语音识别模块;

21、所述眼镜式显示装置与手部追踪模块、眼动追踪模块、空间映射模块和语音识别模块分别连接;

22、所述眼镜式显示装置用于以全息图像形式提供虚拟导航信息,指引用户避开障碍物;

23、所述手部追踪模块用于精准追踪用户的手部动作,满足用户与全息图像互动;

24、所述眼动追踪模块用于实时追踪用户的眼动,进而优化全息图像的显示位置和大小;

25、所述空间映射模块用于构建实时的环境网格,使装置能够精确捕捉周围环境的空间布局;

26、所述语音识别模块用于进行自然语言处理,使用户可以通过语音命令控制装置。

27、本发明的有益效果如下:本发明基于增强现实技术(ar),根据视障人群需求提取、影响要素分析建立视听交互辅助寻路方法,在使用过程中可以通过增强视觉效果、校准视野、利用现存有限视野范围投影现实场景、文字转音频等功能,为视障人士提供寻路辅助;本发明结合视障人群视觉特点和行为特点,构建所需要的增强现实场景,配合视障人群寻路交互装置,提供了一个直观、易于理解的寻路辅助工具,提高了视障人群在室内环境中寻路的自主性和安全性;本发明实现了在现实环境中进行视障人群的行为模拟实验并在实验过程中收集眼动数据,采集的眼动数据可用于后续视障人群相关寻路研究。

本文地址:https://www.jishuxx.com/zhuanli/20240822/278155.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。