一种基于深度学习的焦平面无折返显微聚焦方法

- 国知局

- 2024-11-21 11:59:10

本发明属于显微成像,具体涉及一种基于深度学习的焦平面无折返显微聚焦方法。

背景技术:

1、显微镜是探索微观领域的重要工具,其在生物医学、电子元件检测等领域有广泛应用。但是由于显微镜光学结构的限制,其景深通常较小。这导致当成像目标偏离焦平面后,成像会迅速模糊。因此,聚焦是显微镜能够正常工作且获得高质量图像的必要操作。显微镜的聚焦主要分为基于硬件改造和基于软件算法两个方向。硬件改造通常是修改照明光源、引入光场调制元件(slm、相位板)等方式来得到编码的离焦信息,例如文献(silvestril,müllenbroich m c,costantini i,et al.universal autofocus for quantitativevolumetric microscopy of whole mouse brains[j].nature methods,2021,18(8):953-958.以及ge z,wei h,xu f,et al.millisecond autofocusing microscopy usingneuromorphic event sensing[j].optics and lasers in engineering,2023,160:107247.),再对离焦信息解码处理后完成聚焦。这类基于硬件改造的方法在效率和精度上通常有不错的表现,但是由于需要添置元件来修改显微镜结构,导致通用性受到限制,难以应用到商用显微镜中。相反,软件算法只需要对显微镜采集的数字图像进行处理即可完成聚焦。由于其便于部署实现的特点,受到了广泛关注和研究。

2、一种较原始的软件聚焦方法是以一定步长移动整个目标后再进行扫描,然后选择清晰度值最大的一张图像作为聚焦图像。但是这种方法需要采集大量图像,焦平面移动行程大,导致聚焦时间长、效率低。更多商业软件采用多尺度搜索方法(陈川,张旻,仇浩,等.基于改进爬山算法的显微自动对焦系统[j].江苏理工学院学报,2023,29(02):10-18.doi:10.19831/j.cnki.2095-7394.2023.02.002.)。该方法先大步长扫描目标,当发现清晰度值由小变大再变小时,说明已经越过了最佳聚焦点,此时再采用小步长折返搜索。该方法大幅缩减了焦平面移动行程。但是该方法在搜索过程中会在最佳聚焦位置附近反复搜索,造成焦平面出现多次折返振荡的现象。除了多尺度搜索方法,现有的聚焦算法搜索策略基本都需要焦平面越过最佳聚焦位置后再折返,而焦平面折返会导致浪费不必要的时间且效率低下。因此为解决上述问题,提出一种新的无需焦平面折返的显微聚焦方法是十分必要的。

技术实现思路

1、本发明的目的是为解决现有聚焦方法需要焦平面多次折返振荡,导致所需聚焦时间长、聚焦效率低的问题,而提出了一种基于深度学习的焦平面无折返显微聚焦方法。

2、本发明为解决上述技术问题所采取的技术方案是:一种基于深度学习的焦平面无折返显微聚焦方法,所述方法具体包括以下步骤:

3、步骤一、搭建包括编码器和解码器的聚焦测量网络;

4、步骤二、根据显微镜参数生成点扩展函数,再基于点扩展函数生成聚焦测量网络的训练数据集;

5、步骤三、利用步骤二中生成的训练数据集对搭建的聚焦测量网络进行训练,获得训练好的聚焦测量网络;

6、步骤四、在显微镜下采集成像目标的一张图像,对采集的图像进行裁剪后,将通过裁剪获得的各个图像块输入训练好的聚焦测量网络,获得采集的图像对应的语义分割图;

7、并从语义分割图中截取出感兴趣区域图像;

8、步骤五、计算步骤四中截取出的感兴趣区域图像内各个像素的均值,将计算出的均值作为感兴趣区域的清晰度值;

9、步骤六、计算步骤五中获得的清晰度值与目标清晰度值的差值,判断差值是否小于设定的阈值γ;

10、若差值小于设定的阈值γ,则完成聚焦;

11、若差值大于等于设定的阈值γ,则执行步骤七;

12、步骤七、根据步骤五中获得的清晰度值计算焦平面的移动步长,将焦平面按照移动方向和计算出的移动步长进行移动后,在新的焦平面位置上重新采集成像目标的图像;

13、对重新采集的成像目标图像返回执行步骤四。

14、进一步地,所述聚焦测量网络的编码器包括顺次连接的n个结构相同的注意力机制模块,且注意力机制模块内包括一个自注意力机制层、一个卷积核大小为3×3的卷积层以及一个图像块重叠区域处理单元;所述图像块重叠区域处理单元内包括一个卷积核大小为7×7的卷积层和一个卷积核大小为3×3的卷积层;

15、解码器包括两个多层感知机。

16、优选地,所述注意力机制模块的个数n的取值为4。

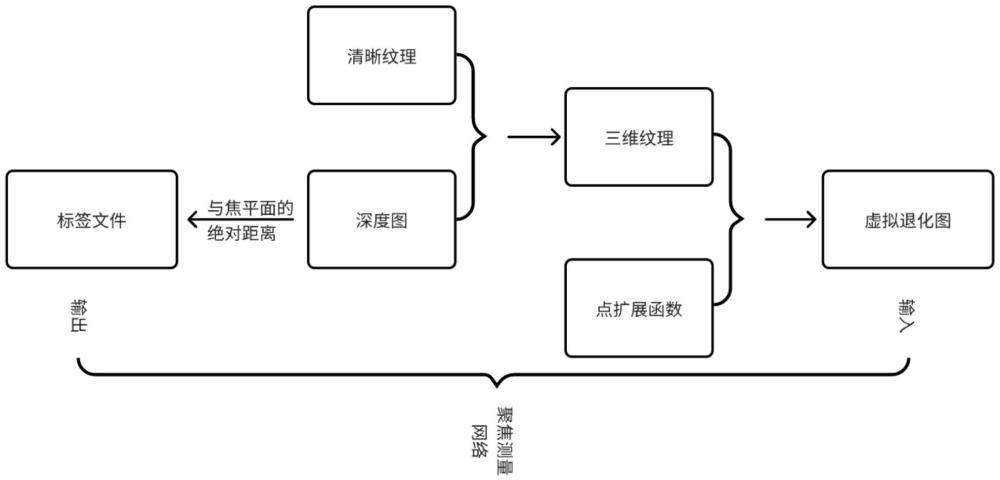

17、进一步地,所述步骤二中,训练数据集的生成方法为:

18、对于任意一个训练数据:

19、步骤1、根据显微镜参数和imagej软件中的born&wolf模型生成点扩展函数;

20、步骤2、获取一张具有纹理信息的切片,显微镜下通过手动方式拍摄到获取的切片在聚焦状态下的图像;

21、步骤3、获得步骤2的切片对应的深度图,具体为:

22、通过生成perlin噪声来模拟步骤2的切片中物体的高低起伏,获得深度图;

23、步骤4、将步骤2获得的图像和步骤3获得的深度图组合,得到3d表面纹理图;

24、步骤5、将3d表面纹理图与点扩展函数进行卷积生成虚拟退化图,将生成的虚拟退化图作为训练数据中的输入部分,分别计算深度图中每个像素的值与焦平面位置的绝对距离,将各像素对应的绝对距离作为训练数据中的输出部分,即利用各像素对应的绝对距离组成标签图像。

25、进一步地,所述聚焦测量网络的工作过程为:

26、将步骤四中通过裁剪获得的各个图像块作为聚焦测量网络的输入,在聚焦测量网络内,各个图像块首先经过编码器,再将编码器的n个注意力机制模块的输出均输入到解码器的第1个多层感知机;

27、第1个多层感知机将n个特征图缩放到相同的维度后,再将缩放后的n个特征图沿通道维度拼接成一个特征图,并将拼接成的特征图作为第二个多层感知机的输入;

28、通过第二个多层感知机输出语义分割图。

29、进一步地,所述各个图像块输入聚焦测量网络之前,需要先经过sobel算子进行前处理。

30、进一步地,所述根据步骤五中获得的清晰度值计算焦平面的移动步长采用的是pid控制器。

31、进一步地,所述根据步骤五中获得的清晰度值计算焦平面的移动步长,具体为:

32、z_step=kp(c_set-c_cur)+kdc_diff+kic_intgral

33、其中,z_step是焦平面的移动步长,c_cur是步骤五中获得的清晰度值,c_set是目标清晰度值,c_diff是pid控制器的微分项,c_intgral是pid控制器的积分项,kp,kd和ki均为pid控制器的控制参数。

34、进一步地,所述目标清晰度值的计算方法为:

35、获取一个与成像目标属于同类纹理的样本,在显微镜下给获取的样本采集一张聚焦图像,再对采集的聚焦图像进行裁剪,得到各个图像块;

36、将各个图像块输入到训练好的聚焦测量网络,再从聚焦测量网络输出的图像中截取出感兴趣区域图像,再计算截取出的感兴趣区域图像中各个像素的均值,将计算出的均值作为目标清晰度值。

37、更进一步地,所述步骤四之前还包括如下过程:

38、当焦平面位于位置a处,利用显微镜采集位置a处的成像目标图像xa;再从位置a将焦平面移动△a步长,移动后焦平面位于位置b处,利用显微镜采集位置b处的成像目标图像xb;

39、对图像xa进行裁剪后,将获得的各个图像块输入训练好的聚焦测量网络,获得图像xa对应的语义分割图,从语义分割图中截取出感兴趣区域图像roia,再计算感兴趣区域图像roia内各个像素的均值la;

40、对图像xb进行裁剪后,将获得的各个图像块输入训练好的聚焦测量网络,获得图像xb对应的语义分割图,从语义分割图中截取出感兴趣区域图像roib,再计算感兴趣区域图像roib内各个像素的均值lb;

41、判断是否满足la-c_set<γ或lb-c_set<γ;

42、若满足,则完成聚焦;

43、若不满足,则继续比较la与lb的大小:

44、若la小于lb,则确定焦平面的移动方向为位置b到位置a的方向,再继续执行步骤四,即步骤四中是在位置a的基础上,焦平面沿移动方向移动到新的位置时采集的图像;

45、若la大于lb,则确定焦平面的移动方向为位置a到位置b的方向,再继续执行步骤四,即步骤四中是在位置b的基础上,焦平面沿移动方向移动到新的位置时采集的图像。

46、本发明的有益效果是:

47、1、本发明首先构建并训练聚焦测量网络,当输入一张成像目标的显微图像时,由聚焦测量网络输出一张描述原图各区域聚焦程度的聚焦测量图,也称为语义分割图;从聚焦测量图中划定出感兴趣区域后,统计感兴趣区域内的像素均值作为输入图像的清晰度测量值,最后基于pid控制的搜索策略实现了变步长的搜索策略。

48、2、本发明实现了焦平面无需折返的聚焦过程,与传统多尺度搜索算法相比,在相同精度前提下,焦平面移动行程减少了60%,节省聚焦时间超过70%,提高了聚焦的效率。

本文地址:https://www.jishuxx.com/zhuanli/20241120/333710.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。

下一篇

返回列表