用于警报事件的红点视频展示方法及系统与流程

- 国知局

- 2024-11-25 15:20:23

本技术涉及视频处理,具体地,涉及一种用于警报事件的红点视频展示方法及系统。

背景技术:

1、传统的报警系统联动视频图像进行复核,采用了监控系统中的数字视频录像机、带存储卡的网络摄像机,但由于数据管理的应用中,没有使用缓存数据,当事件发生时,事前3分钟的录像还未生成,平台端收到的报警图像严重滞后,不能够精准定位到报警瞬间发生视频信息。

2、随着对实时监控和事后复核的需求日益增长,在安全监控、交通管理、工业自动化等领域,能够快速准确地识别和响应异常事件变得至关重要。报警标签(体现在视频中为红点)会记录在当有报警发生时的时间戳,从而基于该时间戳可以精准对应报警发生的瞬间。并且在复核的过程中,仅传输包含红点的视频片段而非整个视频流,可以减少带宽的占用。

3、然而,仅仅关注报警发生瞬间的视频片段可能不足以提供全面的事件背景。即在实际的应用场景中,仍需关注报警发生之前的情况以及报警消失之后的情况,以便更全面地了解事件的前因后果和影响范围。但如果只是简单的延长视频片段时间,例如沿着视频片段的前向和后向分别延展预定时间,这可能会引入无关内容,同时又会增加带宽的占用。

4、因此,需要一种优化的方案以解决上述技术问题。

技术实现思路

1、提供该技术实现要素:部分以便以简要的形式介绍构思,这些构思将在后面的具体实施方式部分被详细描述。该发明内容部分并不旨在标识要求保护的技术方案的关键特征或必要特征,也不旨在用于限制所要求的保护的技术方案的范围。

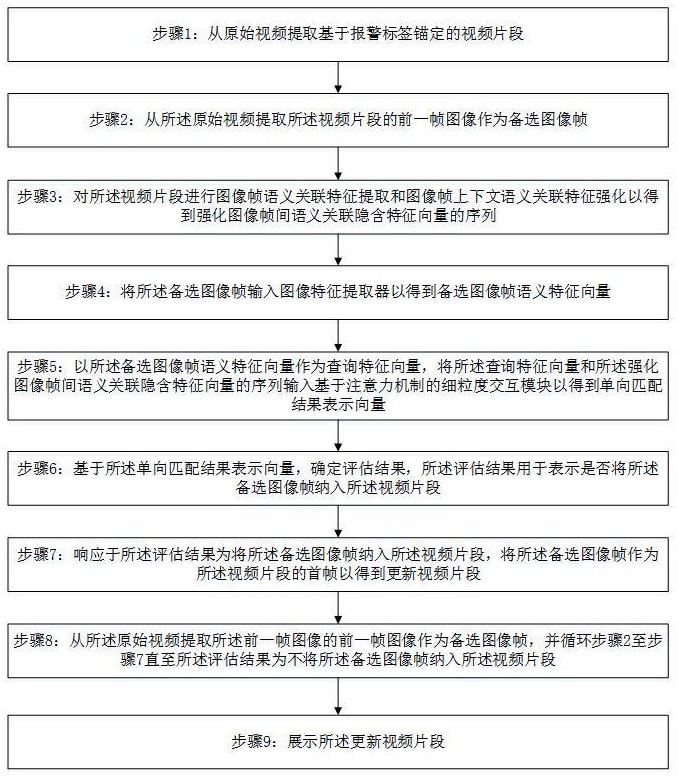

2、第一方面,本技术提供了一种用于警报事件的红点视频展示方法,所述方法包括:

3、步骤1:从原始视频提取基于报警标签锚定的视频片段;

4、步骤2:从所述原始视频提取所述视频片段的前一帧图像作为备选图像帧;

5、步骤3:对所述视频片段进行图像帧语义关联特征提取和图像帧上下文语义关联特征强化以得到强化图像帧间语义关联隐含特征向量的序列;

6、步骤4:将所述备选图像帧输入图像特征提取器以得到备选图像帧语义特征向量;

7、步骤5:以所述备选图像帧语义特征向量作为查询特征向量,将所述查询特征向量和所述强化图像帧间语义关联隐含特征向量的序列输入基于注意力机制的细粒度交互模块以得到单向匹配结果表示向量;

8、步骤6:基于所述单向匹配结果表示向量,确定评估结果,所述评估结果用于表示是否将所述备选图像帧纳入所述视频片段;

9、步骤7:响应于所述评估结果为将所述备选图像帧纳入所述视频片段,将所述备选图像帧作为所述视频片段的首帧以得到更新视频片段;

10、步骤8:从所述原始视频提取所述前一帧图像的前一帧图像作为备选图像帧,并循环步骤2至步骤7直至所述评估结果为不将所述备选图像帧纳入所述视频片段;

11、步骤9:展示所述更新视频片段。

12、可选地,所述步骤3,包括:将所述视频片段中的各个图像帧分别通过基于卷积神经网络模型的图像特征提取器以得到图像帧语义特征向量的序列;将所述图像帧语义特征向量的序列输入基于rnn模型的视频语义特征提取器以得到图像帧间语义关联隐含特征向量的序列;将所述图像帧间语义关联隐含特征向量的序列输入全局上下文的语义显著性提升模块以得到所述强化图像帧间语义关联隐含特征向量的序列。

13、可选地,将所述图像帧间语义关联隐含特征向量的序列输入全局上下文的语义显著性提升模块以得到所述强化图像帧间语义关联隐含特征向量的序列,包括:计算所述图像帧间语义关联隐含特征向量的序列中的各个图像帧间语义关联隐含特征向量的最大值以得到由各个所述最大值组成的图像帧间语义关联隐含特征显著特征向量;计算所述图像帧间语义关联隐含特征向量的序列中的各个图像帧间语义关联隐含特征向量的平均值以得到由各个所述平均值组成的图像帧间语义关联隐含特征全局特征向量;对所述图像帧间语义关联隐含特征显著特征向量和所述图像帧间语义关联隐含特征全局特征向量进行邻域编码和激活以得到图像帧间语义关联隐含特征显著特征上下文关联激活特征向量和图像帧间语义关联隐含特征全局特征上下文关联激活特征向量;融合所述图像帧间语义关联隐含特征显著特征上下文关联激活特征向量和所述图像帧间语义关联隐含特征全局特征上下文关联激活特征向量以得到图像帧间语义关联隐含特征显著-全局特征上下文关联激活特征向量后,对所述图像帧间语义关联隐含特征显著-全局特征上下文关联激活特征向量进行非线性激活以得到图像帧间语义关联隐含特征显著-全局特征上下文关联权重特征向量;以所述图像帧间语义关联隐含特征显著-全局特征上下文关联权重特征向量作为权重向量,对所述图像帧间语义关联隐含特征向量的序列中的各个图像帧间语义关联隐含特征向量进行按位置点乘,将按位置点乘得到的向量的序列与所述图像帧间语义关联隐含特征向量的序列进行逐元素相加以得到所述强化图像帧间语义关联隐含特征向量的序列。

14、可选地,对所述图像帧间语义关联隐含特征显著特征向量和所述图像帧间语义关联隐含特征全局特征向量进行邻域编码和激活以得到图像帧间语义关联隐含特征显著特征上下文关联激活特征向量和图像帧间语义关联隐含特征全局特征上下文关联激活特征向量,包括:对所述图像帧间语义关联隐含特征显著特征向量进行一维卷积编码、非线性激活和线性变换以得到所述图像帧间语义关联隐含特征显著特征上下文关联激活特征向量;对所述图像帧间语义关联隐含特征全局特征向量进行一维卷积编码、非线性激活和线性变换以得到所述图像帧间语义关联隐含特征全局特征上下文关联激活特征向量。

15、可选地,对所述图像帧间语义关联隐含特征显著-全局特征上下文关联激活特征向量进行非线性激活以得到图像帧间语义关联隐含特征显著-全局特征上下文关联权重特征向量,包括:将所述图像帧间语义关联隐含特征显著-全局特征上下文关联激活特征向量分别通过tanh激活函数和sigmoid激活函数后,将获得的两个向量进行点乘以得到所述图像帧间语义关联隐含特征显著-全局特征上下文关联权重特征向量。

16、可选地,所述步骤4,包括:将所述备选图像帧输入所述基于卷积神经网络模型的图像特征提取器以得到所述备选图像帧语义特征向量。

17、可选地,所述步骤5,包括:计算所述查询特征向量与所述强化图像帧间语义关联隐含特征向量的序列中的各个强化图像帧间语义关联隐含特征向量之间的语义相似度以得到单向匹配语义度量系数的序列;对所述单向匹配语义度量系数的序列进行基于软最大值函数的归一化处理以得到单向匹配语义度量权重的序列;以所述单向匹配语义度量权重的序列作为权重,计算所述强化图像帧间语义关联隐含特征向量的序列的加权和以得到单向匹配交互重塑特征向量;计算所述查询特征向量与所述单向匹配交互重塑特征向量之间的差分特征向量作为所述单向匹配结果表示向量。

18、可选地,计算所述查询特征向量与所述强化图像帧间语义关联隐含特征向量的序列中的各个强化图像帧间语义关联隐含特征向量之间的语义相似度以得到单向匹配语义度量系数的序列,包括:将所述查询特征向量与所述强化图像帧间语义关联隐含特征向量进行级联后,将权重向量与级联得到的特征向量进行相乘;将相乘得到的数值与偏置参数进行相加;对相加得到的数值进行基于sigmoid函数的非线性激活处理以得到所述单向匹配语义度量系数。

19、可选地,所述步骤6,包括:将所述单向匹配结果表示向量输入基于分类器的图像帧关联度评估器以得到所述评估结果。

20、第二方面,本技术提供了一种用于警报事件的红点视频展示系统,所述系统包括:

21、视频片段提取模块,用于从原始视频提取基于报警标签锚定的视频片段;

22、前一帧图像提取模块,用于从所述原始视频提取所述视频片段的前一帧图像作为备选图像帧;

23、语义关联特征强化模块,用于对所述视频片段进行图像帧语义关联特征提取和图像帧上下文语义关联特征强化以得到强化图像帧间语义关联隐含特征向量的序列;

24、图像特征提取模块,用于将所述备选图像帧输入图像特征提取器以得到备选图像帧语义特征向量;

25、细粒度扫描交互模块,用于以所述备选图像帧语义特征向量作为查询特征向量,将所述查询特征向量和所述强化图像帧间语义关联隐含特征向量的序列输入基于注意力机制的细粒度交互模块以得到单向匹配结果表示向量;

26、评估结果确定模块,用于基于所述单向匹配结果表示向量,确定评估结果,所述评估结果用于表示是否将所述备选图像帧纳入所述视频片段;

27、备选图像帧纳入模块,用于响应于所述评估结果为将所述备选图像帧纳入所述视频片段,将所述备选图像帧作为所述视频片段的首帧以得到更新视频片段;

28、备选图像帧循环模块,用于从所述原始视频提取所述前一帧图像的前一帧图像作为备选图像帧,并循环直至所述评估结果为不将所述备选图像帧纳入所述视频片段;

29、更新视频片段展示模块,用于展示所述更新视频片段。

30、本技术至少具有如下技术效果:与现有技术相比,本技术通过智能化算法和图像处理技术,对基于报警标签锚定的视频片段(用于表示报警期间的视频片段)和视频片段的前一帧图像进行图像帧语义特征提取,以了解报警事件的状况以及所述视频片段的前一帧图像中的画面状况,进一步地将前一帧图像的图像帧语义特征作为查询信息,与视频片段的图像帧语义关联特征模式进行扫描交互匹配,从而智能化地判别所述前一帧图像是否应被纳入所述视频片段,并实时更新视频片段,可基于相同逻辑来筛选后向图像帧,以实现视频片段的基于语义的双向智能拓展,为复核工作提供更丰富的上下文信息,同时避免引入无关内容。

31、本技术的其他特征和优点将在随后的具体实施方式部分予以详细说明。

本文地址:https://www.jishuxx.com/zhuanli/20241125/337377.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。