一种自动化迭代优化的内容转分镜描述生成方法及系统与流程

- 国知局

- 2024-10-09 15:37:11

本发明涉及自然语言处理,尤其涉及一种自动化迭代优化的内容转分镜描述生成方法及系统。

背景技术:

1、在相关技术中,cn117235523a公开了一种语言生成模型改进方法、系统、设备及存储介质,在执行所述方法时,通过获取训练文本;将所述训练文本输入语言生成模型,确定输出文本;将所述输出文本输入评价模型,确定评价信息;基于所述输出文本和所述评价信息对所述语言生成模型进行训练,直到模型收敛并达到预设性能要求。在传统的标准答案监督训练的基础上,引入偏好评价模型给语言生成模型生成的文本进行评价。基于输出的文本和对该文本的评价信息迭代完成最终的模型训练。使语言生成模型实现自我迭代训练,鼓励模型从多样的角度生成内容,不只是依赖输入的训练样本,从而可以使模型具有更好的生成质量和泛化性。

2、cn112989764a公开了一种文本的生成方法、装置、设备以及存储介质,通过对用户输入的初始语料,进行文本序列生成操作,得到第一文本序列,再将第一文本序列作为初始语料,重复本步骤直至进行文本序列生成操作的次数达到预设次数时停止本过程,得到多个第一文本序列,其中,文本序列生成操作包括文本修订操作和采样操作,文本修订操作包括替换、插入,删除中的至少一种,再按照匹配度由高到低的顺序,从多个第一文本序列中选择并输出预设数量的第二文本序列,由语言模型快速迭代生成大量的第一文本序列,再通过采样从第一文本序列中筛选文本质量较高的第二文本序列,提高了文本序列的数量和质量。

3、因此,在相关技术中,虽然可通过基于人工智能的神经网络模型来处理自然语言文本,并提升文本质量,但当前的神经网络模型通常受限于模型的输入限制,无法一次性处理和理解长篇幅的文本(例如,长篇小说、长篇剧本等),导致模型在生成内容时,无法参考全文的上下文内容,无法理解全文的语义,造成其生成的内容易出现以偏概全、前后文矛盾、理解错误、连贯性差等问题。

4、公开于本技术背景技术部分的信息仅仅旨在加深对本技术的一般背景技术的理解,而不应当被视为承认或以任何形式暗示该信息构成已为本领域技术人员所公知的现有技术。

技术实现思路

1、本发明提供一种自动化迭代优化的内容转分镜描述生成方法及系统,能够解决模型在生成内容时,无法参考全文的上下文内容,无法理解全文的语义的技术问题。

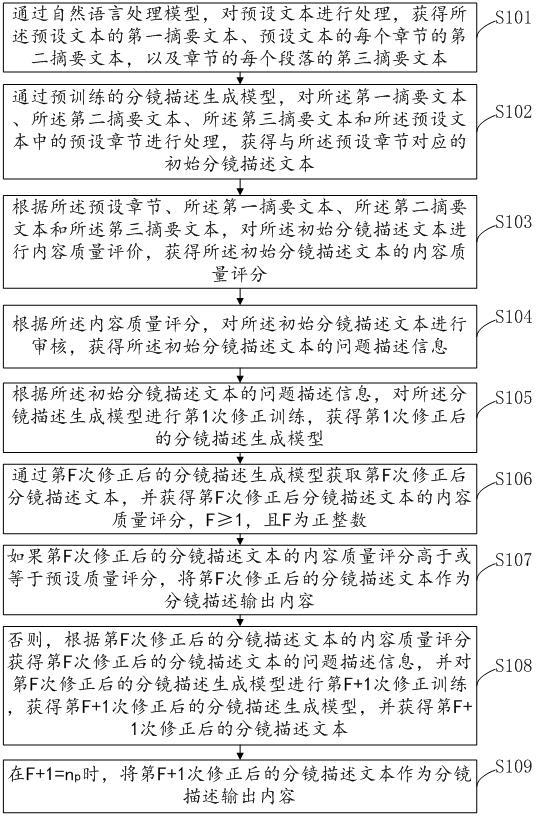

2、根据本发明的第一方面,提供一种自动化迭代优化的内容转分镜描述生成方法,包括:

3、通过自然语言处理模型,对预设文本进行处理,获得所述预设文本的第一摘要文本、预设文本的每个章节的第二摘要文本,以及章节的每个段落的第三摘要文本;

4、通过预训练的分镜描述生成模型,对所述第一摘要文本、所述第二摘要文本、所述第三摘要文本和所述预设文本中的预设章节进行处理,获得与所述预设章节对应的初始分镜描述文本;

5、根据所述预设章节、所述第一摘要文本、所述第二摘要文本和所述第三摘要文本,对所述初始分镜描述文本进行内容质量评价,获得所述初始分镜描述文本的内容质量评分;

6、根据所述内容质量评分,对所述初始分镜描述文本进行审核,获得所述初始分镜描述文本的问题描述信息;

7、根据所述初始分镜描述文本的问题描述信息,对所述分镜描述生成模型进行第1次修正训练,获得第1次修正后的分镜描述生成模型;

8、通过第f次修正后的分镜描述生成模型获取第f次修正后分镜描述文本,并获得第f次修正后的分镜描述文本的内容质量评分,f≥1,且f为正整数;

9、如果第f次修正后的分镜描述文本的内容质量评分高于或等于预设质量评分,将第f次修正后的分镜描述文本作为分镜描述输出内容;

10、否则,根据第f次修正后的分镜描述文本的内容质量评分获得第f次修正后的分镜描述文本的问题描述信息,并对第f次修正后的分镜描述生成模型进行第f+1次修正训练,获得第f+1次修正后的分镜描述生成模型,并获得第f+1次修正后的分镜描述文本;

11、在f+1=时,将第f+1次修正后的分镜描述文本作为分镜描述输出内容,其中,为预设迭代次数。

12、根据本发明的第二方面,提供一种自动化迭代优化的内容转分镜描述生成系统,包括:

13、摘要文本模块,用于通过自然语言处理模型,对预设文本进行处理,获得所述预设文本的第一摘要文本、预设文本的每个章节的第二摘要文本,以及章节的每个段落的第三摘要文本;

14、初始分镜描述文本模块,用于通过预训练的分镜描述生成模型,对所述第一摘要文本、所述第二摘要文本、所述第三摘要文本和所述预设文本中的预设章节进行处理,获得与所述预设章节对应的初始分镜描述文本;

15、内容质量评分模块,用于根据所述预设章节、所述第一摘要文本、所述第二摘要文本和所述第三摘要文本,对所述初始分镜描述文本进行内容质量评价,获得所述初始分镜描述文本的内容质量评分;

16、问题描述信息模块,用于根据所述内容质量评分,对所述初始分镜描述文本进行审核,获得所述初始分镜描述文本的问题描述信息;

17、修正训练模块,用于根据所述初始分镜描述文本的问题描述信息,对所述分镜描述生成模型进行第1次修正训练,获得第1次修正后的分镜描述生成模型;

18、评分模块,用于通过第f次修正后的分镜描述生成模型获取第f次修正后分镜描述文本,并获得第f次修正后的分镜描述文本的内容质量评分,f≥1,且f为正整数;

19、输出模块,用于如果第f次修正后的分镜描述文本的内容质量评分高于或等于预设质量评分,将第f次修正后的分镜描述文本作为分镜描述输出内容;

20、迭代模块,用于否则,根据第f次修正后的分镜描述文本的内容质量评分获得第f次修正后的分镜描述文本的问题描述信息,并对第f次修正后的分镜描述生成模型进行第f+1次修正训练,获得第f+1次修正后的分镜描述生成模型,并获得第f+1次修正后的分镜描述文本;

21、迭代完成模块,用于在f+1=时,将第f+1次修正后的分镜描述文本作为分镜描述输出内容,其中,为预设迭代次数。

22、技术效果:根据本发明,可分别获取预设文本的第一摘要文本、每个章节的第二摘要文本以及每个段落的第三摘要文本,进而可基于上述摘要文本,对预设章节进行处理,获得预设章节的初始分镜描述文本,可基于全文、章节和段落的摘要文本,使分镜描述生成模型能够参考全文的上下文内容,进而将预设章节转换为初始分镜描述文本,降低初始分镜描述文本出现以偏概全、前后文矛盾、理解错误、连贯性差等问题的概率,并可通过对初始分镜描述文本进行质量评价、寻找初始分镜描述文本中存在的问题以及基于其中存在的问题进行修正等处理,并迭代执行该处理,直到修正后的分镜描述文本的质量符合要求,获得高质量的分镜描述文本,进一步降低其出现以偏概全、前后文矛盾、理解错误、连贯性差等问题的概率。在训练自然语言处理模型时,可通过第一待定摘要文本和全文摘要组合文本之间的语义相似度和曲解度,以及第二待定摘要文本和章节摘要组合文本的语义相似度和曲解度来设置自然语言处理模型的损失函数,并迭代更新训练自然语言处理模型,从而提升自然语言处理模型的精度,进而可获得准确的多个层级的摘要文本,使得后续生成分镜描述时,能够利用准确的多个层级的摘要文本,使分镜描述生成模型在无法接收长文本的输入的情况下,尽可能掌握更丰富的上下文信息,从而使得分镜描述与原文的语义更接近,降低出现以偏概全、前后文矛盾、连贯性差等问题的概率。在确定初始分镜描述文本的准确度评分时,可通过对比预设章节摘要文本和初始分镜描述文本,来求解初始分镜描述文本中的人物、地点和动作三方面的描述正确率,从而获得初始分镜描述文本的准确度评分,可客观且准确地描述初始分镜描述文本中的重要情节的描述正确率。在确定原意保持度评分时,可通过初始分镜描述文本与预设章节原文的语义相似度,以及初始分镜描述文本中的人物、地点、动作等重要情节是否在预设章节原文中出现,以及是否在其他章节的第二摘要文本中出现等因素,确定原意保持度评分,从而可准确且客观地表示初始分镜描述文本是否能保持预设章节原文的原意,以及是否存在重要情节被剧透的缺陷。在确定语义错误检测评分时,可通过初始分镜描述文本中的句子与预设章节原文的句子的逐句比较,来确定初始分镜描述文本的各个句子的语义准确性,并基于初始分镜描述文本中的人物、地点、动作等重要情节是否在全文中出现,来确定初始分镜描述文本中是否存在由分镜描述生成模型基于错误的理解生成的错误情节,提升语义错误检测评分的准确性和客观性。在审核初始分镜描述文本中存在的问题时,可通过初始分镜描述文本与原文的语义和逻辑的相似性、对原文的表达的完整性,以及与原文在情感表达方面的相似性等方面,来审核初始分镜描述文本中存在的问题,从而获得准确的问题描述信息,为分镜描述生成模型的修正训练以及初始分镜描述文本的修正提供数据基础。在训练分镜描述生成模型时,可分别基于初始分镜描述文本对原文的整体曲解度、初始分镜描述文本与原文的语义的误差和初始分镜描述文本与预设章节在情感表达方面的总体差异等方面来确定第1次修正训练时的损失函数,并可通过问题描述信息来设置上述方面的权重,从而重点训练存在严重问题的方面,提升训练的针对性和效率。

23、应当理解的是,以上的一般描述和后文的细节描述仅是示例性和解释性的,而非限制本发明。根据下面参考附图对示例性实施例的详细说明,本发明的其它特征及方面将更清楚。

本文地址:https://www.jishuxx.com/zhuanli/20241009/309384.html

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 YYfuon@163.com 举报,一经查实,本站将立刻删除。